世界初の協働エージェント誕生!GensparkのMoAシステムとは?

はじめに

GensparkのMoAシステム:信頼性の高いAI体験のための革新的なアプローチ

2024年12月18日、世界初の協働エージェント(MoA:Mixture-of-Agents)システムを発表しました。

この記事では、Gensparkが開発した革新的AIシステム「Mixture-of-Agents (MoA)」について解説しています。

MoAは、複数のAIモデルを組み合わせることで、従来の単一モデルシステムを超える精度、信頼性、信頼性を提供し、チャット、画像生成、翻訳において革新的な体験を実現しているようです。

MoAの主な特徴

複数モデルの専門知識を活用

複数の言語モデル、画像生成モデル、翻訳ツールを組み合わせ、各モデルの強みを活かすことで、単一モデルでは達成できない高精度で信頼性の高い結果を実現

協調的な推論

各モデルが専門的な回答を提供し、MoAはそれらを統合・洗練することで、より正確でニュアンスのある信頼性の高い回答を生成

信頼性の向上

複数の専門家の視点を統合することで、包括的で十分な情報に基づいた結果を提供し、ユーザーとの信頼を構築

MoAの仕組み

集合的な洞察

各モデルが専門分野の回答を提供し、情報プールを豊かにする

熟考と洗練

MoAは多様な回答を熟考し、重要な一貫性を特定することで、回答を統合・洗練する

信頼できる出力

最終的な回答は、洗練され、一貫性があり、信頼性の高いものとなる

MoAの応用分野

チャット

複数の言語モデルの回答を組み合わせ、正確で文脈に沿った回答を提供

画像生成

複数の画像生成モデルからの出力結果をユーザーが選択し、プロンプトを洗練することで、ユーザーの期待に沿った画像を生成

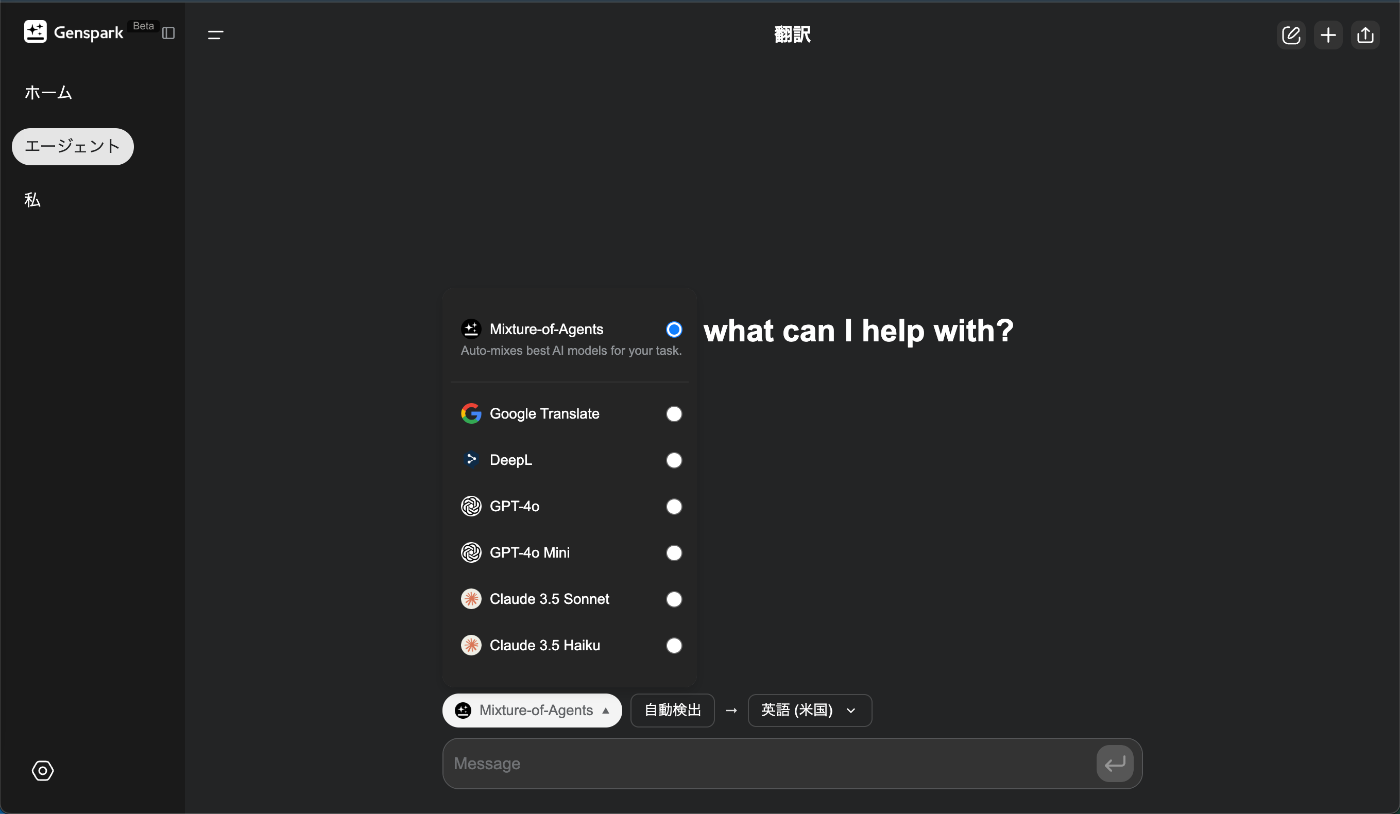

翻訳

複数の翻訳モデルの強みを活かし、高品質で文脈に沿った翻訳を提供

信頼性への注力

MoAは、信頼性を基盤として設計されており、従来の単一モデルシステムを超える信頼性を提供しています。

MoAの協調的なアプローチにより、ユーザーは常にバランスの取れた洞察を得ることができると思います。

実際に使ってみる

サイドバーでエージェントを選択するとこのような画面になります。

過去に公開されたファクトチェックやデータ検索もここでできるようになっているのですね。

チャット

選択できるモデルに2024年10月22日に公開されたClaudeの3.5 Sonnetと3.5 Haikuがありますね。

o1もpreviewが使えるようです。

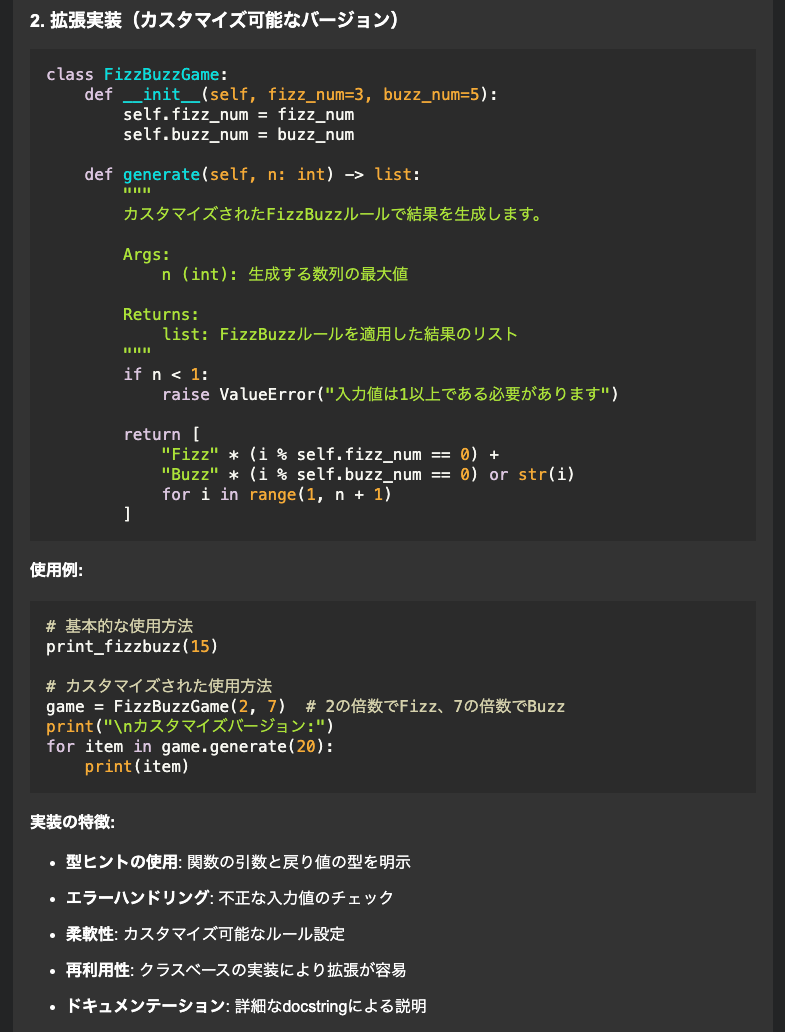

例えば、pythonでFizzBuzzゲーム作ってもらいました。

モデルごとで結果を出して、分析を経て回答を出してくれるみたいです。

ChatGPT-4oの回答

Claude 3.5 Sonnetの回答

Gemini 1.5 proの回答

3つのモデルレスポンスの分析

回答

モデルの強みと弱みを出して、3つのモデルの比較検証した上で回答が出ているので、1つのモデルで実行するよりもより有用な回答が得られていると思います。

画像生成

モデルとイメージ、サイズを選択できます。

自動プロンプトにチェックを入れて生成すると、補助的に画像を生成する際のプロンプトも生成した上で画像生成してくれます。

以下「犬と猫が戯れている画像」と入力した際の回答です。

プロンプトが苦手な方には参考になりそうなことしてくれますね。

翻訳

モデルにDeepLがありますね。

アインシュタインの格言を翻訳してみました。

「Learn from yesterday, live for today, hope for tomorrow.The important thing is not to stop questioning.」

まあ、最終的な翻訳結果がしっくりくるかどうかはさておいて。

複数のモデルでの翻訳結果を並列で見ることができるのは良い気がします。

分析が見れるのも少し面白いです。

感想

複数のモデルで比較することは現在でもできますが、複数を跨いで問う時間と、結果を見比べる時間を考えると、MoAはとても使い勝手がいいなと思いました。

実際、ChatGPTやClaude、Geminiのフリープランを使用している方からすると、使うモデルは変わらないので、MoAを使わない手はないような気がします。

画像生成でうまくプロンプトが書けない方も、どう伝えたらどんな画像が返ってくるのか、参考にすると表現の幅が広がると思います。

ただし、やはり複数のモデルを扱っているので、チャットや翻訳は一回の問いに対してOutputの時間が長いと感じます。

そこがネックですかね。。

とはいえそこまで待たされるわけではないので個人の許容時間によるとは思います。

私はあまり気にならないです。

おわりに

最近、OpenAI(ChatGPT等)もGoogle(Gemini等)も、ここぞとばかりに大きな発表しまくっているので目がまわっています。

そこで今回のGenspark。

いつまで無料で提供してくれるのか、いつ有料化してもおかしくないと思ってはいます。

MoAでo1やgemini2.0モデルが使用できるようになったらもう。。

まったく、、最高ですね!

追記:2024/12/23

有料プラン

有料プラン(Plus)が出ているようですね。

おそらくMoAシステムが発表された時に出てたのではと。。

情報公開がひっそりしすぎて拾うの遅くなりました。笑

月額 $24.99 米ドル/月

年額 $19.99 $24.99 米ドル/月

- 新機能への早期アクセス

- 無制限の検索

- すべてのAIエージェントへのアクセス

- すべてのトップティアモデルへのアクセス

penAI GPT-4o、Anthropic Claude Sonnet、Google Gemini など - すべての最新画像生成モデルへのアクセス

FLUX Ultra、Ideogram、Recraft、DALL·E など - 世界初のエージェントの組み合わせ機能へのアクセスにより、高度なチャット、画像生成、翻訳機能を強化

Discussion