テスラに迫る!? 中国の自動運転をリードするBaidu/ApolloのAI戦略

こんにちは。Turingの機械学習チームでエンジニアをしている塩塚です。

Turingは「We Overtake Tesla」を合言葉に、完全自動運転EVの開発・販売を目指しているスタートアップです。TuringではAIの強力さとそのさらなる成長を信じ、AIベースの自動運転システムを開発しています。

AIベースで自動運転を開発している会社はいくつかありますが、例えば米国の電気自動車メーカーTeslaはその代表的な会社の一つです。Teslaはカメラを主たるセンサーとして採用し、AIによって走行経路などを決定しています。詳しい内容は、Tesla AI Day 2021というイベントの内容を弊社のエンジニアがまとめているのでぜひ見てみてください。

一方、私たちはTeslaだけでなく、Apolloという中国企業にも大きく注目しています。

Apolloは、中国の巨大IT企業Baidu傘下の会社で、自動運転システムの開発・商用化を行っています。Baiduは中国版Googleとも呼ばれ、AI領域が非常に強いことで知られています。そんなApolloが昨年Apollo Day 2022というイベントを開催し、Apolloの開発事情について発表しました。(なんか、すごくTeslaを意識している気がしますね。いや、弊社が言うのもなんですが…笑)

この記事では、そんなApollo Day 2022をもとに、中国で自動運転AIを開発している企業がどのような戦略で進めているかを紹介したいと思います。

※以下で使用される画像は特に注釈がない限りBaiduの公式リリース及びApollo Day 2022の動画より引用しています。

自動運転のレベルについて

自動運転ではよく「レベル」という概念を用いてその技術水準を議論しますが、簡単にその定義について触れておきます。

アメリカの「自動車技術者協会」(SAE International)の基準によると、自動運転は、人と車が担う運転動作の比率、走行可能エリアなどによって下記のようにレベル1~5までの5段階に分類されます。

-

レベル1, 2:運転支援・部分自動化

- ハンドル/アクセル/ブレーキを自動化

- 人が監視して責任を持つ

-

レベル3, 4:条件付き自動化・高度自動化

- システムが運転タスクを代行

- 走行できる範囲が限定される

-

レベル5:完全自動運転 ⇦ Turingの目指すもの

- システムが全ての運転タスクを代行

- 条件や地域を限定しない

Lv1〜2とLv3〜4の大きな違いは、責任の所在が前者はドライバーなのに対し後者は自動運転システム側にあるということです。

※本記事中のApolloの説明の中にLv2+という表現が有りますが、これはあくまでもApolloが使っている表現であり、既存のLv2システムよりも進化しているくらいの意味合いで受け取るのが良いかと思います。

それでは、本題のApollo Day 2022の内容に入っていきます!

Apollo Day 2022

Apollo Day 2022では、5つのセクションで開発戦略が発表されました。

- 高精度3次元マップ(HDマップ)の必要性

- 自動運転AI

- 学習データの選定

- 計算チップ

- Lv4とLv2+の並行開発

以下の内容説明の中では、Apolloの発表内容と筆者の意見を明確化するために、筆者の意見や感想を()内で表記します。

自動運転用の地図(HDマップ)の必要性

- HDマップの作成の難しさと重要性

Apolloは、自動運転にはHigh Definitionマップ(以降、HDマップ)が必要だと強く主張しています。HDマップとは、車線や道路標識、建物の形状など交通シーンのあらゆる情報を3次元的に保持する高精度3次元地図のことを指します。

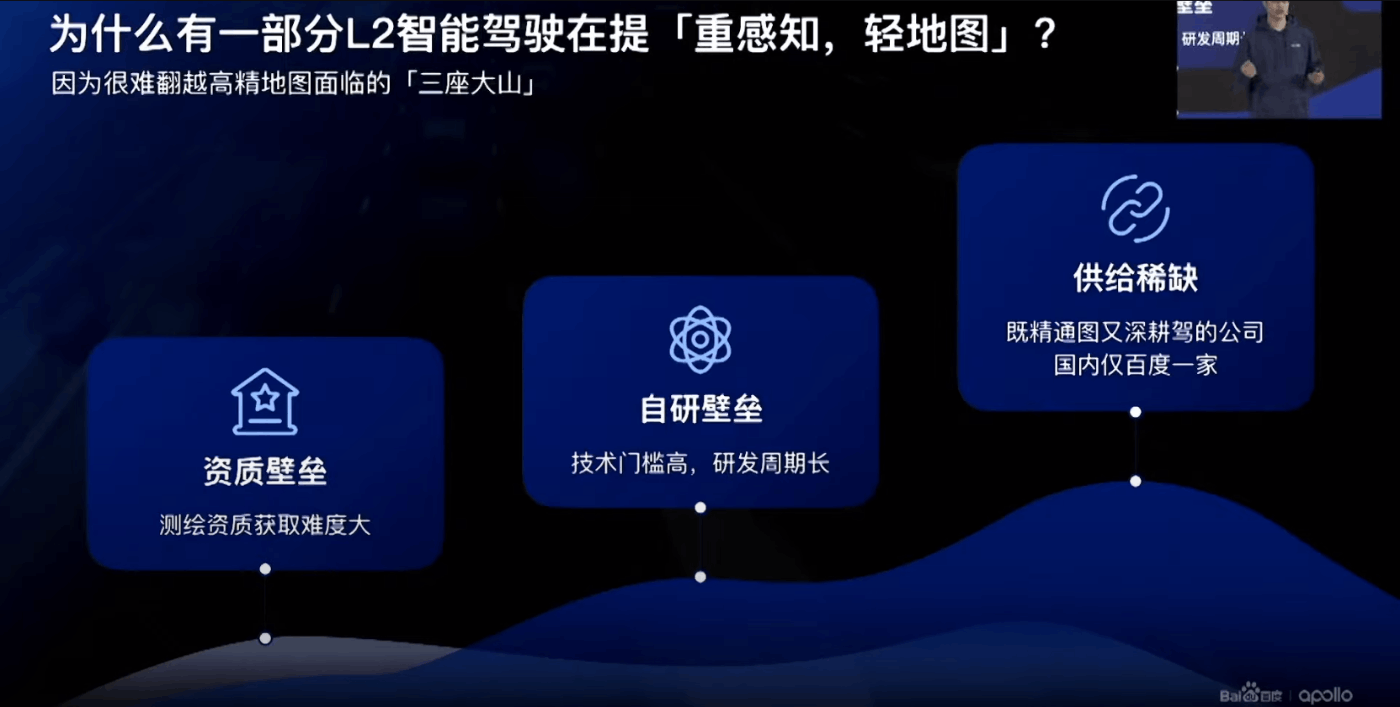

HDマップは現在、多くの自動運転システムに用いられていますが、HDマップを大規模かつ適切に活用することは非常に難しいとApolloのエンジニアは話しています。

なぜなら、技術、研究、資金の3つの壁があるためです。HDマップを正確に効果的に作成する技術力と、より良くしていこうとする研究力、そしてそれらを維持管理できる資金力が必要とし、全てを解決できるのは中国ではApolloだけだと述べています。

また、自動運転で安全、快適、効率の3つを実現するためにもHDマップは必要不可欠と説明しています。安全性についてはイメージしやすいですが、Apolloが開発するHDマップには、過去のドライバーの速度情報なども付与されており、快適性や効率性の向上に活用されているようです。

- HDマップの問題点をAIで解決

HDマップは自動運転に効果的な技術ですが、課題もあります。ここでは、作成コストと静的性を上げています。

通常、HDマップの作成には多くの人的・金銭的コストがかかりますが、ApolloはAIを使った自動化によりコストの削減を試みています。

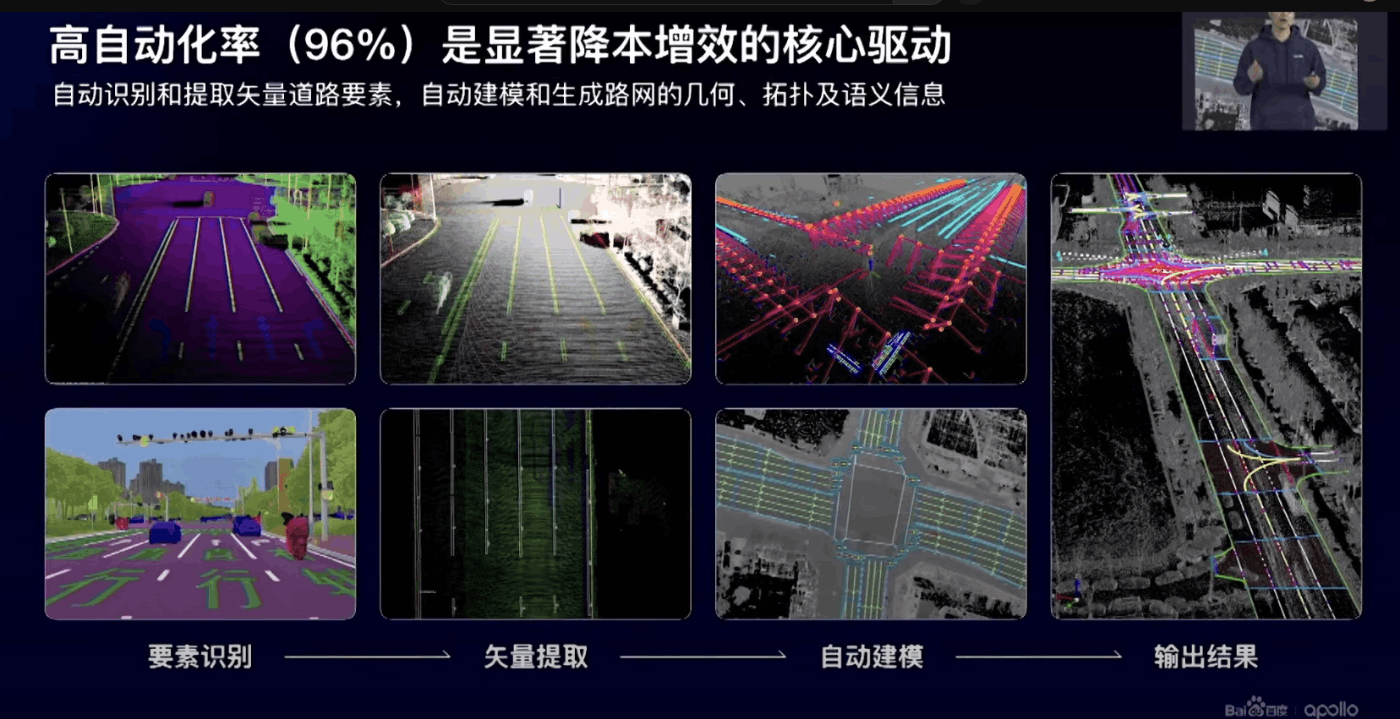

下図はその紹介スライドですが、セグメンテーションなどの要素技術(図中左から1つめ)から車線情報などのベクターデータと呼ばれる情報を抽出し(図左2)、空間的・幾何学的な情報を結合させ(図左3)、最終的なHDマップを生成します(図左4)。この技術により96%の自動化を達成したようです。

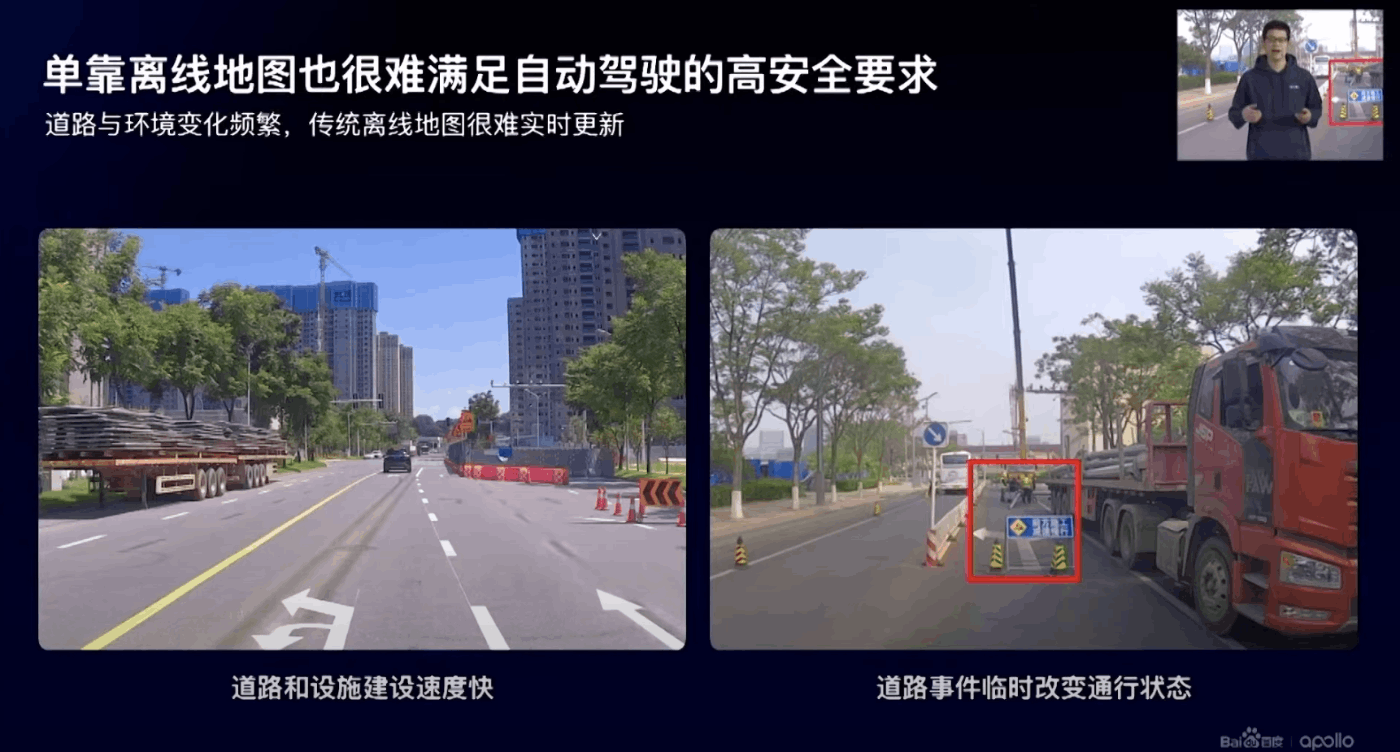

また、HDマップは通常、車線や標識などあらかじめ作成された静的な情報を持ち、走行中にアップデートされることはありません。しかし、道路状況はその時々で変化します。工事中であったり、路駐車両や障害物によって道が塞がれていたりします。Apolloはそのような動的な情報も含めてをHDマップをリアルタイムで更新していくべきとしています。

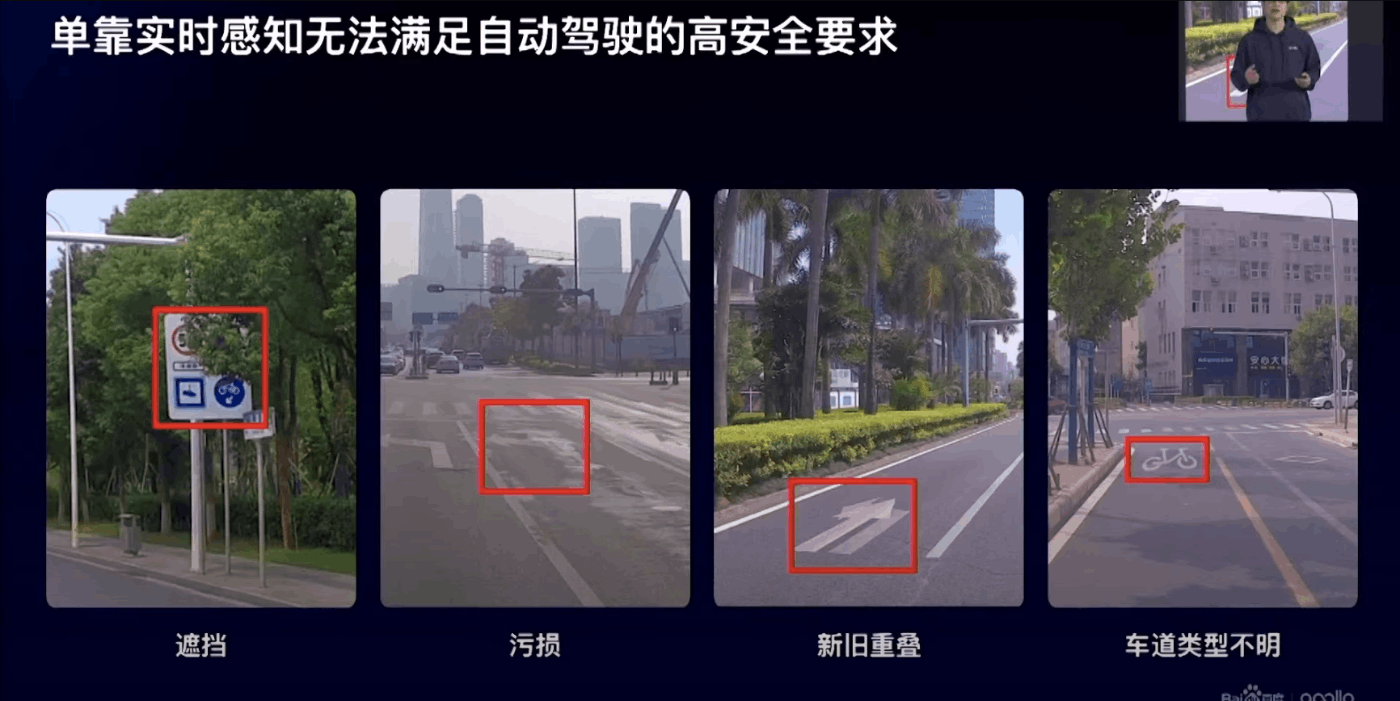

まずは静的な情報が必要な場合です。道路標識が見えにくい場合や、自転車専用道路の情報などはあらかじめ知っておいたほうがよいです。

一方で、静的な情報だけでは対応が難しい場合です。手元のHDマップだけを頼りに走行していると、工事が発生して車線規制などが発生している時、うまく判断ができないかもしれません。

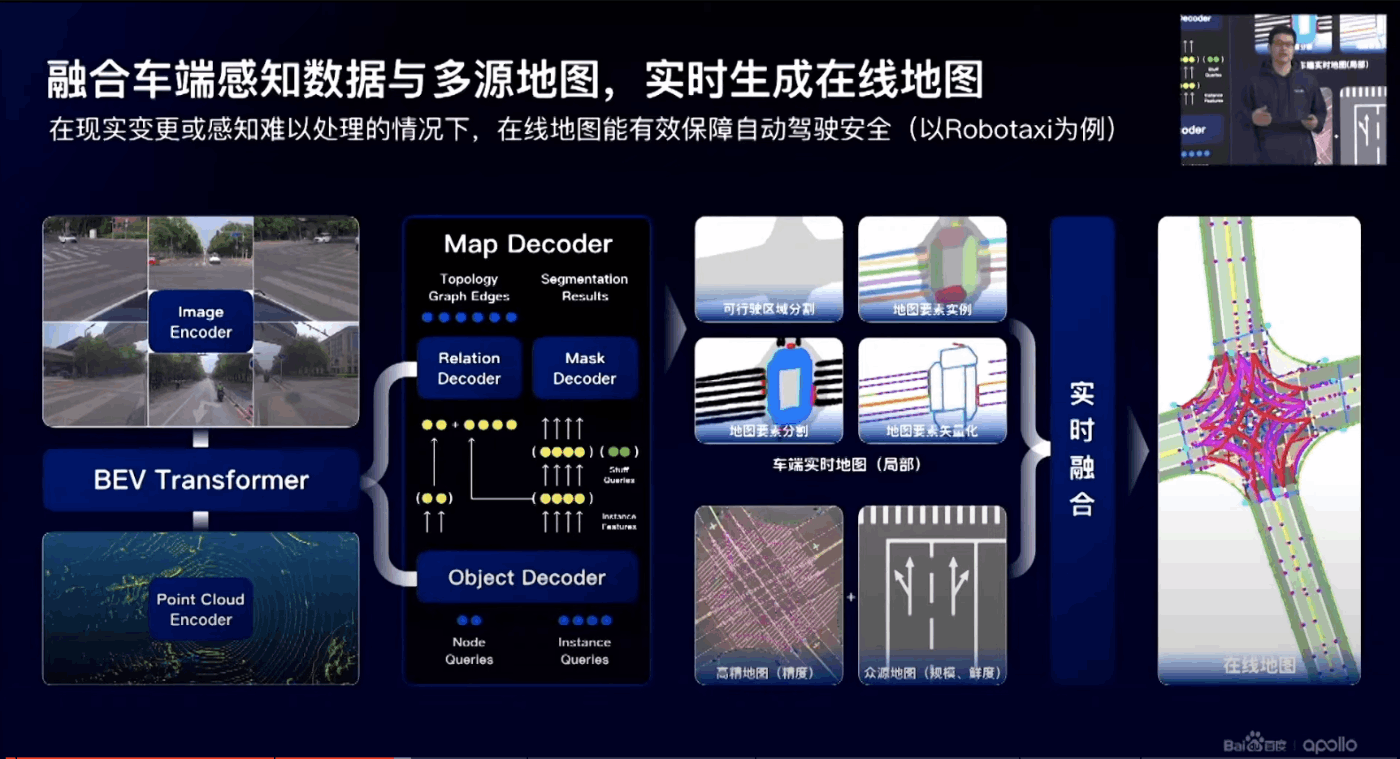

そこで、Apolloが中国で実際に運用している自動運転タクシーサービスのRobotaxiでは静的・動的な情報をリアルタイムに統合し、走行に必要な地図を更新し続けています。下図の詳しい説明は省略しますが、高いAI技術と自動運転技術の双方をうまく融合しているように見えます。

ApolloはHDマップが必要不可欠な技術とし、課題点をAIによって軽減していっています。

自動運転AI

- Sensor Fusionの重要性

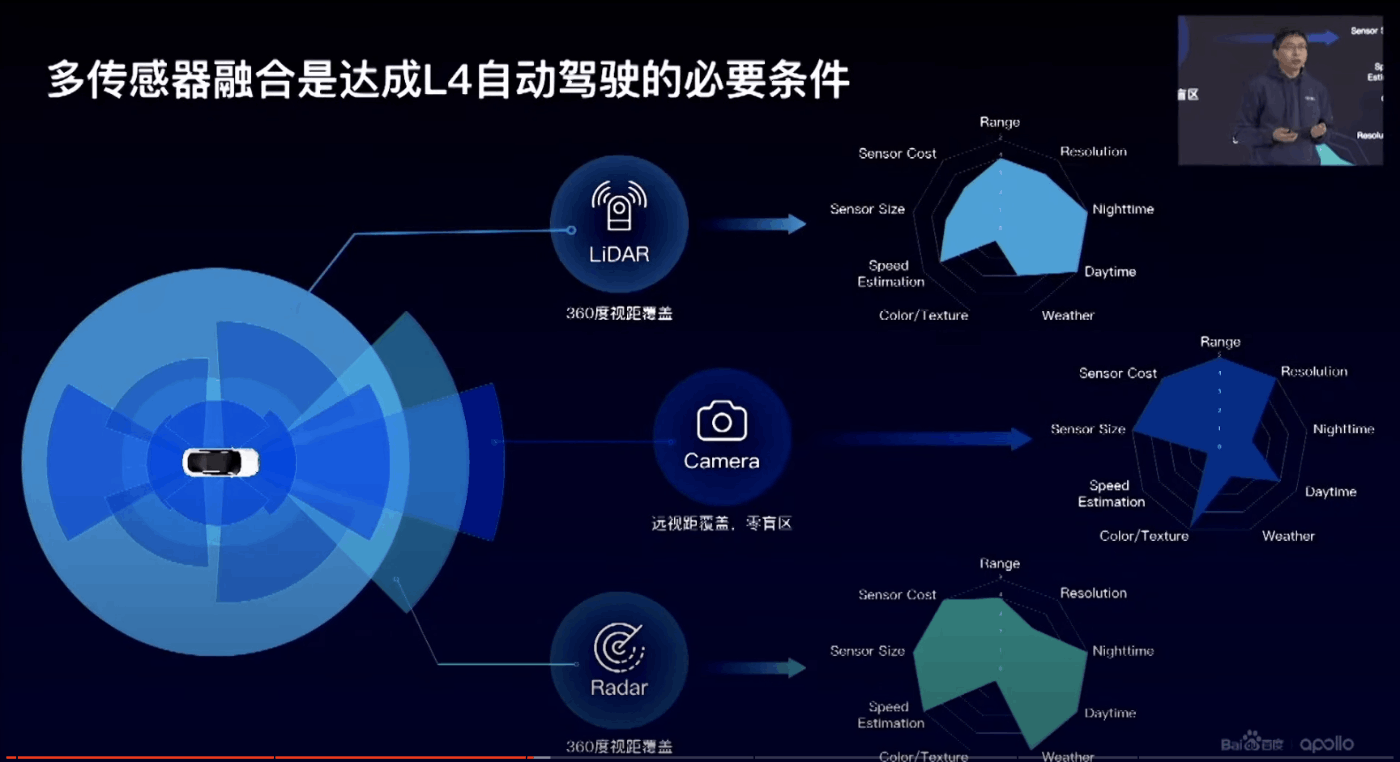

自動運転に用いられる代表的なセンサには、LiDAR, カメラ, レーダーがあります。それぞれに得意分野が有り、例えばLiDARやレーダーはカメラに比べ色やテクスチャに関して弱いが、照明や天候の影響を受けにくいという特徴が有ります。そのため複数のセンサを使い、お互いに苦手なところを補うことが重要とのことです。

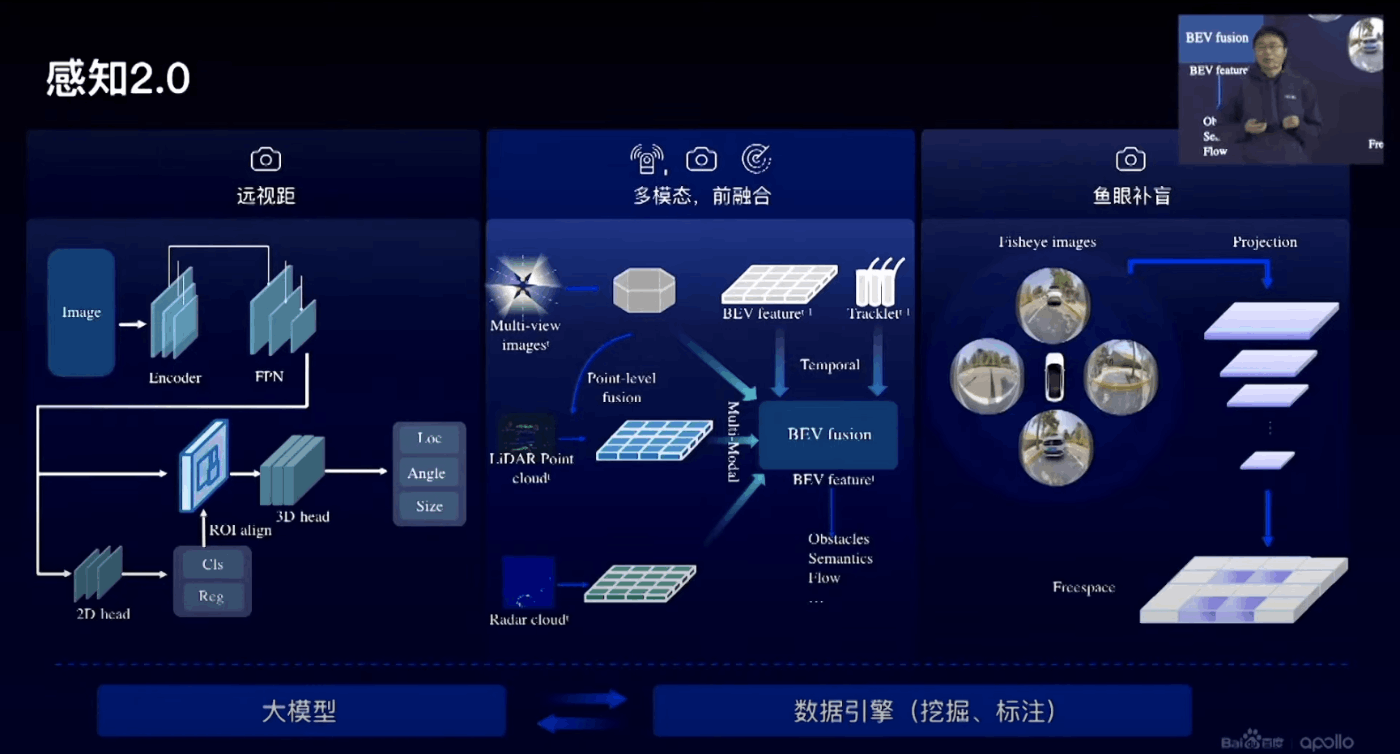

Apolloのエンジニアが感知2.0と呼ぶアーキテクチャでは、それぞれを独立して処理するのではなく、機械学習モデルの中間表現でSensor Fusionしているようです。Sensor Fusionとは、複数のセンサの情報を融合してその後のタスクに活かすことです。(このような手法は、論文などでは数年前から見かけますが実際に企業で開発して、それを公開できるレベルにしているのは驚きです。)

- 大きいモデルを作って小さいモデルを作る

(

自動運転に必要な知性とはどの程度のものでしょうか。言い方を変えるとAIのパラメータ数はどのくらいなのでしょうか。そしてそれは、車載できる計算機に乗るのでしょうか。この一連の問いは自動運転AIを開発する上で非常に重要です。

)

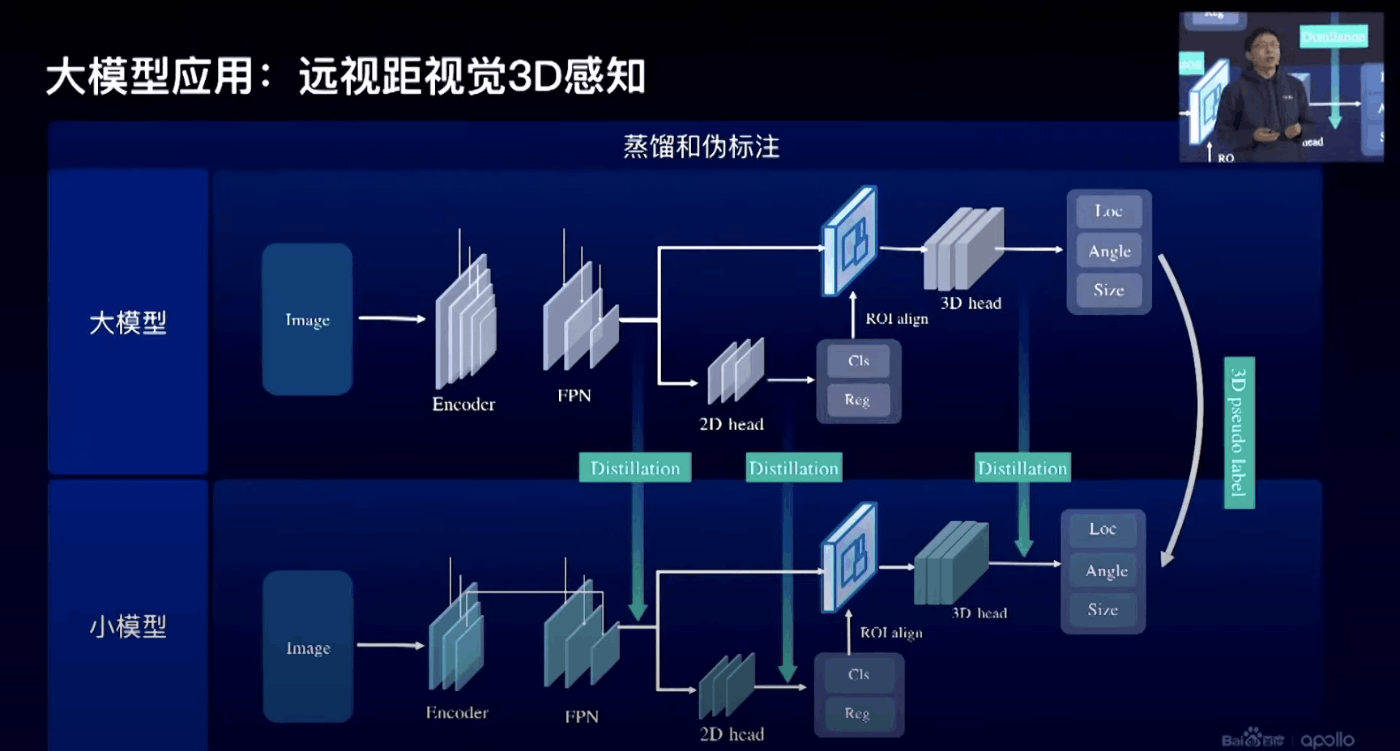

Apolloはこの問いに「道路状況を正しく理解できる大きなAIを作り、その知識蒸留をして車載に搭載できる小さいAIを作る」という一つのアプローチを提示しています。知識蒸留とは、比較的パラメータ数が大きいモデルで学習して、その予測結果を目標にパラメータ数が小さなモデルで学習する手法です。これにより良い精度を保ったままより軽いモデルにすることが可能です。

(

Apolloの発表からは、車線を維持するとか、障害物を検知するとか、個別の機能のためではなく、現代大きな発展を遂げているChatBotや画像生成AIのようなもっと汎用的な知性の開発を目指しているように感じました。

)

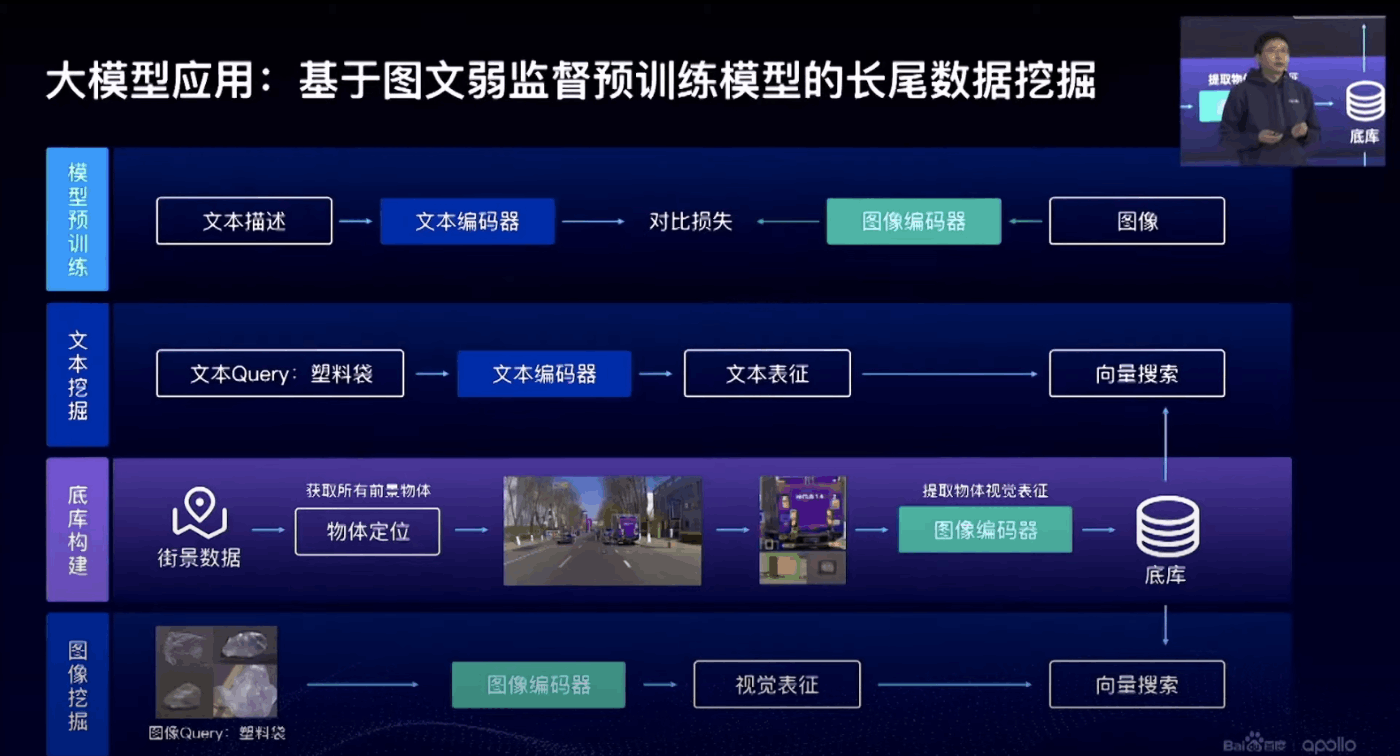

- ラベルは広く浅く

アノテーションの粒度についても言及しています。通常、自動運転用のデータセットのラベルは「Pedestrian」, 「Car」, 「Cyclist」くらいの粗さでつけられることが多いです。

しかし、子供と大人は同じ「Pedestrian」か、一般車と救急車は同じ「Car」か、道端に落ちているものは全て「Others」でよいのだろうかと、登壇者は問題提起していました。

我々人間は運転するときに明らかにそれらを区別して運転しています。自動運転AIにもその区別が必要とし、そのためにはラベルは広く浅くつけるべきとのことです。

しかし、ラベルを広く浅くつけることは非常に手間です。時間とお金が莫大にかかります。その問題に対するアプローチもやはりAIを用いています。

ここでも下図の細かい説明は避けますが、現在大きな効果をあげているVision and Languageの技術を使っています。この技術は画像生成の発展を大きく後押ししました。

テキストと画像を同じ特徴空間に射影して、特徴空間上でマッチングすることで自動で画像にラベルを付与することができます。画像検索をするイメージに近いかもしれません。

(

最近流行りのVision and Languageの中でも特に有名なCLIPの技術を活かした、追加で学習を必要としないゼロショットのラベルづけを行うことでアノテーションのコストカットとラベルの多様性を一気に実現しようとしている点は、さすがApolloというかさすがBaiduという気がしてきます。

Vision and Languageなどの基盤モデルについてはTuringの過去のテックブログで紹介しています。

)

学習データの選定(簡単に)

ここのセクションも非常に面白かったのですが、文量の都合とやや専門的であったため簡単にまとめだけ書きます。

このセクションのまとめは、

- 自動運転のデータは非常に大きいため選んで使う必要がある。

- モデルが学習できてないデータを積極的に学習。そのためのアルゴリズムを開発。

- 事故などのアクシデントも優先的に学習。

となります。

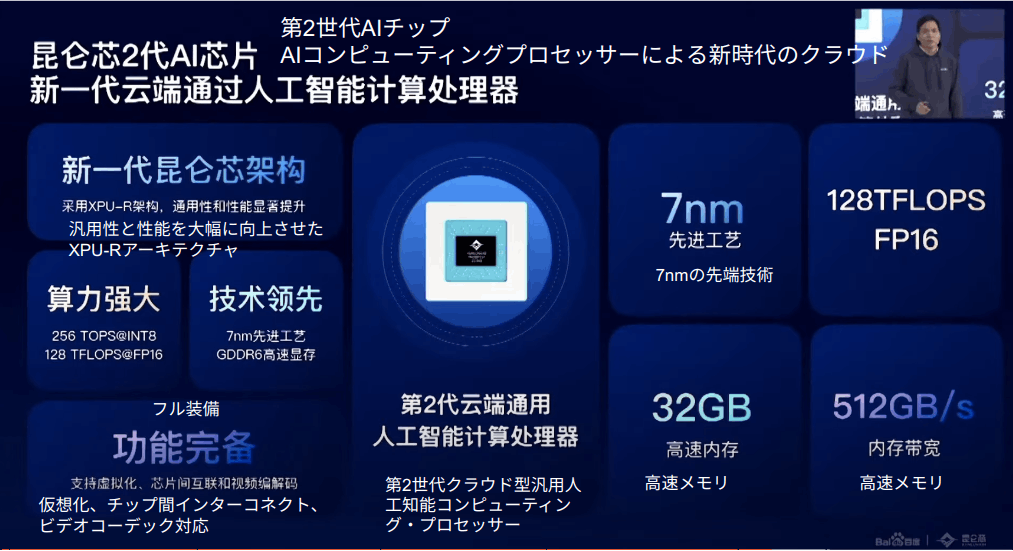

計算チップ(簡単に)

Apolloは計算チップ自体も10年の歳月を費やして作っています。

以下の画像は、発表スライドに筆者が日本語字幕をつけたものになります。非常にコンパクトでパワフルなことがわかります。これは、NvidiaのAGX Orinに近い性能だと考えられます。

Lv4とLv2+の並行開発

本発表の最後のセクションです。

(

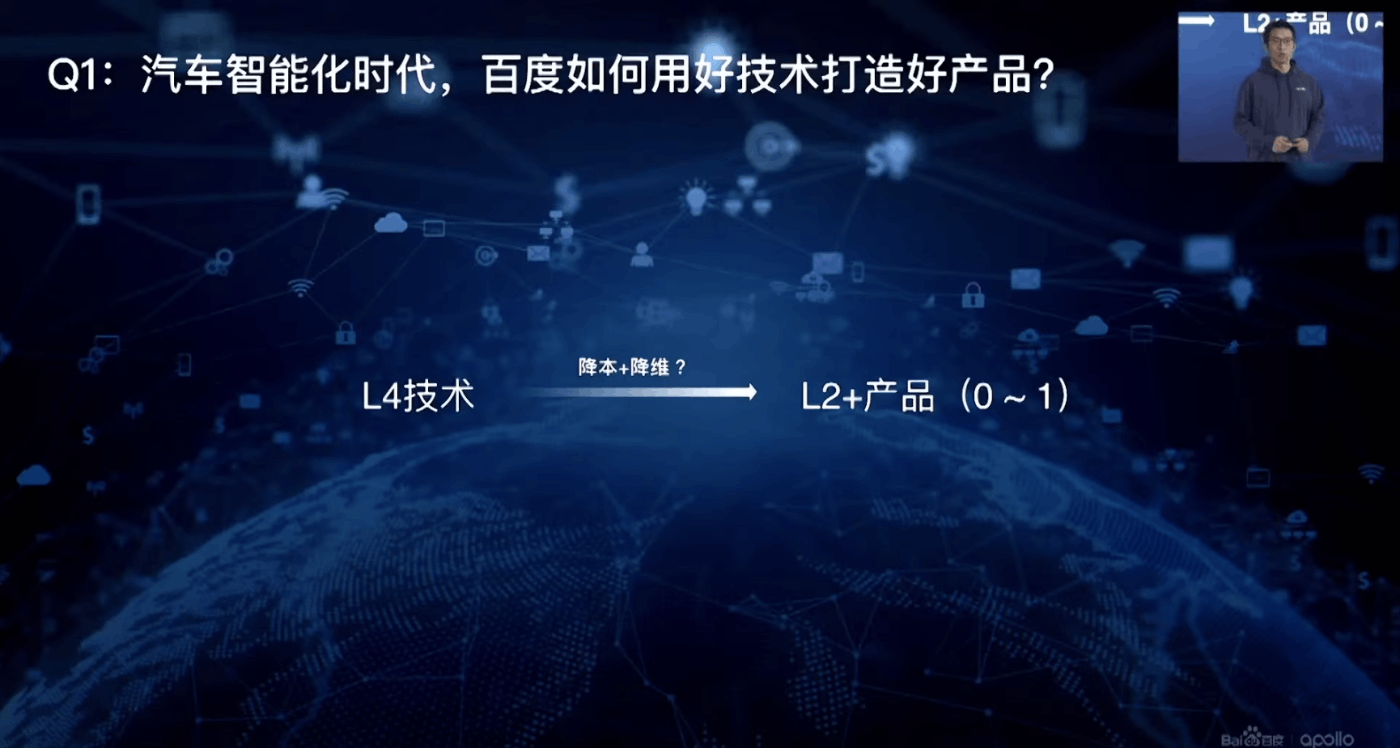

現在の自動運転を開発する会社は大きく2つの種類があると思っています。あくまでも人に責任がある状態で主に市販車に搭載されるLv2型と、自動運転システムに責任がある主にタクシーやバスなどに搭載されるLv4型です。

前者はTeslaや既存の自動車メーカーが該当します。基本的には車に積まれているセンサから周囲の状況を感知し走行します。エリアは現在高速道路に限定されている場合が多いですが、Teslaがアメリカのみで提供しているFSD(Full Self-Driving)のbeta版では街中でも障害物を避けながら走っています。

一方、WaymoやCruiseなどは後者に該当します。高性能のLiDARや自動運転用のリッチな地図(HDマップ)を搭載し、限定エリアで人による介入なしに走行します。

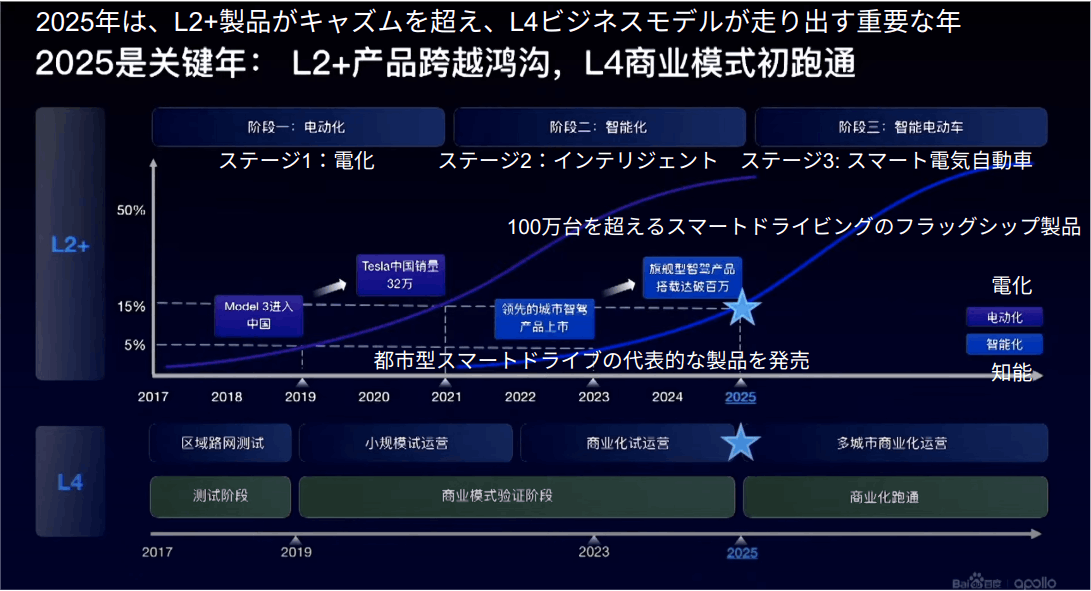

Apolloも後者に該当し、中国の限定エリアで運用されてきました。しかし、ApolloはLv2(ApolloはLv2+と呼んでいる)の開発も進めているようです。

)

Apolloは、2017年頃から2021年までをEVのステージ、2021年から2025年までが知性(AI)のステージ、そして2025年以降を知性を持ったEVのステージだと捉えています。

Apolloはこれまで、限定区間を人の操作無しで走れるLv4自動運転をメインに開発してきました。これらの技術は、一般車両ではなくタクシーやバスに使われてきましたが、今後は世界の流れとして一般車両にも高度な自動運転機能Lv2+が搭載されていくことを予想しています。

そのため、これまで培ったLv4技術を活かしてLv2+の自動運転を開発していくとのことです。

また、Apolloの自動運転はLiDARなどの高価なセンサを搭載していますが、ハードウェアの性能向上と低コスト化は期待できると考えているようです。

ソフトウェアとハードウェアは体のようにつながるべきだとも言っていました。

最後に、Apolloが現在開発中のLv2+の動画を紹介したいと思います。

(

2分弱の動画パートですが、率直に筆者は驚きました。HDマップを使っているようなので、技術要件や走行可能エリア的にはLv4とあまり変わらないのでは?とも思いましたが、障害物を避けたり、他の車や歩行者と人間のドライバーのように空気を読み合ったりと高度な判断ができています。

)

また、開発方針としては、Lv4からLv2+の単方向だけでなく、Lv2+で広域に取ったデータをLv4の開発に活かすなど、両方向で向上させていくようです。

Apollo Day 2022 のまとめ

Apolloの開発方針は

- HDマップは必要不可欠で、LiDAR, カメラ, レーダーを複合的に使っていく

- AIの最新技術を使い、高度な自動運転AIを作る

- Lv4とLv2を並行で開発していく

となっていました。

(

HDマップやLiDARなどの自動運転の要素技術を熟知しつつ、Vision and Languageや知識蒸留などのAI技術を駆使しているようです。

また、自動運転のレベル(Lv1~Lv5)を段階として考えず、Lv4とLv2はそもそも求められている技術が異なる点を理解し、並行して開発を進めています。

Lv4とLv2どちらも開発している会社は世界的に見ても少ないと思います(インテル子会社のMobileyeも取り組んでいるように見えます)。

その上で、Baiduが作っているEV(付録参照)に搭載していこうとしているのは、中国の大企業の資本と開発力によるスピード感を感じます。

)

おわりに

Apolloの発表を聞いて感じたことは、その技術力はもちろんのこと、未来を見ているということです。今ある技術やこれまで培った知識を高いレベルで扱いながらも、最新技術を活かせばなにが実現できるかということを強く意識しているように感じます。

例えば、Apolloが自動運転の開発を始めた当初、Vision and Languageなどの技術は、現代ほど高度ではなかったはずです。しかし、今はそれを開発に組み込んでいます。最新技術を取り入れ続ける姿勢は見習いたいです。

また、解くべき問題の設定に関しても開発思想が顕著に現れているように感じます。

大人と子供は同じ「Pedestrian」ではないとか、とにかく大きいモデルを作って自動運転用に軽量化するとか、将来の自動運転を見据えて開発をしています。

Turingも、完全自動運転に必要な知能について真剣に考えています。既存の技術に敬意を払いつつ、どういう問題を解くべきかということを意識して開発を進めています。

AI開発チームでは、車線や前方車認識などの要素技術と並行して、Vision and Languageなどのマルチモーダル学習を通した基盤モデルの開発も進めています。また、実際にLv2とLv5の開発を現段階から並行して行っています。

成果物に関しては、DEIM2023で発表予定があったり第37回人工知能学会用の論文も執筆中です。また、今週金曜日(2/24)にTURING TECH DAYも開催します。今回はオンラインでの配信はないのですが、開発状況についてはいろいろな形でオープンにしていってワクワク感を感じてもらえるように頑張っていきたいと思います。

この記事を読んで、自動運転AIの開発に興味を持った方がいればぜひTuringの公式Webサイト、採用情報などをご覧ください。話だけ聞きたいという方は、私やAIチームのディレクターの山口さんのTwitter DMからでもお気軽にご連絡ください。

付録. Baiduが開発する電気自動車

この記事では主に Apollo Day 2022 を基にApolloの自動運転開発についてお話してきました。

ここでは付録として、Apolloは(正確に言えば親会社のBaiduが)電気自動車も作っているよという話をしたいと思います。

そもそもBaiduとは、2000年1月に創業された中国最大の検索エンジンを持つ中国の巨大IT企業です。アメリカのGAFAのように、中国にもBATHとよばれるIT企業群がありますが、そのBを担うのがBaiduです(他は、Alibaba, Tencent, Huawei)。

「All in AI」戦略のもと全社的にAIに注力しており、非常にAI領域に強いことで知られています。検索エンジンの他、webマーケティング、SNS、スマホアプリ、クラウド、IoT製品など幅広いプロダクト、サービスを手がけており、その中の一つに自動運転やEV(電気自動車)開発が有ります。

Baiduは「Apollo RT6」と「ROBO-01」というEVを発表しています。2つの違いは、自動運転タクシー用の商用向けか、一般向けに販売する市販車かどうかです。

「Apollo RT6」

Baiduは2022年6月に、ハンドルが取り外し可能なEVを発表しました。8つのLiDAR, 12の超音波センサ, 12台のカメラ, 6つのミリ波レーダの38センサがつけられており、Lv4の自動運転機能が搭載されるとのことです。1台あたりの製造コストは500万円前後と多くのセンサをつけたLv4自動運転EVとしては破格の安さと言えると思います。

搭載される自動運転機能は「20年以上の熟練ドライバーの技術に匹敵する」と発表されており、いわゆる市販車ではなく、2023年から中国国内の無人タクシーサービスに利用されていく予定です。

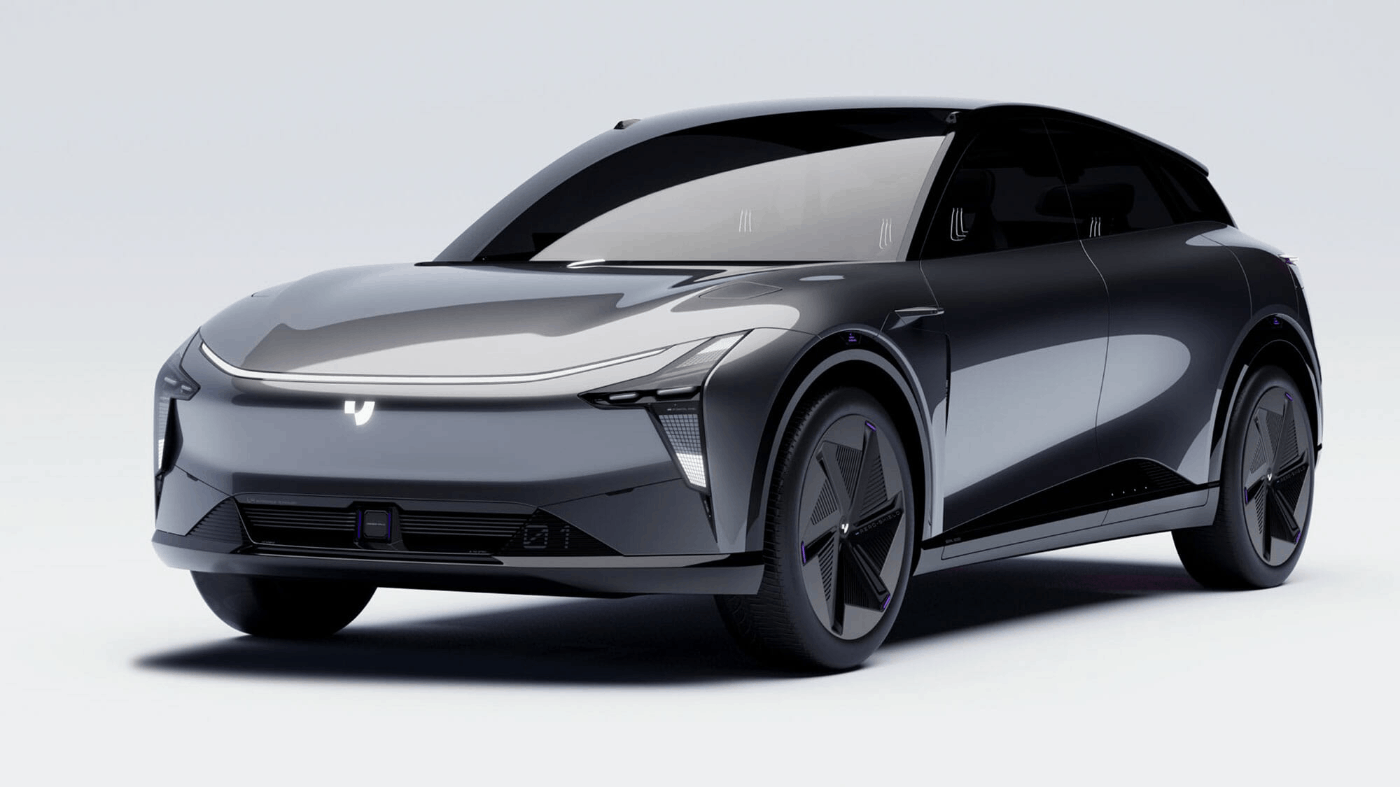

「ROBO-01」

Baiduは、中国の既存自動車メーカーである吉利汽車(GEELY)と共同で、2021年3月に集度汽車(JiDU)というEVメーカーを設立しています。

2022年6月に「ROBO-01」というEVのプロトタイプを発表し、価格は400万円超と発表されています。こちらもLiDARなどのセンサがついており、高精度な自動運転機能が搭載されるとのことです。上の「Apollo RT6」が商用車なのに対してこちらは市販車となっており、高いデザイン性が実現されているように見えます。センサもりもりなのにかっこいいのは凄いです。かっこいい。

このように、Baiduは電気自動車の開発も進めており、そこにApolloの自動運転を搭載し一般向けにも販売していくことを予定しています。自動運転と電気自動車双方の開発に今後も注目です。

Discussion

ネットもスマホもクラウドも負けている日本は、自動運転でも負けると危惧しています。

Turing 社が先駆けになることを期待しています!

コメントありがとうございます!がんばっていきます!