〜カメラシステム全史〜Vision Proから振り返るモバイル領域におけるカメラシステムの進化

はじめに

おはこんばんちは、あやめです!

皆さんにとって、2023年のテック発表・オブ・ザ・イヤーは何だったでしょうか?

私は、6月5日(アメリカ時間)に行われたAppleのVision Proの発表です。

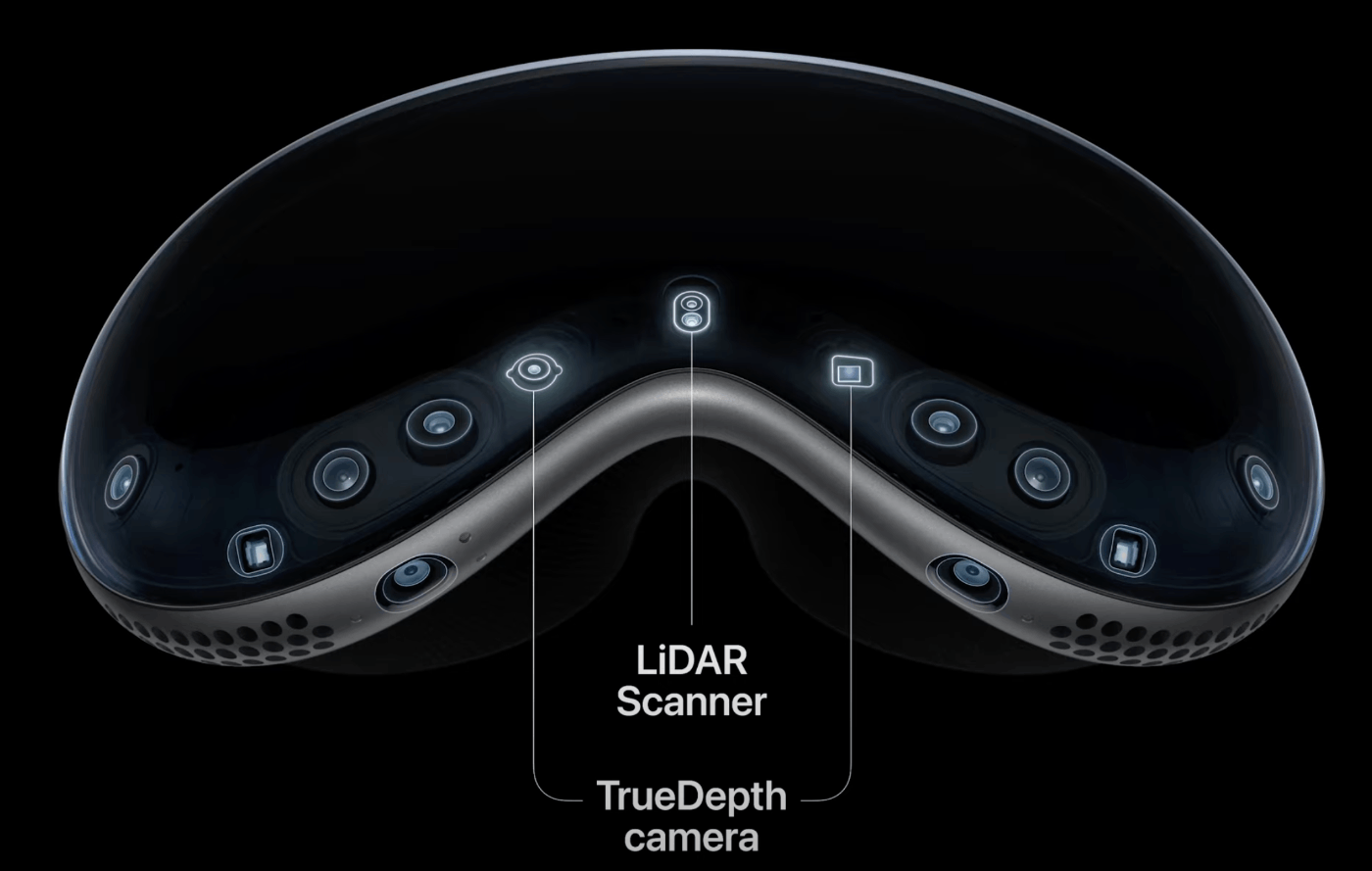

この記事では、Vision Proに搭載される3種類のカメラ技術RGBカメラ、IRカメラ、そしてLiDARに焦点を当て、それぞれの特性と応用について探求します。これらの技術がどのように私たちの日常生活に溶けこみ、将来的にどのような可能性を持つかを分析します。各セクションでは、現在の技術の状況、将来の展望、そして社会への影響について私見も含めて述べます。技術者、この分野に関心を持つ人々、社会に新たな価値を生み出そうとする野心家など、多くの読者に対して、過去・現在・未来のテクノロジーの流れに関する深い洞察と理解を提供することを目指しています。

RGBカメラ

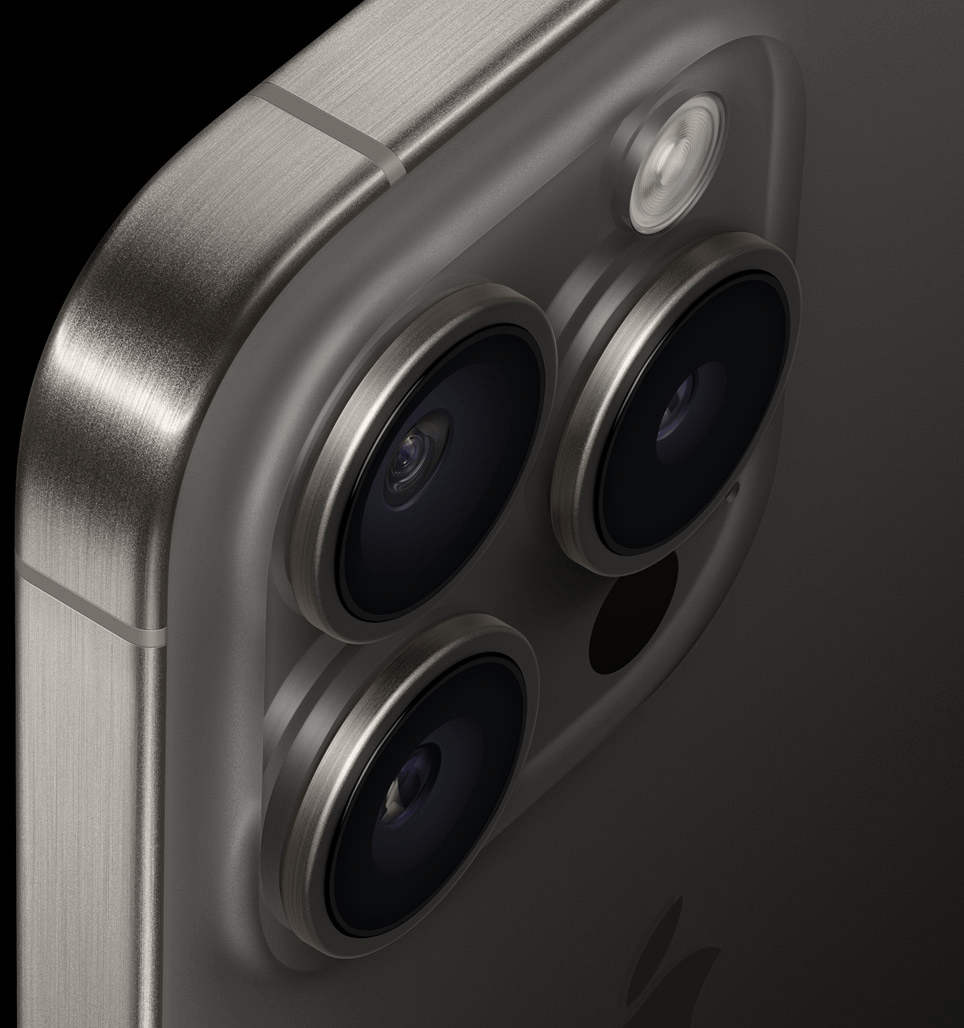

https://www.apple.com/jp/iphone-15-pro/ より

SNSの勃興とスマホカメラの発展

Twitter、Instagram、TikTokなどに代表されるSNS(ソーシャルネットワーキングサービス)の普及は、モバイル領域でのカメラ技術の進歩を促し、誰もが高品質なビジュアルコンテンツを作成しやすくなりました。SNSとスマホカメラにおける密接な関連性について以下があります。

-

ユーザー生成コンテンツの増加:

SNSの普及は、ユーザーが自らの経験や生活を共有する文化を生み出しました。これにより、高品質な画像と動画の需要が高まり、イメージセンサーの発展を促進しました。 -

ビジュアルコンテンツの優位性:

SNS上でのエンゲージメントは、ビジュアルコンテンツによって大きく左右されます。鮮明で魅力的な画像や動画は、より多くのいいねやシェアを獲得しやすいため、ユーザーは高品質なイメージセンサーを求めるようになりました。 -

リアルタイム共有とライブストリーミングの人気:

SNS上でのリアルタイム共有やライブストリーミングの人気が高まるにつれ、低遅延で高解像度の映像を提供するイメージセンサーの需要が増加しました。 -

マーケティングと広告の変化:

SNSがマーケティングの主要なプラットフォームとなるにつれ、企業は魅力的なビジュアルコンテンツを作成するために高度なカメラを活用するようになりました。

これらの相互作用は、今後もテクノロジーとメディアの両分野でのイノベーションを促進すると考えられます。

【スティーブ・ジョブズ】22年前 SNS時代の到来を予言 iPhoneの開発前のインタビュー【2001年放送】[クローズアップ現代] | NHK

コンピュテーショナルフォトグラフィーによる強化

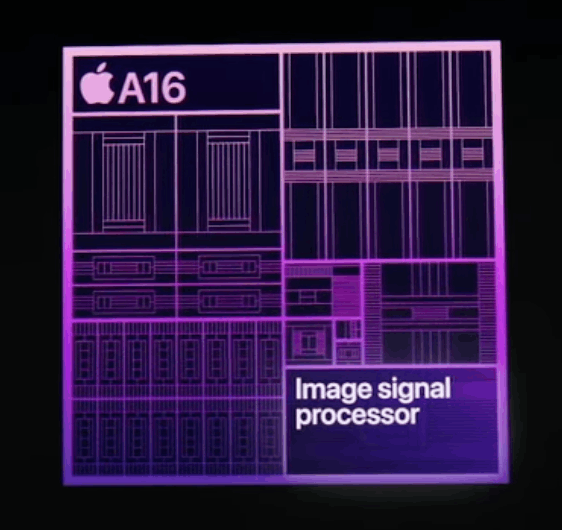

コンピュテーショナルフォトグラフィーは、従来の光学的な手法のみに頼ることなく、デジタル画像処理技術も利用して写真の品質を向上させる技術です。この分野の進化により、スマートフォンは低照度環境での撮影や高ダイナミックレンジ(HDR)写真、さらにはポートレートモードなど、かつては専門的なカメラ機材でしか実現できなかった機能を提供できるようになりました。これは、計算能力が画像処理において重要な役割を果たすようになったことを示しています。[1]

https://www.youtube.com/live/ux6zXguiqxM?si=hU-8_qK7AjlSID7e&t=4721 より

未来展望:大規模言語モデルとの融合

これは私見ですが、大規模言語モデルとカメラ技術が融合することで、さらなるイノベーションが起こると考えています。以下に考えられる例をいくつか挙げておきます。

-

写真撮影のリアルタイム最適化:

被写体の識別、画像のコンテキスト理解、そしてユーザーの意図を解釈をします。ユーザーエクスペリエンスを劇的に向上させ、写真撮影の新たな可能性を開くことになるでしょう。 -

拡張現実によるリアルタイム翻訳:

スマートフォンカメラで撮影した看板やメニューのテキストをリアルタイムで翻訳し、拡張現実(AR)を通じてオーバーレイ表示する。大規模言語モデルが精度の高い翻訳を提供し、国際的なコミュニケーションの障壁を低減します。 -

画像に基づく情報検索と分析:

写真やビデオを撮影し、その内容に基づいて詳細な情報を言語モデルが提供する。例えば、植物や動物の種類の識別、歴史的建造物の背景情報などが得られます。 -

視覚障害者のためのアシストテクノロジー:

スマートフォンカメラで撮影した周囲の環境を解析し、大規模言語モデルを用いて視覚障害者に対して音声で詳細な説明を提供する。これにより、視覚障害者の日常生活の自立を支援します。 -

個人化されたショッピングアシスタント:

商品をカメラで撮影することで、その商品に関連するレビュー、価格比較、おすすめの購入場所などの情報を言語モデルが提供します。 -

教育と学習の支援:

教科書やノートの写真から重要な情報を抽出し、学習者にカスタマイズされた要約や解説を提供します。これは学生にとって非常に有用な学習ツールとなるでしょう。 -

ヘルスケアアプリケーション:

皮膚の状態や症状の写真を分析し、健康に関する基本的な助言や専門家の診察を受けるべきかどうかの推奨を提供します。

このように、RGBカメラと大規模言語モデルの融合は、多岐にわたる分野で革新的なアプリケーションを生み出す可能性を秘めています。これらの進展は、日常生活を豊かにし、新たな価値を創出するでしょう。

IRカメラ

なぜIR光(Infrared)を用いるのか?

赤外線(せきがいせん)は、可視光線の赤色より波長が長く(周波数が低い)、電波より波長の短い電磁波のことである。ヒトの目では見ることができない光である。英語では infrared といい、「赤より下にある」「赤より低い」を意味する(infra は「下」を意味する接頭辞)。分光学などの分野ではIRとも略称される。対義語に、「紫より上にある」「紫より高い」を意味する紫外線(英:ultraviolet)がある。

https://ja.wikipedia.org/wiki/赤外線 より

ヒトの目では見ることができないからです。(紫外線も見えないですが、日焼けします)

もし何かの間違いで可視光を用いていたならば、現在私たちの目の前にはサイケデリックな光景が広がっていることでしょう。

https://www.youtube.com/live/GYkq9Rgoj8E?si=7dVEI0nyQHga58oc&t=6627 より

ストラクチャードライト

ストラクチャードライト(Structured Light)は、3Dスキャンや物体認識に使用される技術の一つです。この技術の基本的な原理は、特定のパターン(通常は線や格子状)の光を物体に投影し、その光の反射や歪みを捉えることによって、物体の3次元的な形状を計測することです。

メリット

-

高精度な3Dデータの取得:

光のパターンが物体に反射する様子を分析することで、高い精度で物体の表面形状を捉えることができます。 -

非接触測定:

物体に直接触れることなく測定を行うため、デリケートな物体や小さな物体の測定に適しています。 -

速度:

一般的に高速でデータ取得が可能であり、リアルタイムでの処理や動的なシーンのキャプチャに利用されることがあります。

デメリット

-

環境の影響:

外光や周囲の照明によって測定精度が影響を受けることがあります。 -

複雑な表面の取り扱い:

透明な物体や光沢のある表面は、反射や屈折によって正確なデータ取得が難しくなることがあります。

見えない光を用いたストラクチャードライト

AppleのユーザーであればFace IDを使用されている方は多いと思います。このFace IDを可能にしているTrueDepthカメラシステム(Apple呼称)の実態は、人間には見えない近赤外光の照明パターンを用いたストラクチャードライトです。

Face ID を実現したテクノロジーは、Apple がこれまでに開発した中でも一二を争う最先端のハードウェア/ソフトウェアと言えるでしょう。TrueDepth カメラは、何千もの目に見えないドットを顔の上に投射して解析し、顔の深度マップを作成して、顔の正確なデータを読み取ります。また、顔の赤外線イメージも取り込みます。A11、A12 Bionic、A12X Bionic、A13 Bionic、A14 Bionic、A15 Bionic チップのニューラルエンジンの一部 (Secure Enclave の中で保護されています) が、深度マップと赤外線イメージを数学的モデルに変換し、そのモデルを登録済みの顔のデータと照合します。

https://support.apple.com/ja-jp/102381 より

皆さんは初代Kinectを知ってますか?MicrosoftがXboxの周辺機器として販売していたもので、現在Appleが採用しているTrueDepthカメラと同じ構成をしていました。実は、これらは元々PrimeSenseというイスラエルの会社が開発していた技術で、2013年にAppleが買収し2017に初めてiPhoneXでTrueDepthカメラが搭載されたという経緯があるのです。[2]

アイトラッキング

https://www.youtube.com/live/GYkq9Rgoj8E?si=T-xEpDhj1DckadsN&t=6629 より

AR/VRで用いられる一般的なアイトラッキング方法は、眼球に光を当てその反射光と瞳孔の位置のパターンから視線を推測します。 具体的な推測アルゴリズムについては様々な方法が考えられ、おそらく各社それぞれ秘伝のアルゴリズムを使っていると思います。

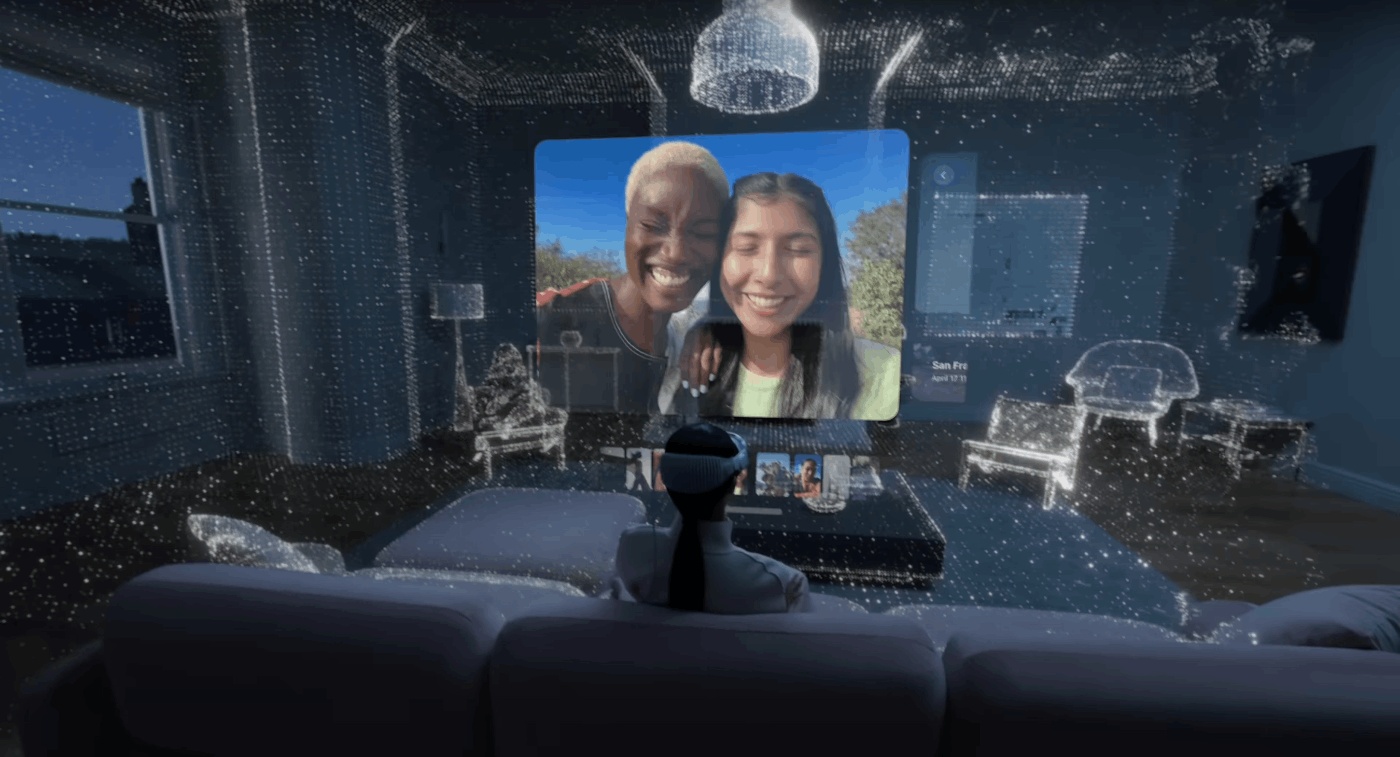

AR/VRにおいてIRカメラは、精密なアイトラッキングを実現するために不可欠な要素です。AR/VRアプリケーションでは、ユーザーの視線に基づいて仮想環境の反応を変えることで、より没入感の高い体験を提供できることがわかっています。

完全に私見ですが、アイトラッキングは今後ますます伸びてくるんじゃないかと考えています。精度、応答速度およびエネルギー効率の良いデバイスが日々開発されており、これからますますウェアラブルデバイスやモバイルデバイスへの統合が進んでいくでしょう。将来的には、アイトラッキング技術は日常生活の中でより身近な存在になり、例えば、ショッピングやナビゲーションアシスタンスなど、個人の日常生活を豊かにするためのツールとして活用されるようになると期待しています。

LiDAR

https://youtu.be/TX9qSaGXFyg?si=zjgYph6N5xtu1lYx&t=496 より

LiDARの種類

LiDAR(Light Detection and Ranging)は、光を使用して距離を測定し、物体の位置や形状を把握する技術です。この代表的な技術として、dToF(Direct Time of Flight)とiToF(Indirect Time of Flight) が存在しており、この2つは物体までの距離を測定する方法に違いがあります。[3]

2つの方式の特徴は以下です。

-

精度と距離:

dToFはより正確な距離測定を提供し、長距離測定に適していますが、iToFは短距離測定に適しており、一般的には低コストです。 -

応用分野:

dToFは自動車の衝突回避システムやドローンのナビゲーションに使用されることが多く、iToFはスマートフォンやタブレットの近接センサーや3Dイメージングに使われます。

ただApple製品の載っているのはdToF方式だそうです。[4]

個人的にiToFが採用されない理由として、TrueDepthという完成したシステムがあるから、短距離測定を強みとするiToFを必要としていないのだろうと推測しています。

LiDARの将来応用と社会影響

LiDAR技術は、社会に大きな影響を与え始めています。現代のLiDARシステムは、自動車の自動ブレーキシステム、ドローンの飛行制御、地理情報システム(GIS)のデータ収集など、幅広い応用が見られます。また、建設、農業、地質学などの分野でも重要な役割を果たしています。これらの例のように、すでにLiDARは現代社会において不可欠なテクノロジーとなっています。

今後は、私たちの生活により近い部分での応用が期待されています。例えば、自動運転車の普及により、交通安全が大幅に向上し、道路渋滞の軽減や環境への影響が減少する可能性があります。また、AR/VR技術の進化により、教育、医療、エンターテイメントなど、日常生活のあらゆる面での体験が変革されるでしょう。さらに、都市計画や環境モニタリングにおいても、LiDARの精密な3Dマッピング能力が重要な役割を果たすことが予想されます。このように、LiDAR技術は私たちの生活を根底から変える可能性を秘めており、その進化と応用に注目が集まっています。

はしがき

この記事では、Vision Proを題材にしつつ、先進技術におけるカメラ技術の重要性と潜在力を探究しました。RGBカメラ、IRカメラ、そしてLiDARはそれぞれ独自の機能と応用分野を持ち、これらの技術の組み合わせにより、未来のテクノロジーがどのように進化するかを掘り下げています。今後、これらの技術がさらに進化し、日常生活のさまざまな側面に革新をもたらすことを期待しています。また、その発展に貢献できることを願っています。

情報収集・アウトプットようにXのアカウントを開設したので、ぜひフォローよろしくお願いします!

Discussion