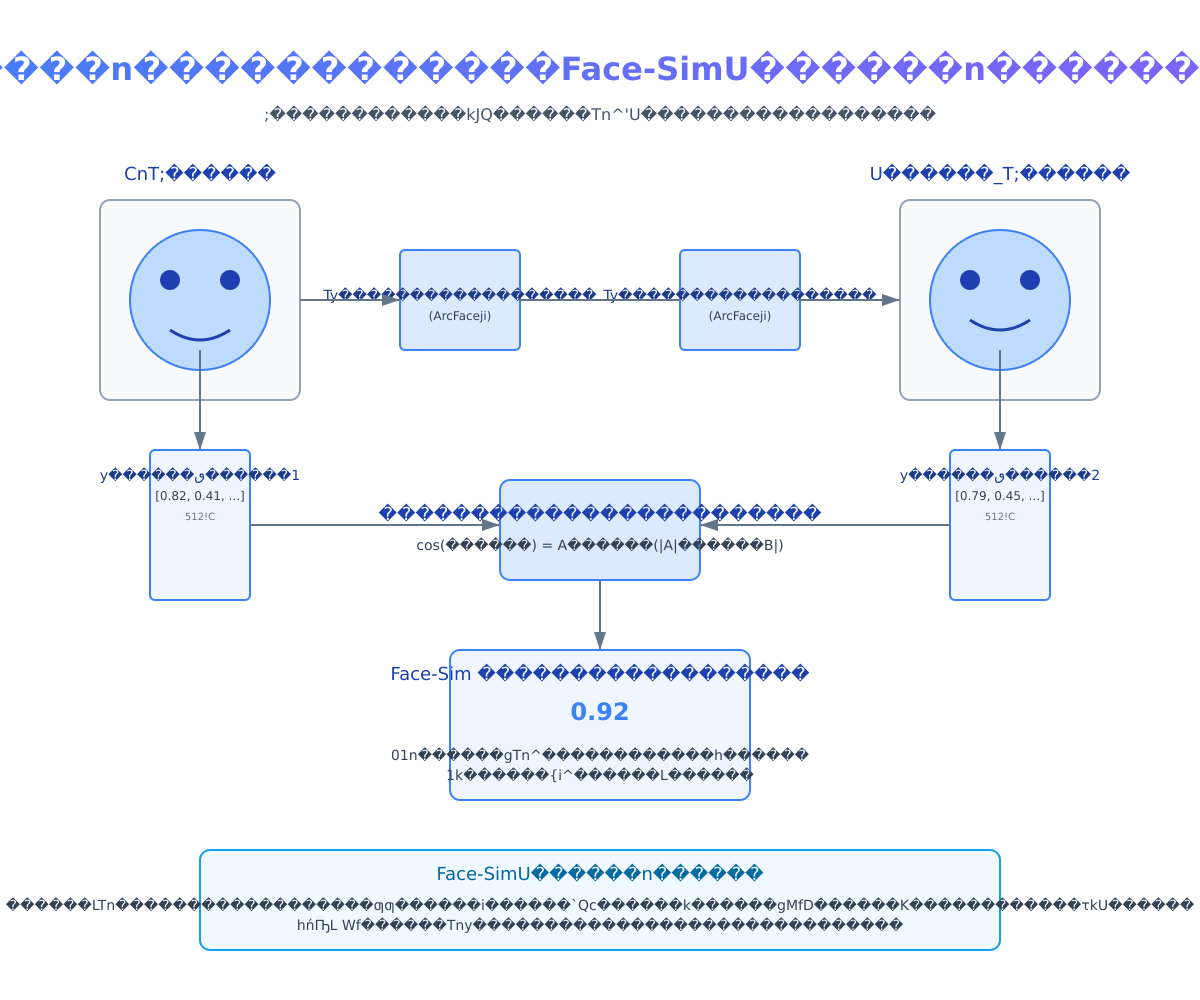

うさぎでもわかるFace-Sim評価指標 〜画像・動画生成における顔の類似性評価〜

うさぎでもわかるFace-Sim評価指標 〜画像・動画生成における顔の類似性評価〜

👇️PodCastでも聴けます

みなさんこんにちは!🐰です。

最近、AI画像生成や動画生成の技術は急速に発展し、特に人物の顔を生成するタスクが重要になっています。でも、「生成された顔が元の顔とどれくらい似ているか?」を客観的に評価するのは難しい問題なんです。

そこで今回は、Face-Sim(フェイスシム)という顔の類似性を評価するための指標について解説します。Face-Simは最新の顔認識技術を活用して、生成された顔画像と元の顔画像の類似度を定量的に測定できる強力なツールです。

この記事を読めば、画像生成モデルや動画生成モデルの評価に役立つFace-Simの基本概念から実装方法まで、しっかり理解できるはずです。それでは早速見ていきましょう!

目次

背景

画像生成や動画生成の分野では、生成結果の「質」を評価することが非常に重要です。一般的に画像生成の評価には、FID(Fréchet Inception Distance)やLPIPS(Learned Perceptual Image Patch Similarity)などの指標が使われていますが、これらは必ずしも「顔」の類似性に特化したものではありません。

特に顔の生成では、人間は顔の微妙な違いに非常に敏感なため、一般的な画像評価指標では不十分なことが多いです。例えば、ある人物の顔を別の動作や表情で生成する場合、顔のアイデンティティは保存されつつも、表情や角度が変化することが求められます。

このような背景から、顔に特化した評価指標であるFace-Simが開発され、画像・動画生成の研究やアプリケーション開発において重要な役割を担っています。

Face-Simとは

Face-Sim(フェイスシム)は、顔画像間の類似性を定量的に評価するための指標です。正式には「Cosine Similarity」(コサイン類似度)もしくは「CSIM」と呼ばれることもあります。この指標は主に、元の顔画像と生成された顔画像の間で、「同じ人物であるかどうか」を評価するために使用されます。

Face-Simの特徴

Face-Simには以下のような特徴があります:

-

顔の同一性に特化:Face-Simは顔のアイデンティティ(同一性)を評価するために最適化されています。顔のポーズや表情が変わっても、同じ人物の顔かどうかを正確に評価できます。

-

0〜1の範囲のスコア:Face-Simは通常0〜1の範囲の値をとり、1に近いほど顔の類似性が高いことを示します。一般的に0.5以上で同一人物と判断される場合が多いですが、実際のしきい値はアプリケーションによって調整されます。

-

深層学習ベース:Face-SimはArcFaceなどの最先端の顔認識モデルを使用して特徴を抽出し、高次元の特徴空間でのコサイン類似度を計算します。

-

人間の知覚との相関:Face-Simのスコアは人間の顔認識能力と高い相関を持つよう設計されており、人間が「同じ人物だ」と判断する顔のペアは、高いFace-Simスコアを示します。

Face-Simの主な用途

Face-Simは以下のような場面で活用されています:

- 顔スワップ技術の評価:顔の入れ替え(フェイススワップ)の品質評価

- アイデンティティ保存の検証:スタイル変換や年齢変換後も元の人物の特徴が保持されているかの確認

- 動画生成の一貫性評価:生成された動画内での顔の一貫性の測定

- 異なるポーズ・表情での同一性検証:異なるポーズや表情でも同じ人物かを評価

Face-Simは単なる画像の見た目の類似性ではなく、顔の本質的な特徴に基づいた類似性を測定するため、画像生成技術の評価において非常に重要な指標となっています。

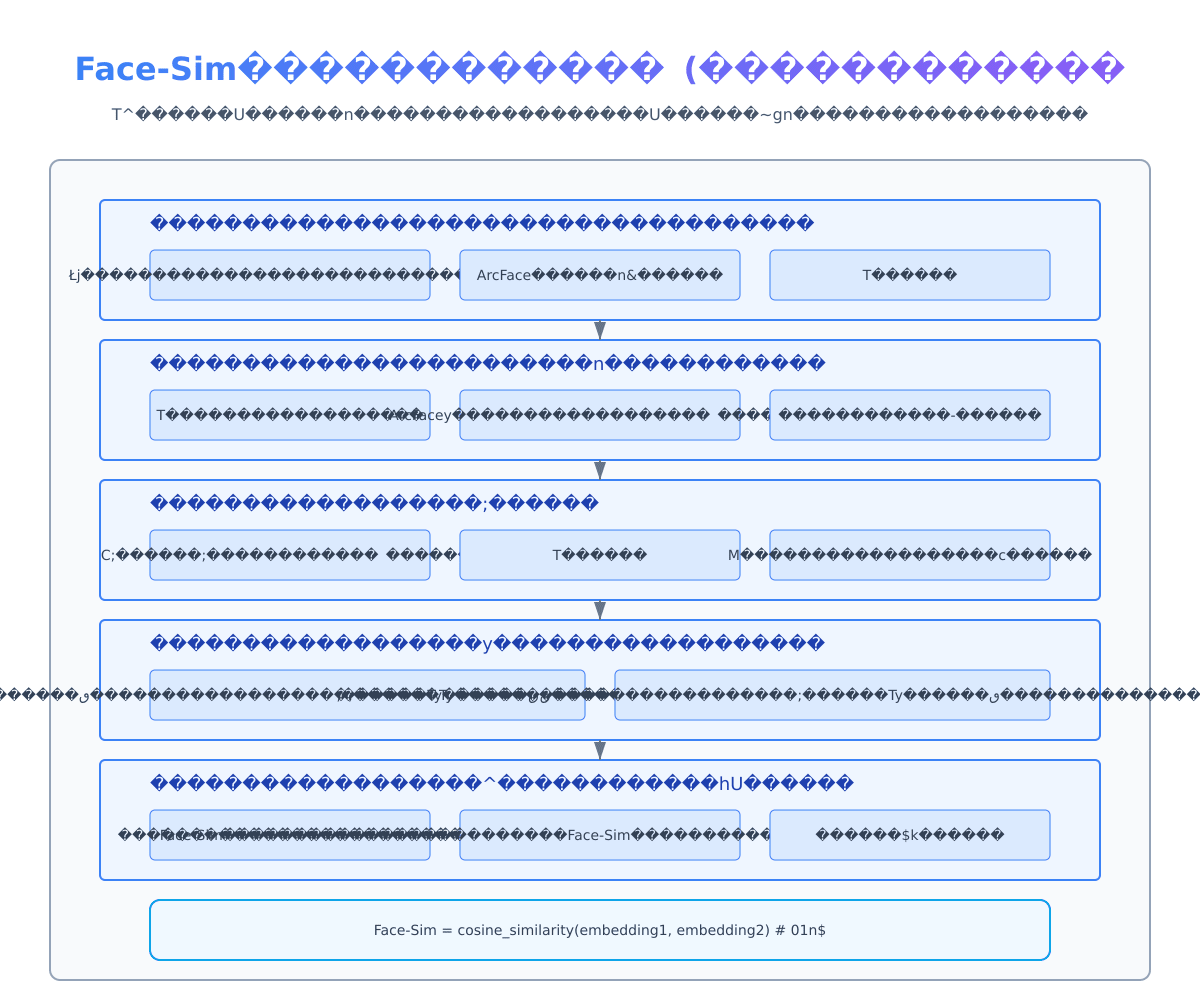

Face-Simの技術的な仕組み

Face-Simが顔の類似性を評価する技術的な仕組みについて、もう少し詳しく見ていきましょう。

ステップ1: 顔検出とアライメント

まず最初に、評価対象の画像から顔領域を検出します。この段階では、RetinaFaceなどの高精度な顔検出モデルが使用されます。検出された顔は、以下のような前処理が施されます:

- 顔領域の切り出し:顔の周囲の余分な背景を除去

- 顔のアライメント:目や口などの顔のランドマーク(特徴点)を基準に顔を整列

- サイズ統一:通常112×112ピクセルなどの固定サイズにリサイズ

- 正規化:ピクセル値を適切な範囲(-1〜1など)に正規化

これらの前処理によって、様々な条件(明るさ、角度、サイズなど)の顔画像を統一的に扱えるようになります。

ステップ2: 特徴抽出(ArcFace)

前処理された顔画像は、ArcFace(Additive Angular Margin Loss for Deep Face Recognition)などの顔認識モデルに入力されます。ArcFaceは以下のような特徴を持つモデルです:

- ResNet-50/100ベースのアーキテクチャ:深層畳み込みニューラルネットワーク

- 角度マージン損失関数:顔の特徴をより識別性の高い表現に変換

- 512次元の特徴ベクトル出力:顔の特徴を512次元のベクトルとして表現

ArcFaceモデルは大規模な顔データセット(数百万の顔画像)で事前学習されており、人種、年齢、照明条件などの様々な変動に対して頑健な特徴抽出が可能です。

ステップ3: コサイン類似度計算

2つの顔画像から抽出された特徴ベクトル(512次元)間のコサイン類似度を計算することで、Face-Simスコアを得ます:

def calculate_face_sim(embedding1, embedding2):

# L2正規化(ベクトルの長さを1に統一)

embedding1 = embedding1 / np.linalg.norm(embedding1)

embedding2 = embedding2 / np.linalg.norm(embedding2)

# コサイン類似度の計算

similarity = np.dot(embedding1, embedding2)

return similarity # 0〜1の値

コサイン類似度は、二つのベクトル間の角度のコサインを計算することで類似性を測定します。値が1に近いほど、二つのベクトルの方向が近い(=顔が類似している)ことを意味します。

ArcFaceの詳細

ArcFaceはFace-Simの根幹を成す技術であり、以下のような特徴があります:

- 角度マージン(Angular Margin):通常のソフトマックス損失に角度マージンを追加することで、特徴空間での各クラス(人物)の分離性能を向上

- 特徴の正規化:特徴ベクトルを超球面上に投影することで、ベクトルの長さではなく方向のみで類似性を判断

- 高い精度:顔認識の標準的なベンチマークであるLFW(Labeled Faces in the Wild)データセットで99.83%という高い精度を達成

このように、Face-SimはArcFaceの強力な特徴抽出能力を活用して、顔の本質的な特徴を捉え、様々な表情や角度の変化にも頑健な類似性評価を実現しています。

Face-Simの実装方法

実際にFace-Simを実装して使用する方法について説明します。Pythonを使った実装例を見ていきましょう。

必要なライブラリとツール

Face-Simを実装するには、以下のライブラリが必要です:

# 必要なライブラリのインストール

pip install numpy opencv-python insightface onnxruntime

- NumPy: 数値計算ライブラリ

- OpenCV: 画像処理ライブラリ

- InsightFace: ArcFaceなどの顔認識モデルを提供するライブラリ

- ONNX Runtime: モデルの推論エンジン

基本的な実装コード

以下に、InsightFaceを使ったFace-Simの実装例を示します:

import cv2

import numpy as np

import insightface

from insightface.app import FaceAnalysis

# FaceAnalysis初期化(顔検出と特徴抽出を行うクラス)

face_analyzer = FaceAnalysis(name='buffalo_l', root='./models')

face_analyzer.prepare(ctx_id=0, det_size=(640, 640))

def extract_face_embedding(image_path):

"""画像から顔特徴ベクトルを抽出する関数"""

# 画像読み込み

img = cv2.imread(image_path)

# BGR -> RGB変換(InsightFaceはRGBを想定)

img = cv2.cvtColor(img, cv2.COLOR_BGR2RGB)

# 顔検出と特徴抽出

faces = face_analyzer.get(img)

if len(faces) == 0:

raise ValueError("顔が検出されませんでした")

# 最も大きい顔(主要な顔)の特徴ベクトルを返す

# 複数の顔がある場合は、最も大きい顔(中心的な顔)を使用

faces = sorted(faces, key=lambda x: x.bbox[2] - x.bbox[0], reverse=True)

embedding = faces[0].embedding

return embedding

def calculate_face_sim(embedding1, embedding2):

"""2つの顔特徴ベクトル間のFace-Sim(コサイン類似度)を計算"""

# 既に正規化されている場合もあるが、念のため正規化

embedding1 = embedding1 / np.linalg.norm(embedding1)

embedding2 = embedding2 / np.linalg.norm(embedding2)

# コサイン類似度計算

similarity = np.dot(embedding1, embedding2)

return similarity

# 使用例

def compare_faces(image1_path, image2_path):

"""2つの画像の顔類似度を計算"""

# 特徴抽出

embedding1 = extract_face_embedding(image1_path)

embedding2 = extract_face_embedding(image2_path)

# Face-Sim計算

sim_score = calculate_face_sim(embedding1, embedding2)

return sim_score

# 実行例

if __name__ == "__main__":

# 元画像と生成画像のパス

original_image = "original_face.jpg"

generated_image = "generated_face.jpg"

# 類似度計算

similarity = compare_faces(original_image, generated_image)

print(f"Face-Sim Score: {similarity:.4f}")

# 閾値による判定(例: 0.5以上で同一人物と判断)

threshold = 0.5

if similarity >= threshold:

print("同一人物と判定されました")

else:

print("異なる人物と判定されました")

パラメータの調整

Face-Simを実際に使用する際は、以下のパラメータを調整することで、評価の精度や用途に合わせた設定が可能です:

- 類似度の閾値:何点以上で同一人物と判断するかの閾値。用途によって0.3〜0.7の範囲で調整

- 検出サイズ:顔検出時の画像サイズ。大きいほど小さな顔も検出できるが処理時間増加

- モデルの選択:buffalo_l, buffalo_s, buffalo_mなど異なるサイズのモデルから選択可能

- 前処理方法:顔アライメントの方法やサイズ調整方法をカスタマイズ可能

バッチ処理による効率化

多数の画像ペアを評価する場合は、バッチ処理によって効率化することも可能です:

def batch_compare_faces(original_images, generated_images):

"""複数の画像ペアをバッチ処理"""

results = []

# 特徴抽出を一度に行う

original_embeddings = [extract_face_embedding(img) for img in original_images]

generated_embeddings = [extract_face_embedding(img) for img in generated_images]

# 類似度計算

for orig_emb, gen_emb in zip(original_embeddings, generated_embeddings):

sim = calculate_face_sim(orig_emb, gen_emb)

results.append(sim)

return results

実装時の注意点

- 顔検出精度:顔が正確に検出できない場合、類似度の精度が低下します。十分な解像度と明るさの画像を使用しましょう。

- 複数の顔:一つの画像に複数の顔がある場合は、どの顔を評価対象とするかを明確にする必要があります。

- 計算コスト:大量の画像を処理する場合はGPUの使用を検討しましょう。

- 前処理の一貫性:元画像と生成画像には同じ前処理を適用することが重要です。

以上の方法で、Face-Simを実装し、生成された顔画像の品質評価に活用することができます。次に、実際の使用例を見ていきましょう。

実際の使用例

Face-Simは様々な画像生成・動画生成タスクの評価に使われています。具体的な使用例を見ていきましょう。

顔スワップ技術の評価

顔スワップ(フェイススワップ)技術では、ある人物の顔を別の人物の顔に置き換えます。この技術の評価では、以下のような観点からFace-Simが活用されます:

- ターゲット保存率の評価:生成された顔がターゲット(置き換えたい人物)とどれだけ似ているか

- 一貫性の評価:動画内の連続したフレーム間での顔の一貫性

実際の研究事例では、DaGAN、FOMM、LIAなどの顔生成モデルの性能比較にFace-Simが使用されています。これらのモデルは、Face-Simスコアが0.8以上で高品質な顔スワップが実現できていると評価されています。

年齢変換の評価

年齢変換技術(若返りや老化シミュレーション)では、以下の観点でFace-Simが活用されます:

- アイデンティティ保存:年齢を変えても元の人物の特徴が保持されているか

- 自然さの評価:年齢変換が自然に見えるか

例えば、あるAI老化アプリケーションでは、Face-Simスコアが0.7以上の場合にアイデンティティが適切に保存されていると判断しています。

動画生成の一貫性評価

AI動画生成では、連続するフレーム間での顔の一貫性が重要です。Face-Simを使って、以下のような評価が行われています:

- フレーム間一貫性:連続するフレーム間での顔の類似性

- 参照画像との一貫性:元の参照画像と生成された各フレームの顔との類似性

例えば、ある研究では以下のような評価方法を採用しています:

def evaluate_video_consistency(video_frames, reference_image):

# 参照画像からの特徴抽出

ref_embedding = extract_face_embedding(reference_image)

# 各フレームの一貫性評価

frame_scores = []

for frame in video_frames:

frame_embedding = extract_face_embedding(frame)

score = calculate_face_sim(ref_embedding, frame_embedding)

frame_scores.append(score)

# 平均スコアと標準偏差(変動性の指標)を計算

avg_score = np.mean(frame_scores)

std_score = np.std(frame_scores)

return {

"average_similarity": avg_score,

"consistency": 1 - std_score # 標準偏差が小さいほど一貫性が高い

}

このようなアプローチで、動画の一貫性スコアを0〜1の範囲で評価することができます。

商業利用での閾値設定例

実際の商業アプリケーションでは、以下のような閾値設定が見られます:

- 本人認証システム:0.6以上で本人と判定(セキュリティ重視)

- 顔スワップアプリ:0.5以上で同一人物の品質と判定(ユーザー体験重視)

- 動画生成:0.7以上のフレーム間一貫性を目標(高品質重視)

研究事例:「A Comprehensive Framework for Evaluating Deepfake Generators」

2023年のICCV(国際コンピュータビジョン会議)では、ディープフェイク生成技術の評価フレームワークを提案する研究が発表されました。この研究では、Face-Sim(CSIM)をはじめとする複数の評価指標を組み合わせたフレームワークが提案されています。

評価結果では、最新の顔生成モデルがFace-Simで0.85前後のスコアを達成していることが報告されており、人間の知覚的評価とも高い相関を示しています。

このように、Face-Simは顔画像生成・動画生成の分野で幅広く活用され、技術の進化を定量的に評価する上で重要な役割を果たしています。

他の顔類似性評価指標との比較

Face-Simは顔の類似性を評価する唯一の指標ではありません。他の代表的な画像評価指標と比較しながら、Face-Simの特性を見ていきましょう。

SSIM(Structural Similarity Index Measure)

SSIMは画像の構造的類似性を評価する指標です:

- 計算方法:輝度、コントラスト、構造の3要素から類似性を計算

- 特徴:ピクセルレベルでの比較に基づく

- 長所:計算が比較的簡単で、広く使われている

- 短所:ポーズや表情の変化に弱く、顔の同一性評価には不向き

SSIMはFace-Simと比べて以下の点で異なります:

- Face-Simは顔の本質的な特徴に基づく評価であるのに対し、SSIMは画像の見た目の類似性を評価

- Face-Simはポーズや表情が変わっても同一人物を正確に評価できるが、SSIMはピクセル位置の変化に敏感

LPIPS(Learned Perceptual Image Patch Similarity)

LPIPSは深層学習に基づく知覚的類似性指標です:

- 計算方法:事前学習されたCNN(VGGなど)の特徴空間での距離を測定

- 特徴:人間の知覚と相関が高い類似性評価

- 長所:テクスチャや局所的特徴の評価に優れている

- 短所:顔の同一性に特化していない

LPIPSとFace-Simの主な違い:

- LPIPSは一般的な画像の知覚的類似性を評価するのに対し、Face-Simは顔の同一性に特化

- LPIPSはより広い範囲の画像類似性タスクに適用可能だが、顔のアイデンティティ保存の評価ではFace-Simの方が適切

FID(Fréchet Inception Distance)

FIDは生成画像の分布全体を評価する指標です:

- 計算方法:InceptionNetの特徴空間での実画像と生成画像の分布間のFréchet距離

- 特徴:画像セット全体の評価に使用

- 長所:生成モデルの全体的な品質と多様性を評価できる

- 短所:個別の画像ペア評価には不向き、多数の画像サンプルが必要

FIDとFace-Simの比較:

- FIDは画像セット全体の評価に使用されるのに対し、Face-Simは個別の顔画像ペアの評価に使用

- FIDは一般的な画像生成の評価に広く使われるが、顔の同一性評価にはFace-Simが適している

使い分けの指針

これらの評価指標は目的に応じて使い分けることが重要です:

- 顔の同一性評価:Face-Sim(CSIM)

- 全体的な画像構造類似性:SSIM

- 人間の知覚に近い類似性評価:LPIPS

- 画像生成モデルの総合評価:FID

実際の研究やアプリケーション開発では、これらの指標を組み合わせて多角的に評価することが一般的です。例えば:

- 顔画像生成の評価:Face-Sim + LPIPS + FID

- 顔動画生成の評価:Face-Sim + 時間的一貫性指標 + FVD(Fréchet Video Distance)

このように、Face-Simは他の評価指標と補完関係にあり、特に顔のアイデンティティに関する評価において重要な役割を果たしています。

Face-Simの限界と課題

Face-Simは強力な顔類似性評価指標ですが、いくつかの限界や課題も存在します。実際の使用にあたっては、これらの点を理解しておくことが重要です。

1. 顔検出の依存性

Face-Simは顔検出の精度に強く依存します:

- 小さな顔や低解像度:顔が小さい、または解像度が低い場合、検出精度が低下

- 遮蔽物や極端な角度:顔の一部が隠れていたり、極端な角度だと検出が困難

- 照明条件:極端な照明条件(暗すぎる、明るすぎる)は検出精度に影響

例えば、マスクを着用した顔や、極端な角度(横顔など)では、顔検出自体が失敗する可能性があり、Face-Simの計算ができなくなります。

2. 計算コストと実装の複雑さ

Face-Simの計算には比較的高い計算リソースが必要です:

- モデルサイズ:ArcFaceモデルは100MB以上のサイズがあり、メモリ使用量が大きい

- 計算速度:GPUがなくても計算は可能ですが、多数の画像を処理する場合は遅くなる

- 実装の複雑さ:適切な前処理やモデルの選択など、実装には専門知識が必要

特にリアルタイム処理が必要なアプリケーションでは、計算コストが課題になることがあります。

3. 異なる人種や年齢への対応

ArcFaceモデルの学習データによっては、特定の人口統計グループでの性能に偏りが生じる可能性があります:

- 人種バイアス:学習データに偏りがあると、特定の人種の顔で精度が低下する可能性

- 年齢の影響:年齢差が大きい場合(子供から大人への変化など)の評価が難しい

- 性別による違い:性別によって特徴の捉え方に差がある可能性

最新のモデルでは多様なデータセットでの学習により、これらの問題は改善されていますが、完全に解決されているわけではありません。

4. 背景や顔以外の要素の無視

Face-Simは顔の特徴のみに焦点を当てており、以下のような要素は評価に含まれません:

- 背景:背景の類似性は評価されない

- 髪型:髪型の変化は評価に含まれないか、影響が小さい

- アクセサリー:眼鏡や帽子などのアクセサリーの類似性は考慮されない

これは顔の本質的な特徴を評価するという観点では長所ですが、画像全体の類似性を評価したい場合には限界となります。

5. 閾値設定の難しさ

Face-Simの適切な閾値(同一人物と判断する境界値)は用途によって異なり、設定が難しい場合があります:

- セキュリティ用途:高い閾値(0.7以上)で厳格に評価する必要あり

- エンターテイメント用途:ユーザー体験を重視した適度な閾値(0.5前後)が好ましい

- 研究用途:評価対象や目的に応じて適切な閾値を設定する必要あり

標準的な閾値は存在せず、アプリケーションごとに検証実験を行って決定する必要があります。

実例:実際の限界ケース

以下のような状況では、Face-Simの性能が低下することが知られています:

- 双子の区別:非常に似た顔(双子など)の区別は難しい場合がある

- 極端なメイク:強いメイクによって顔の特徴が大きく変化した場合

- 意図的な変装:変装や特殊メイクによって意図的に特徴を変えた場合

- 極端な表情:非常に誇張された表情は特徴抽出に影響する可能性がある

これらの限界を理解した上で、Face-Simを適切に活用することが重要です。次のセクションでは、Face-Simの将来の方向性と実用上の示唆について見ていきます。

将来の方向性と示唆

Face-Simの現在の限界を踏まえつつ、今後の発展方向と実務での活用に関する示唆を考えてみましょう。

技術の発展方向

Face-Sim技術は以下のような方向に発展していくと考えられます:

1. より頑健なモデルの開発

- マルチモーダルな特徴抽出:顔の形状、テクスチャ、表情など複数の特徴を組み合わせて評価

- 自己教師あり学習の活用:ラベルなしデータを活用した学習によるモデルの汎化性能向上

- 軽量かつ高精度なモデル:エッジデバイスでも動作可能な効率的なモデルアーキテクチャ

例えば、最新の研究では、トランスフォーマーベースのアーキテクチャを活用した特徴抽出モデルも提案されており、より複雑な顔の特徴を捉えられるようになっています。

2. 多様性と公平性の向上

- より多様なデータセット:様々な人種、年齢、性別を包括したデータセットでの学習

- 公平性メトリクスの導入:異なる人口統計グループ間での性能の公平性を評価

- 文化的文脈の考慮:文化による顔の認識や表現の違いを考慮したモデル

この方向性は、AIの公平性という大きな課題と結びついており、今後ますます重要になると考えられます。

3. 統合的な評価フレームワーク

- 複数指標の統合:Face-Sim、LPIPS、FIDなど複数の指標を組み合わせた総合評価

- タスク特化型評価:顔スワップ、年齢変換、表情操作など特定タスクに最適化された評価方法

- 人間の知覚との一致度向上:人間の主観評価と高い相関を持つ評価指標の開発

実際に、最近の研究では複数の評価指標を組み合わせたフレームワークが提案されています。

実務での活用に関する示唆

Face-Sim技術を効果的に活用するための示唆を以下にまとめます:

1. 適切なユースケースの選定

Face-Simが特に有効なユースケース:

- 顔認証システム:なりすまし検出や本人確認

- 顔生成モデルの評価:顔のアイデンティティ保存の検証

- 動画の顔一貫性評価:長時間動画内での顔の一貫性検証

不向きなユースケース:

- 全身画像の評価:顔以外の部分は評価できない

- 背景を含む画像生成評価:背景の評価には別の指標が必要

- リアルタイム処理が必須の軽量アプリ:計算コストの制約

2. 実装時の最適化

実務での実装時には以下の最適化を検討すべきです:

- モデル量子化:モデルサイズと推論速度の最適化

- バッチ処理:大量画像の処理時にはバッチ処理で効率化

- 前処理パイプラインの最適化:顔検出と特徴抽出の効率的な統合

- 閾値のチューニング:用途に応じた適切な閾値設定

# モデル最適化例(ONNXランタイム使用)

import onnxruntime as ort

# 高速化設定

sess_options = ort.SessionOptions()

sess_options.graph_optimization_level = ort.GraphOptimizationLevel.ORT_ENABLE_ALL

sess_options.intra_op_num_threads = 4 # 使用するスレッド数を指定

# 最適化されたセッション

session = ort.InferenceSession("arcface_model.onnx", sess_options)

3. 倫理的・法的考慮事項

Face-Sim技術の応用には以下の考慮が必要です:

- プライバシーへの配慮:顔データの取り扱いには十分な注意が必要

- 同意の取得:顔認識技術の使用に関するユーザーの明示的な同意

- バイアスの監視と軽減:異なるユーザーグループ間での公平性の確保

- 透明性の確保:技術の限界を含めた適切な情報開示

技術の開発・応用と並行して、これらの倫理的・法的側面についても十分な検討が求められます。

4. 実務者へのアドバイス

Face-Sim技術を活用する実務者への具体的なアドバイス:

- 複数のモデルを比較検証:InsightFace、FaceNet、Deeppthなど複数の実装を比較

- 適切なデータ前処理:顔のアライメント、正規化方法の最適化

- 継続的なモニタリング:異なる条件での性能を継続的に評価

- ユーザーフィードバックの活用:実際のユーザー体験を取り入れた改善

これらの示唆を参考に、Face-Sim技術を効果的に活用することで、顔画像生成・動画生成アプリケーションの品質向上に貢献できるでしょう。

まとめ

この記事では、Face-Sim(フェイスシム)評価指標について詳しく解説しました。Face-Simは画像・動画生成における顔の類似性を評価するための強力なツールであり、最新の顔認識技術を活用して顔のアイデンティティがどれだけ保存されているかを定量的に測定することができます。

Face-Simの重要ポイント

-

定義と原理:Face-Simは深層学習ベースの顔認識モデル(主にArcFace)を用いて顔の特徴ベクトルを抽出し、そのコサイン類似度を計算することで顔の類似性を0〜1の値で表現します。

-

技術的仕組み:顔検出・アライメント→特徴抽出(512次元ベクトル)→コサイン類似度計算という流れで評価を行います。

-

実装方法:InsightFaceなどのライブラリを使用して、Pythonで比較的容易に実装できます。

-

使用例:顔スワップ、年齢変換、動画生成の一貫性評価など、様々な顔生成タスクの評価に活用されています。

-

他指標との比較:SSIM、LPIPS、FIDなどの一般的な画像評価指標と比べて、顔のアイデンティティ評価に特化している点が大きな特徴です。

-

限界と課題:顔検出依存性、計算コスト、多様性への対応などの課題がありますが、継続的な改善が進められています。

-

将来性と示唆:より頑健で多様なモデルの開発、統合的な評価フレームワークの構築などが今後の発展方向として期待されます。

まとめのコード:シンプルな実装例

最後に、Face-Simの基本的な実装例をシンプルにまとめました:

import cv2

import numpy as np

from insightface.app import FaceAnalysis

# モデル初期化

app = FaceAnalysis(name='buffalo_l')

app.prepare(ctx_id=0) # CPU使用の場合は-1、GPU使用の場合は0以上

def face_sim(img1_path, img2_path):

# 画像読み込み

img1 = cv2.imread(img1_path)

img2 = cv2.imread(img2_path)

# RGB変換

img1 = cv2.cvtColor(img1, cv2.COLOR_BGR2RGB)

img2 = cv2.cvtColor(img2, cv2.COLOR_BGR2RGB)

# 顔検出と特徴抽出

faces1 = app.get(img1)

faces2 = app.get(img2)

if len(faces1) == 0 or len(faces2) == 0:

return "顔が検出できませんでした"

# 特徴ベクトル取得

embedding1 = faces1[0].embedding

embedding2 = faces2[0].embedding

# コサイン類似度計算

sim = np.dot(embedding1, embedding2) / (np.linalg.norm(embedding1) * np.linalg.norm(embedding2))

return sim

# 使用例

similarity = face_sim("original.jpg", "generated.jpg")

print(f"Face-Sim Score: {similarity:.4f}")

Face-Sim評価指標を活用することで、顔生成技術の品質を客観的に評価し、その改善に役立てることができます。特に人間の顔の微妙な特徴を捉える必要がある最新の画像・動画生成技術において、Face-Simは不可欠なツールとなっています。

今回の記事を参考に、皆さんの顔生成プロジェクトでもFace-Simを活用してみてください!🐰

Discussion