概要

深層学習における表現のDisentanglement具合を定量的に評価する指標であるDCI(Disentanglement/Completement/Informativeness)指標を提案。

書誌情報

- Eastwood, Cian, and Christopher KI Williams. "A framework for the quantitative evaluation of disentangled representations." International Conference on Learning Representations. 2018.

- https://openreview.net/forum?id=By-7dz-AZ

ポイント

前提となる枠組み

zは本質的な情報で、cは何らかのコードとする。例えば、顔画像に対するVAEを考えると、入力画像をEncoderに通して得られるコードがcで、入力された顔画像の属性(性別や髪型、髪の色、目の色 etc...)がzである。属性の数をK、コードの次元をDとすると、z, cは以下のような次元を持つ。

\mathbb{z} \in \mathbb{R}^K, \mathbb{c} \in \mathbb{R}^D

ここで、理想的なcとはどのようなものかを考える。K=Dの場合には、cはzの並べ替えになっていることが理想的である。また、K < Dの場合には、cの一部の次元はzのいかなる次元にも対応していない「死に次元」となっていることが望ましい。このような理想的な状態を、Disentanglementな表現コードが得られていると呼ぶ。

\mathbb{z}という情報を持つ\mathbb{x}(上の例でいうと顔画像)から、コード\mathbb{c}を出力するEncoderMを考える(\mathbb{c} = M(\mathbb{x}))。

本研究の目的は、このMおよびそれによって得られる潜在変数cの表現を定量的に評価したいということであり、Disentanglement/Completement/Informativenessという3つの指標を提案している。

回帰モデルの構築

3つの指標の計算のための事前準備として、回帰モデルによるc, zの関係の強さの定量化を行う。

\mathbb{c}から各z_j (j=0, 1, ..., K-1)を予測できるK個の回帰モデルf_j(\mathbf{c})を訓練する。この回帰モデルは、何らかの形でc_iがz_jの予測に対してどれだけ重要かを定量化したR_{ij}が得られる必要がある。

そのようなモデルとして、本研究ではLasso回帰とランダムフォレストを使用している。Lasso回帰の場合は回帰係数W_{ij}を用いて、R_{i j}=\left|W_{i j}\right|とする。ランダムフォレストの場合は、特徴量の重要度を指標として出せるので、それをR_{ij}とする。

Disentanglement

\mathbb{c}から\mathbb{z}へのピンポイントな関係がどの程度あるか、を定量化したのがDisentanglementである。

c_iからz_jへの関係の「確率」を以下のように定義する。

P_{i j}=\frac{R_{i j}}{\sum_{k=0}^{K-1} R_{i k}}

この「確率」を用いて、エントロピーを以下のように定義する。これは、特定のc_iが特定のz_jのみに関係している時に最も大きい値となり、0をとる。一方で、どのz_jとも同様に関係している(あるいはどのz_jとも関係していない)場合は1となる。

H_{K}\left(P_{i .}\right)=-\sum_{k=0}^{K-1} P_{i k} \log _{K} P_{i k}

これを用いて、c_iのDisentanglementD_iを以下のように定義する。特定のz_jのみとの関係が強い場合は1となり、どのz_jとも同程度の関係の強さをもつ場合は0になる。

D_{i}=\left(1-H_{K}\left(P_{i .}\right)\right)

以上のように求められた各D_iを重み付けして、最終的なDisentanglementを求めたい。そこで、各c_iの重要性\rho_iを以下のように定義する。

\rho_i = \frac{\sum_{j} R_{i j} }{ \sum_{i j} R_{i j}}

これを用いて、最終的なDisentanglementは、\sum_{i} \rho_{i} D_{i}と定義される。

Completement

Disentanglementのc, zの役割を入れ替えたのがComplementである。こちらは、\mathbb{z}から\mathbb{c}へのピンポイントな関係の強さを定量化する。

先ほどと同様に、\tilde{P}_{i j} = \frac{R_{i j}}{\sum_{d=0}^{D-1} R_{d j}}として、z_jのCompletementを以下のように定義できる。

C_{j}=\left(1-H_{D}\left(\tilde{P}_{. j}\right)\right)

最終的なCompletementも、z_jの重要性に応じた重みづけをおこなって計算される。

最後に、cがzの情報をどの程度捉えているのかという指標Informativenessを提案している。これは、\hat{z}_{j}=f_{j}(\boldsymbol{c})がどれだけ正確か、つまり\mathbb{c}からz_jがどれだけ完璧に予測できるかをもとに計測すればよく、例えば予測誤差E\left(z_{j}, \hat{z}_{j}\right)によって表すことができる。

実験

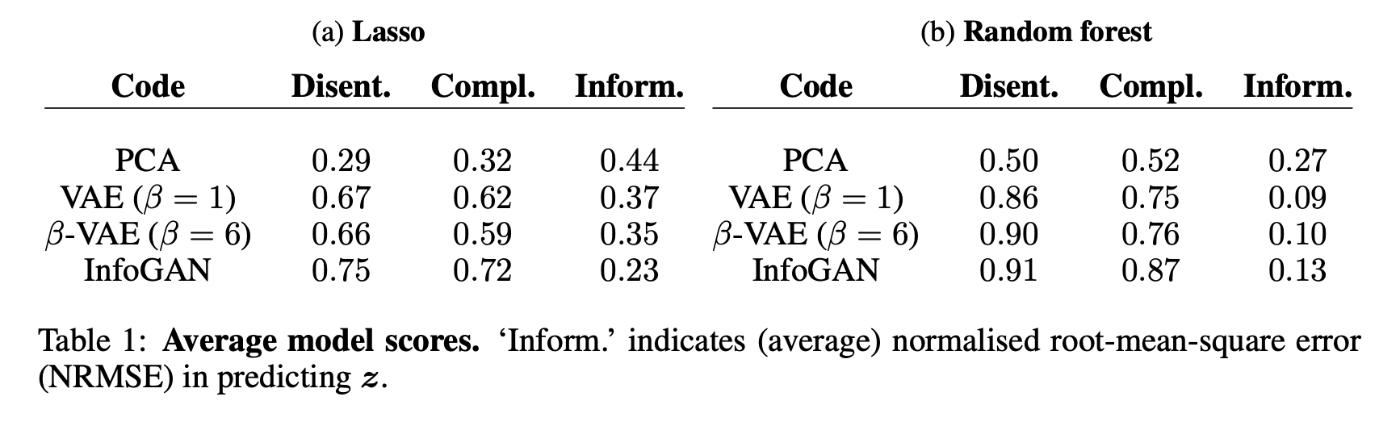

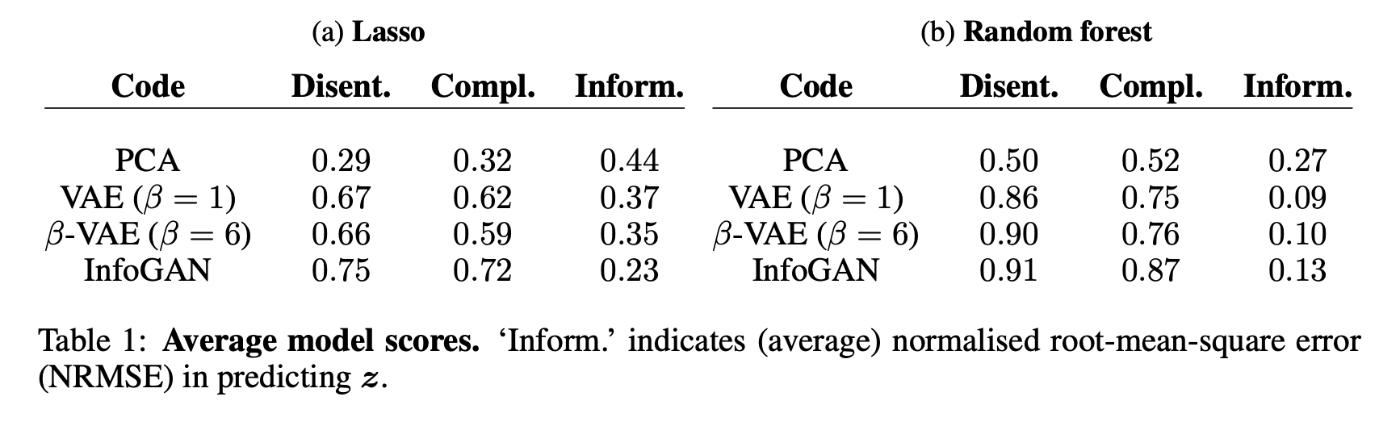

実験として、以下のような5次元の\mathbb{z}を用いて下図に示すようなさまざまな角度から捉えられたさまざまな色のティーポット画像を生成し、10次元の\mathbb{c}を持つ各種モデルを訓練し、Lassoとランダムフォレストによる回帰モデルを構築した上で、DCI指標を求めている。

- \text {azimuth}\left(z_{0}\right) \sim U[0,2 \pi]

- \text {elevation}\left(z_{1}\right) \sim U[0, \pi / 2]

- \text {red}\left(z_{2}\right) \sim U[0,1]

- \text {green}\left(z_{3}\right) \sim U[0,1]

- \text {blue}\left(z_{4}\right) \sim U[0,1]

結果は以下のようになる。

InfoGANがこれらの中ではDCで明らかに良い数値になっていることが示されている。また、VAE(\beta=1)と\beta-VAE(\beta=6)はおおむね同じようなDCIになっていることが確認できる。ランダムフォレストでのIについてはInfoGANよりも2つのVAEの方が良い結果となっているが、これは必ずしも良いことを意味しない。というのも、LassoとランダムフォレストでのIを比較した時にそのギャップが大きいのであれば、むしろcが複雑な形になってしまっていると言えるからである。

Discussion