デジタルフロンティア:AIが直面する壁と未来

AIは急速に進化し、私たちの生活やビジネスに革命をもたらしていますが、同時に多くの課題も抱えています。2025年現在、AIの技術的な複雑さと人的要素の必要性は、特に注目すべき課題となっています。

技術的な複雑さ

AIシステムの完全自動化には、まだ高度な技術が必要です。そのため現在の技術では、完全な自動化の実現には至っていません。特に問題となっているのは、異なるベンダーの機器やシステム間の互換性です。多くの企業が複数のAIツールやプラットフォームを使用しているため、これらのシステム間でのシームレスな連携が課題となっています。例えば、ある企業の顧客管理システムと在庫管理システムが異なるAIプラットフォームを使用している場合、これらのシステム間でデータを効率的に共有し、統合的な分析を行うことが困難になります。

また、AIモデルの学習に使用するデータの品質と量も重要な課題です。高品質で十分な量のデータがなければ、AIの性能は制限されてしまいます。さらに、データのプライバシーや倫理的な使用に関する懸念も増大しており、これらの問題に対処しながらAIシステムを構築することは、技術的にも法的にも複雑な課題となっています。

人的要素の必要性

AIが高度に発達した現在でも、完全自動化されたシステムにおいて最終的な判断や複雑な問題解決には、依然として人間の介入が必要です。AIは現状、サポートツールとしての役割が強く、人間の意思決定を支援する存在として位置づけられています。

例えば、医療分野では、AIが画像診断や症状分析を高速かつ正確に行うことができますが、最終的な診断や治療方針の決定は医師が行います。同様に、金融業界でも、AIがリスク分析や市場予測を行いますが、重要な投資判断は人間のアナリストや管理者が行っています。

また、AIシステムの設計、実装、維持管理には高度な専門知識を持つ人材が必要です。AIエンジニアやデータサイエンティストの需要は高まっていますが、これらの人材の育成と確保は多くの企業にとって課題となっています。

さらに、AIの判断プロセスは「ブラックボックス」と呼ばれる不透明な部分があり、その決定の根拠を人間が理解し説明することが難しい場合があります。この説明可能なAIの開発は、特に法的責任や倫理的判断が関わる分野で重要な課題となっています。

セキュリティリスク

AIを活用したネットワークやシステムは、サイバー攻撃のリスクが増大する可能性があります。この状況は、AIの普及と共に深刻化しており、2025年までの2年間でAIがサイバー攻撃の量を増加させ、その影響力を高めることは「ほぼ間違いない」と英国国家サイバーセキュリティセンター(NCSC)が結論付けています。

AIシステムのセキュリティリスクが高いのには、いくつかの理由があります:

1.データの脆弱性

AIシステムは大量のデータを学習に使用しますが、このデータが攻撃者によって操作されるリスクがあります。「データポイズニング攻撃」と呼ばれるこの手法では、攻撃者が不正なデータを学習データに直接または間接的に注入し、AIの出力結果にバイアスやエラーを引き起こします。例えば、自動運転システムのAIがこの攻撃を受けた場合、車両制御に悪影響を及ぼし、深刻な事故につながる可能性があります。

2.モデルの脆弱性

AIモデル自体も攻撃の対象となります。「回避攻撃」と呼ばれる手法では、攻撃者が学習済みモデルに送られる入力データにわずかな乱れを与えることで、モデルに誤った結果を出力させようとします。特に画像認識システムなどで問題となり、例えば自動運転車の画像認識コンポーネントを操作して歩行者を誤分類させ、安全性を脅かす可能性があります。

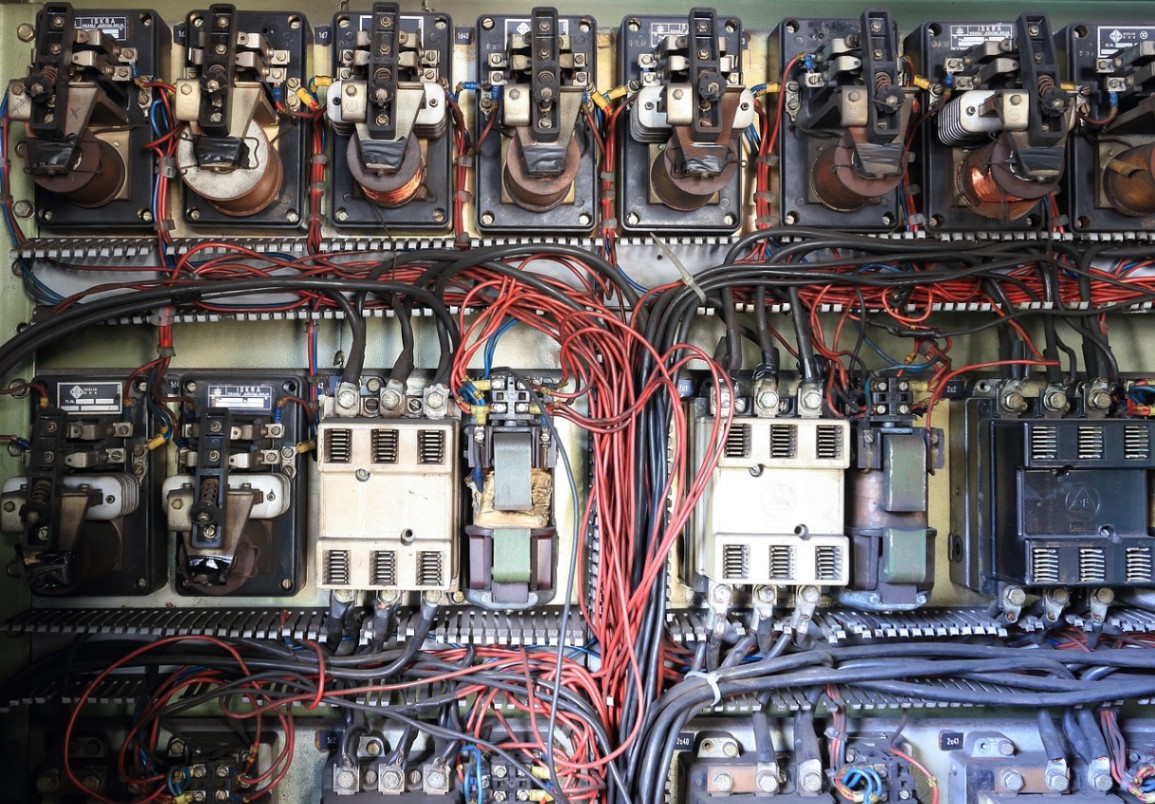

3.システム全体の脆弱性

AIシステムは複雑で多くのコンポーネントが連携して動作するため、システム全体のセキュリティを確保することが困難です。攻撃者はシステムの一部を攻撃することで全体に影響を与える可能性があります。例えば、企業内で使用されるAIシステムに社内の機密情報が誤って入力されると、その情報がAIの学習データの一部として取り込まれ、後の対話で意図せず外部に漏れるリスクがあります。

4.倫理的・プライバシーの問題

AIが誤った判断を下すことで、プライバシーの侵害や差別的な結果を生むリスクもあります。これが原因で、社会的信頼を損なう可能性があります。特に、AIチャットボットなどの外部からのアクセスが可能なシステムでは、個人情報やビジネスデータなどの機密情報が危険にさらされる可能性があります。

これらのリスクに対処するために、企業や組織は対策を講じる必要があります:

・データの暗号化やアクセス制御の強化

・定期的なセキュリティ監査の実施

・AIシステムへの入力データの厳格な管理

・AIの応答の監視と機密情報の漏洩防止

・攻撃パターンの学習によるAIの防御能力の向上など

しかし、完全な防御は難しいため、経営陣自らがセキュリティ方針・戦略の策定に積極的に関与し、ビジネス目標とセキュリティ目標を合致させた柔軟なサイバーリスク対応体制の構築が求められます。AIの普及によって高まるサイバーリスクは避けられない経営リスクの一つとなっており、継続的な対策と監視が必要です。

今後の展望

これらの課題に対処するため、産業界と学術界では様々な取り組みが行われています。例えば、AIシステム間の相互運用性を高めるための標準化の努力や、説明可能なAIの研究開発が進められています。また、AIと人間のより効果的な協働を目指す「人間中心のAI」の概念も注目を集めています。

AIの技術は日々進化していますが、完全な自動化や人間の完全な代替にはまだ時間がかかるでしょう。当面は、AIと人間がそれぞれの強みを活かしながら協力して問題解決にあたる「人間とAIの共生」が重要になると考えられます。企業や組織は、AIの可能性を最大限に活用しつつ、その限界も理解した上で、適切な活用戦略を立てていく必要があります。

Discussion