🧙

ラベル付不要!自己教師あり学習! (暫定)

前書き

- DeepSeekからの流れでLLMが、安く学習できるようになり、学習手法がいろいろ気になりだした。

- 丁度、画像AIの本で、自己教師あり学習読んだので、この前の祝日に、その5論文checkして、LTしたので、記事にもします。

- GPTが数年前に成功した一番大きな要因は、ラベル付が不要だったから(次単語予測)だと思う。なので、自己教師あり学習大事。自己回帰より拡散モデルがいいとの見方もあるし。

- 自己教師あり学習で有名なMoco,SimCLRについて話します。,BYOL,MAE,IBot追記したい。つぎの記事でDINO予定

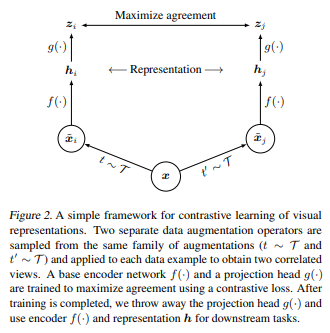

- 対比学習は、同じ画像は似た特徴量に、違う画像は特徴量を離す。データ拡張して、本質的なもの以外は変更する。

話すこと

読者対象

1. どんなもの?

-

MoCo 対比学習。移動平均でエンコーダーをもう一つ用意。memoryバンクで、計算量削減

-

SimCLR シンプルにした。Encorderはひとつ、特徴量表現に変換加えたところで、類似度みることにより、よりリッチに。データ拡張の構成が大事だとも

-

データ拡張の構成が大事だとも。cropだけだと色でわかる。なのでcrop>色の変更がいい。

2. 先行研究と比べてどこがすごいの?

3. 技術や手法の"キモ"はどこにある?

あとがき

記事よかったら、いいね♡ 押してね!

Discussion