Microsoft Ignite 2025: セッションレポート(その1)

三菱UFJインフォメーションテクノロジー株式会社 AIソリューション部のJustin Wangです。

先週、米国サンフランシスコで開催された Microsoft Ignite に参加してまいりました。

今年の Ignite では、Microsoft Foundry(旧称 Azure AI Foundry)に関連する多くの機能が Public Preview として発表されました。私は Microsoft Foundry を中心とした複数のセッションに参加しておりました。

各セッションの内容を簡潔にご説明するだけでは十分にお伝えしきれない部分もあるかと思いますので、弊社内の生成AIシステムに関連するセッションをいくつかピックアップし、今後少しずつご紹介していきたいと考えております。

今回は、その第一弾として「Microsoft Foundry Control Plane」の発表内容についてご紹介いたします。

「Microsoft Foundry Control Plane」を中心に、AIエージェントの信頼性を確保するための技術的アプローチ

今回参加したセッションのタイトルは「AI Operations to own the fleet, master the mission in Microsoft Foundry」です。(公開セッションの詳細は以下のURLにご確認ください。)

参加の背景としては、AIエージェントの導入が加速する中で、セキュリティとガバナンスの重要性がこれまで以上に高まっていると感じたためです。特に、現在 Foundry を中心としてエージェント開発を進めるにあたり、いかにセキュリティを強化し、PI(Prompt Injection)などの攻撃手法を防止できるか、そのソリューションを把握したいと考えました。

Control Plane の発表内容のご説明に入る前に、まず「Control Plane」がなぜ必要とされるのか、その背景となる課題を以下から整理していきたいと思います。

AIエージェント導入における課題

発表の内容では、Microsoft の「2025 Work Trend Index Annual Report」によると、グローバルのビジネスリーダーを対象とした調査で、回答者の約 8 割が「今後 12〜18 ヶ月以内に、AI エージェントを活用したソリューションを自社戦略の一部として本格的に導入する意向がある」と回答しています。

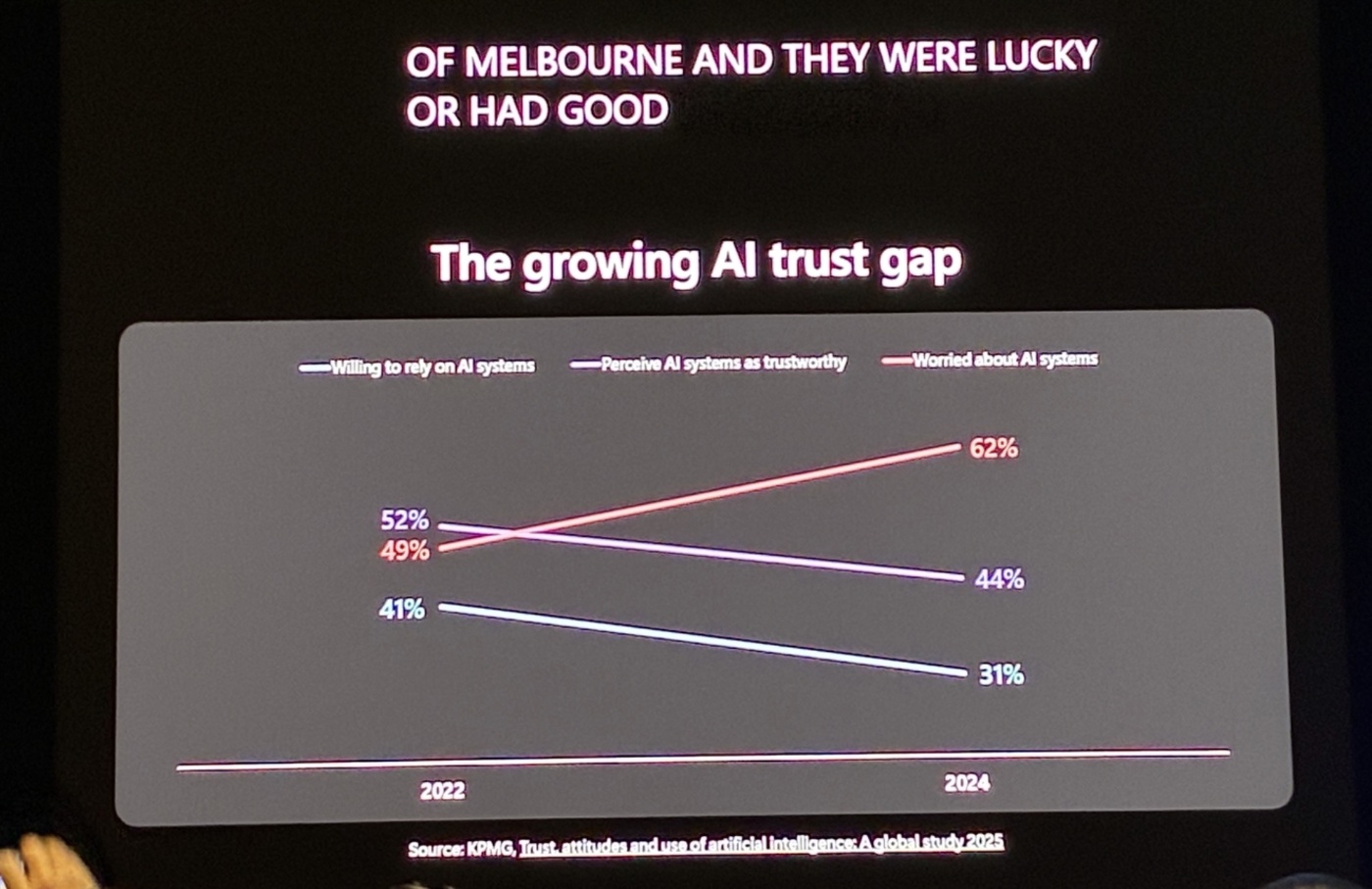

一方で、KPMG とメルボルン大学によるグローバル調査「Trust, attitudes and use of artificial intelligence: A global study 2025」では、AI システムに対する信頼はむしろ低下していることが示されています。2022 年から 2024 年のあいだに「AI システムを信頼できる」と感じる人の割合は 49% から 44% に減少する一方、「AI システムに不安を感じる」と答えた人の割合は 52% から 62% に増加しており、AI 活用の加速と AI への不信感のギャップが拡大している状況が浮き彫りになっています。

主要なリスク要因

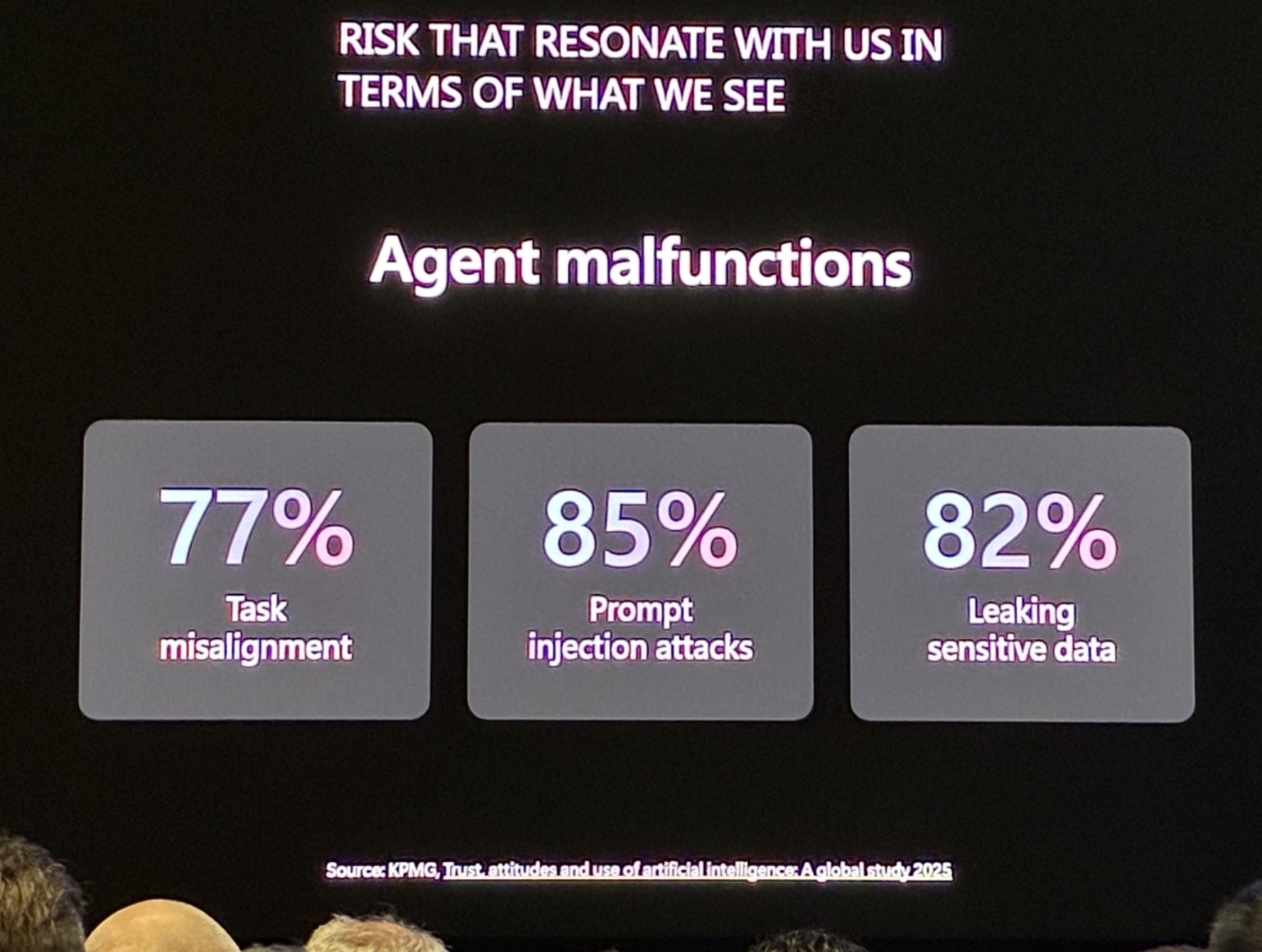

セッションの発表により、上述の研究では企業が最も懸念するAIエージェントのリスクは以下の通りです:

- タスクミスアライメント: 77%の企業が、エージェントが意図したタスクから逸脱することを懸念

- プロンプトインジェクション攻撃: 85%の企業が、悪意のある指示による乗っ取りを懸念

- 機密データの漏洩: 82%の企業が、個人情報や機密情報の流出を懸念

これらのリスクに対処するため、Microsoftは包括的なセキュリティアプローチを開発しました。

Microsoft Foundry Control Planeの4つの柱

1. コントロール(ガードレール)

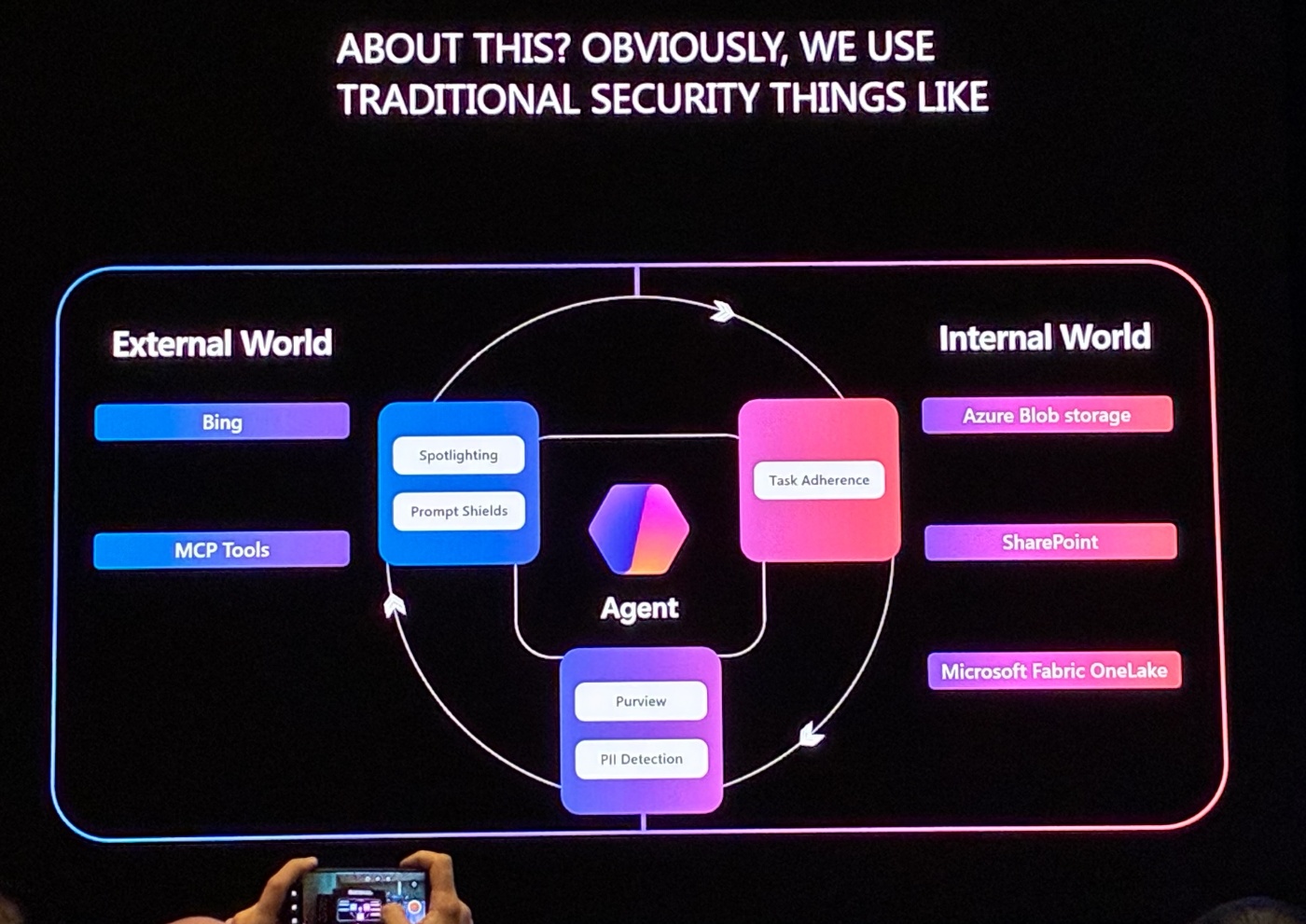

AIエージェントは外部(インターネットやツール)と内部(企業データやシステム)の両方にアクセスできるため、新たなリスクが生まれます。Foundry Control Plane は入力・出力・ツール操作のすべてに一貫したガードレールを適用します。

主要なコントロール機能

- センシティブデータ漏洩対策:ツールやツールレスポンスのPIIスキャンを実施し、個人情報の流出を防ぎます。

- タスクドリフト検出:エージェントがタスクに従っているかを監視し、意図しない動作を防止します。

- エージェントハイジャッキング対策:プロンプトやツールレスポンスのスポットライティングを行い、間接的なプロンプトインジェクション攻撃を検出します。

- コンテンツハーム対策: 性的コンテンツ、自傷行為、暴力、ヘイトスピーチなどの有害コンテンツをフィルタリングし、保護された素材の出力も防止します。

2. オブザーバビリティ(可観測性)

エージェントの動作を継続的に監視し、問題を早期に発見することが重要です。Foundry Observability は、デプロイ前後で包括的な評価を提供します。

特徴:継続的評価とアラート

- オフライン評価に加えて、本番環境での実際のユーザープロンプトをサンプリングして継続的に評価する機能が提供されています。

- 評価指標が継続的に低下した場合、自動的にアラートが発行され、開発者が迅速に対応できます。

- コストや成功率などのメトリクスも統合ダッシュボードで監視可能です。

また、人間の関わり方も「インナーループ」(出力の都度確認)から、「アウターループ」(動作方針・検証セット・モニタリングの承認)へ進化します。これにより、人間の監視を維持しつつもエージェントの自律性を活かせます。

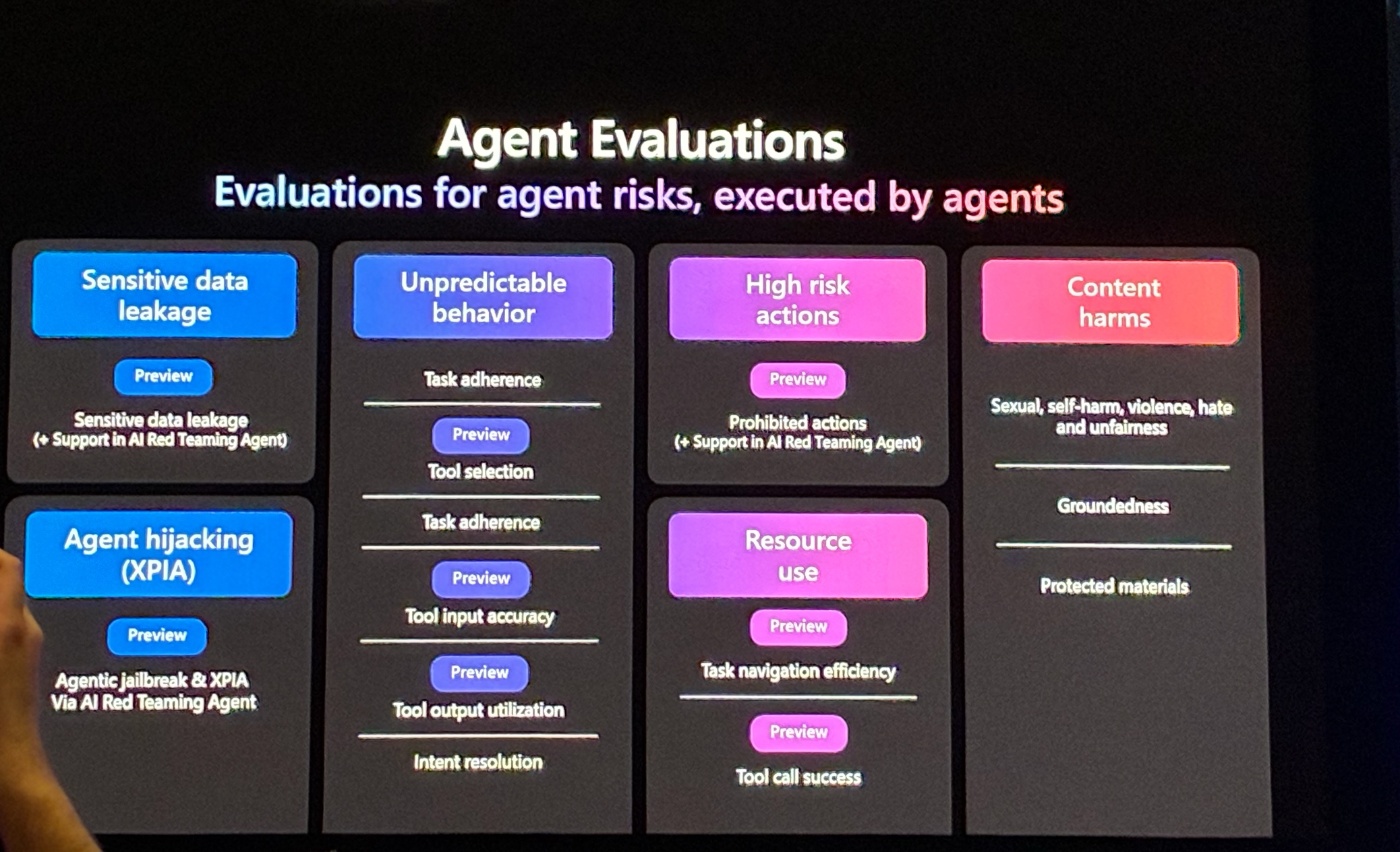

さらに、エージェントリスクを評価するための機能も強化されており、以下の画像に示すように Public Preview として提供が開始されています。

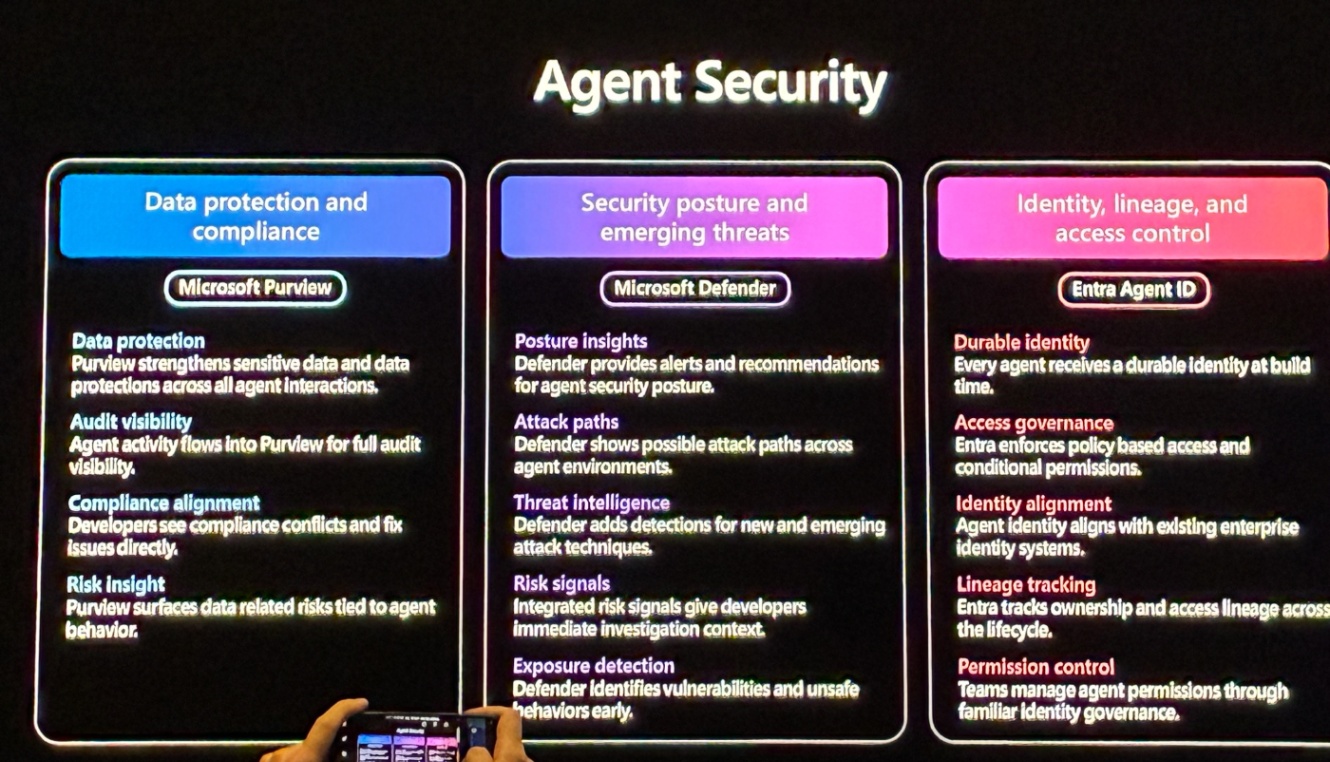

3. セキュリティ統合

信頼性AI構築は「チームスポーツ」であり、開発者だけでなく、IT部門やセキュリティチームとの協力が不可欠です。

- 特徴1:Microsoft Securityとの統合

Entra Agent IDにより、エージェントに検証済みのアイデンティティと所有者を付与し、ユーザーやデバイスと同様に管理します。

Microsoft Defenderは、ジェイルブレイクやプロンプトインジェクション攻撃をリアルタイムで検出し、セキュリティオペレーションチームに通知します。現地セッションではデモを行い、ジェイルブレイク試行が即座にDefenderに報告され、攻撃者の特定プロセスが開始される様子が示されました。 - 特徴2:Microsoft Purview(近日公開予定)との統合予定

組織のデータセキュリティポリシーをFoundryに統合し、開発者がエージェントとやり取りする際にポリシーを可視化します。Purviewチームは、すべてのFoundryアクティビティを監視し、データ保護とコンプライアンスを確保できます。 - 特徴3:サードパーティとの連携

今回紹介されていたのは、「Zenity」と「Paloalto」の二つパートナー製品の連携でした。詳細は近日公開予定です。

4. フリートワイド運用(大規模運用)

企業が数百から数千のエージェントを管理する時代において、個々のエージェントのチューニングだけでは不十分です。Foundry Control Planeは、すべてのエージェントを一元的に可視化し、優先順位付けを支援します。

Foundry Control Planeは、AWS AgentCoreと同様にLangChain/LangGraph、Microsoft Agent Framework、Foundry SDKなど主流フレームワークで開発されたすべてのエージェントをFoundry上に監視できます。開発者は、トップレベルのビューでコストや成功率を確認し、セキュリティアラート、継続的評価アラート、ポリシーアラートなど、複数のソースからのアラートを統合的に管理できます。

コンプライアンスポリシーにおいても、個々の開発者に依存するのではなく、組織レベルで「すべてのエージェントにプロンプトインジェクション対策を適用する」などのポリシーを設定できます。ポリシーに準拠していないエージェントは自動的にフラグが立てられ、開発者に通知されます。

最後に

今回の Ignite では、Microsoft Foundry(旧 Azure AI Foundry)関連サービスが、従来やや中途半端だったエコシステムから大きく進化したと強く感じました。

たとえば Foundry Agent Service では、GitHub、Visual Studio、VS Code、Copilot Studio とのネイティブ統合により、開発体験が大幅に向上しています。さらに、モデル、Agent Service、IQ、ツール、Machine Learning など 1,400 以上の事前構築済みコネクション や MCP ツールを活用することで、コンテンツ認識型・アクション指向型のエージェントを柔軟に構築できます。Adobe、Atlassian、SAP、ServiceNow、Microsoft Fabric、OneLake といった主要サービスとの統合も提供されています。

とはいえ、他クラウドと比較して「圧倒的」と言い切れるかどうかは、各企業の環境や戦略に左右される部分です。実際には、自社の要件に照らして十分な検討・検証を行う必要があるでしょう。

また、「OWASP Top 10 for LLM Applications」で指摘されているリスク項目と照らし合わせて考えると、今回発表されたセキュリティ防衛機能や監視機能だけで企業内の生成AIシステムに対して十分なのかは、実証実験を通じて確認することが重要です。

今後、Control Plane が示す各機能がどこまで実環境で有効に機能するのか、しっかりと検証を進めていきましょう。

Discussion