Azure OpenAI Service の GPT-4o mini 要点まとめ

はじめに

日本時間 2024 年 8 月 1 日に Azure OpenAI Service において API 経由で GPT-4o mini が利用可能になりました。そこで、関連情報へのリンクと合わせて要点をまとめました。

GPT-4o mini

GPT-4o mini の立ち位置

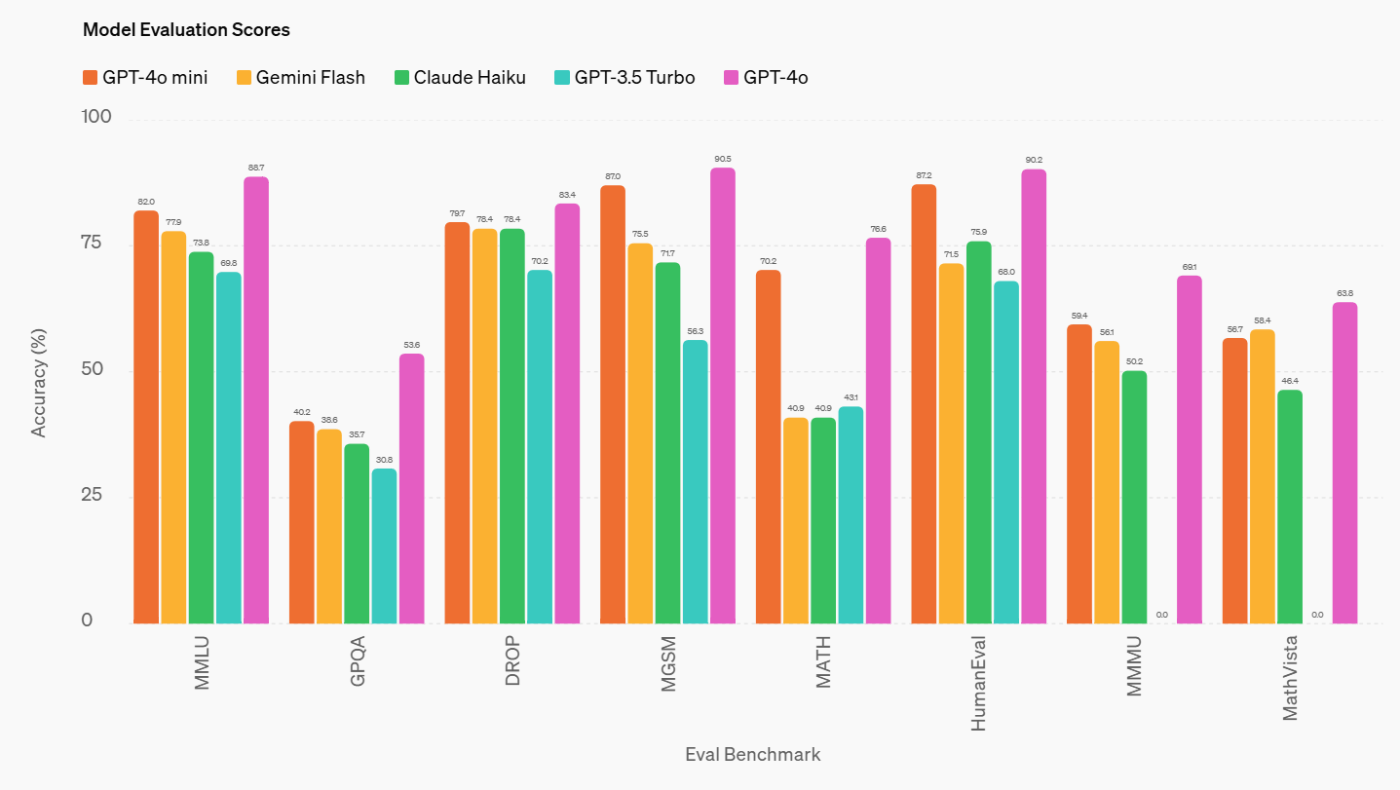

GPT-4o mini は GPT-4o の軽量版でコストパフォーマンスとレイテンシー (生成の速さ) が長所のモデルです。

GPT-4o mini enables a broad range of tasks with its low cost and latency

また、gpt-3.5-turbo よりも低コスト (後述) かつベンチマーク上の性能で上回っており、今後 gpt-3.5-turbo を置き換える立ち位置のモデルであると思われます。

参考

マルチモーダリティ

GPT-4o および GPT-4o mini はテキストと画像に加えて動画や音声を直接入力することができるマルチモーダルモデルとされていますが、執筆時点で API 経由で利用できるモーダリティは以下に限定されています。

- 入力: テキスト + 画像

- 出力: テキスト

Today, GPT-4o mini supports text and vision in the API, with support for text, image, video and audio inputs and outputs coming in the future.

参考

最大トークン

GPT-4o mini の最大トークン以下のとおりです。最大出力トークンは GPT-4o よりも拡張されています。

| モデル | 最大トークン (入力) | 最大トークン (出力) |

|---|---|---|

gpt-4o-mini (2024-07-18) |

128,000 | 16,384 |

gpt-4o (2024-05-13) |

128,000 | 4,096 |

[補足] 日本語のトークン効率

GPT-4o 以降のモデルは o200k_base という新しいエンコーディングが使われていて、英語以外のローカル言語のトークン効率が向上しています。日本語において GPT-4 Turbo 以前の cl100k_base が使われているモデルと比較すると、OpenAI による GPT-4o のリリース記事の例では約 30%、個人的な検証の結果では約 27% トークン効率が向上していました。

参考

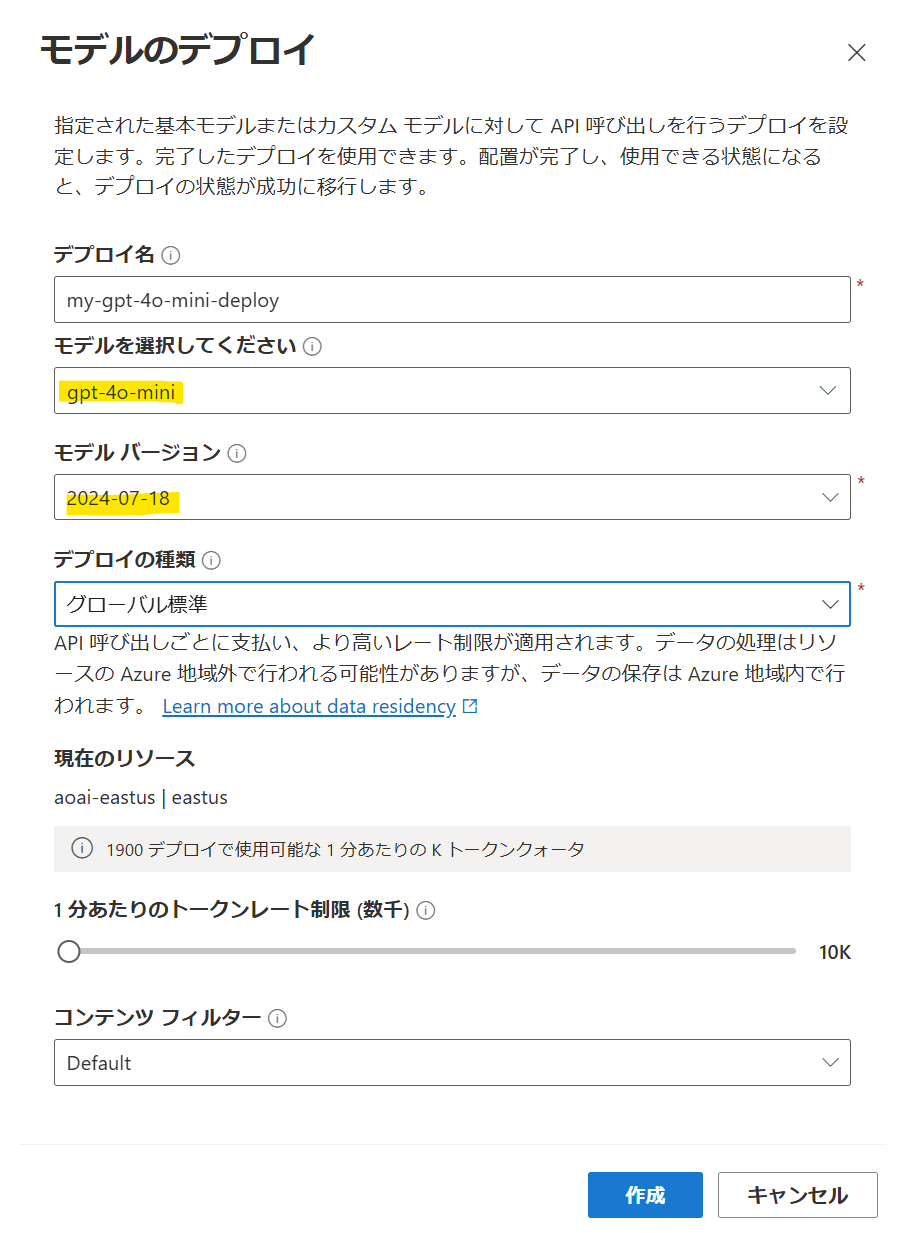

リージョン

執筆時点 (API 公開時点) で GPT-4o mini は Global standard デプロイと Standard デプロイの両方で East US リージョンのみ対応しています。おそらくそれぞれの対応リージョンは今後増えていくと思われます。

Today, we are excited to bring this powerful model to even more developers by releasing the GPT-4o mini API with vision support for Global and East US Regional Standard Deployments.

参考

- OpenAI’s GPT-4o mini Now Available in API with Vision Capabilities on Azure AI

- Standard deployment model availability

- Global standard model availability

[補足] Global standard デプロイと Standard デプロイ

Azure OpenAI Service を従量課金 (PAYG: Pay-As-You-Go) で利用する場合 Global standard デプロイと Standard デプロイの二つの選択肢が存在します。これらのデプロイは利用するシナリオに応じて選択をします。詳細な説明は公式ドキュメントに記載されています。

Global standard

GPT-4o と同時に新たに追加されたデプロイ方法です。Global standard 対応リージョンのいずれかのリージョンの Azure OpenAI Service リソースでデプロイを作成しますが、ユーザーからのリクエスト時の状況に応じて動的にルーティングが行われて Global standard 対応リージョンのうちいずれかのリージョンで処理が行われます。

Standard

Azure OpenAI Service 公開当初から存在していたデプロイ方法です。特定のリージョンに Azure OpenAI Service リソースを作成しデプロイを行います。モデルによる処理も同一のリージョンで行われます。

参考

価格

執筆時点の価格は以下のとおりです。モデルの低価格化が進み 1K (千) トークンあたりの価格は視認しづらくなったため、1M (百万) トークンあたりに直した価格も記載します。

1K トークンあたり

| モデル | デプロイ | 入力 | 出力 |

|---|---|---|---|

gpt-4o-mini (2024-07-18) |

Global standard | $0.00015 | $0.0006 |

| Standard | $0.000165 | $0.00066 | |

gpt-4o (2024-05-13) |

Global standard | $0.005 | $0.015 |

| Standard | $0.005 | $0.015 | |

gpt-35-turbo (0125) |

Standard | $0.0005 | $0.0015 |

1M トークンあたり

| モデル | デプロイ | 入力 | 出力 |

|---|---|---|---|

gpt-4o-mini (2024-07-18) |

Global standard | $0.15 | $0.6 |

| Standard | $0.165 | $0.66 | |

gpt-4o (2024-05-13) |

Global standard | $5 | $15 |

| Standard | $5 | $15 | |

gpt-35-turbo (0125) |

Standard | $0.5 | $1.5 |

参考

- OpenAI’s GPT-4o mini Now Available in API with Vision Capabilities on Azure AI

- Azure OpenAI Service pricing

クォータ

執筆時点で設定されているクォータは以下のとおりです。購入形態により割り当てられるクォータが異なります。

Global standard

| モデル | 購入形態 | Tokens per minute (TPM) | Requests per minute (RPM) |

|---|---|---|---|

gpt-4o-mini (2024-07-18) |

Enterprise Agreement (EA) | 50M | 300K |

| 標準 | 2M | 12K |

Standard

| モデル | 購入形態 | Tokens per minute (TPM) | Requests per minute (RPM) |

|---|---|---|---|

gpt-4o-mini (2024-07-18) |

Enterprise Agreement (EA) | 2M | 12K |

| 標準 | 0.45M | 2.7K |

参考

周辺機能

Fine-tuning

執筆時点で未対応です。

gpt-4o-mini (2024-07-18) の fine-tuning がプレビュー開始しました。

参考

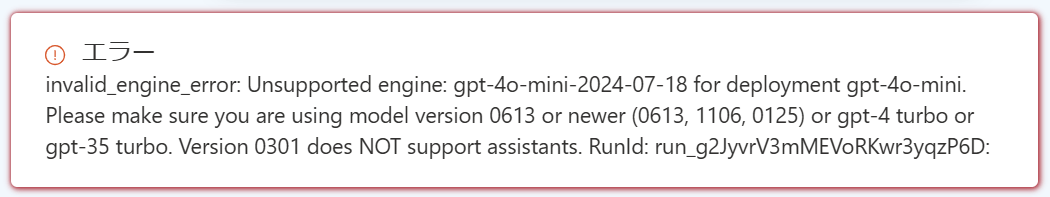

Assistants API

執筆時点で未対応です。

参考

Batch API

2024 年 8 月からプレビューが開始しました。

参考

- Getting started with Azure OpenAI global batch deployments (preview)

- Azure OpenAI Service の Batch API 要点まとめ

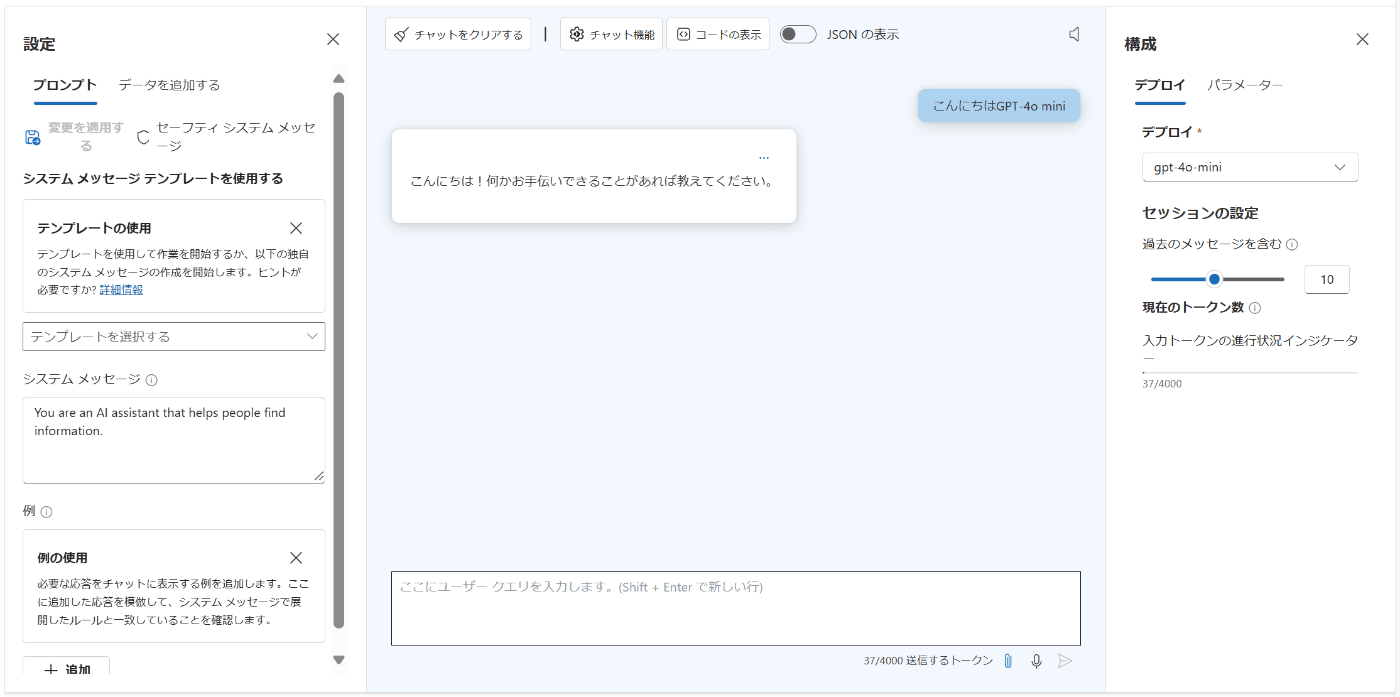

使い方

特筆すべき点は無く、他のモデルと同様に対応リージョンにおいてデプロイと利用が可能です。

参考

おわりに

GPT-4o mini が利用可能になったことで、Azure OpenAI Service のモデルの顔ぶれがフラッグシップモデルの GPT-4oとコストパフォーマンスの良い GPT-4o mini とわかりやすくなった印象です。対応リージョンや周辺機能に関しては今後拡充されていくことに期待です。

以上です。🍵

Discussion