👄

GCP様のspeech-to-textで音声をテキスト化してみる

GCP様の「speech-to-text」というAPIに淡い恋心が芽生え、

勇気を出して声をかけてみました。

環境準備

今回はpythonを使用しました。

さくっと音声入力に「pyaudio」を使用したかったので、3.6の仮想環境にインストールしました。

anaconda上で用意しました。

conda create -n miso-speach python=3.6

conda activate miso-speach

moduleインストール

- pyaudio

conda install -c anaconda pyaudio

- ヒロインである[google-cloud-speech]は公式ドキュメント通りpipで投入しました。

pip install --upgrade google-cloud-speech

GCPでのAPI利用準備

speech-to-text の有効化

1. 「APIとサービス > ライブラリ」 をクリック

2. 検索BOXに「speach」を入力 >> 登場するヒロインをクリック

3. 「有効にする」をクリック

認証情報作成

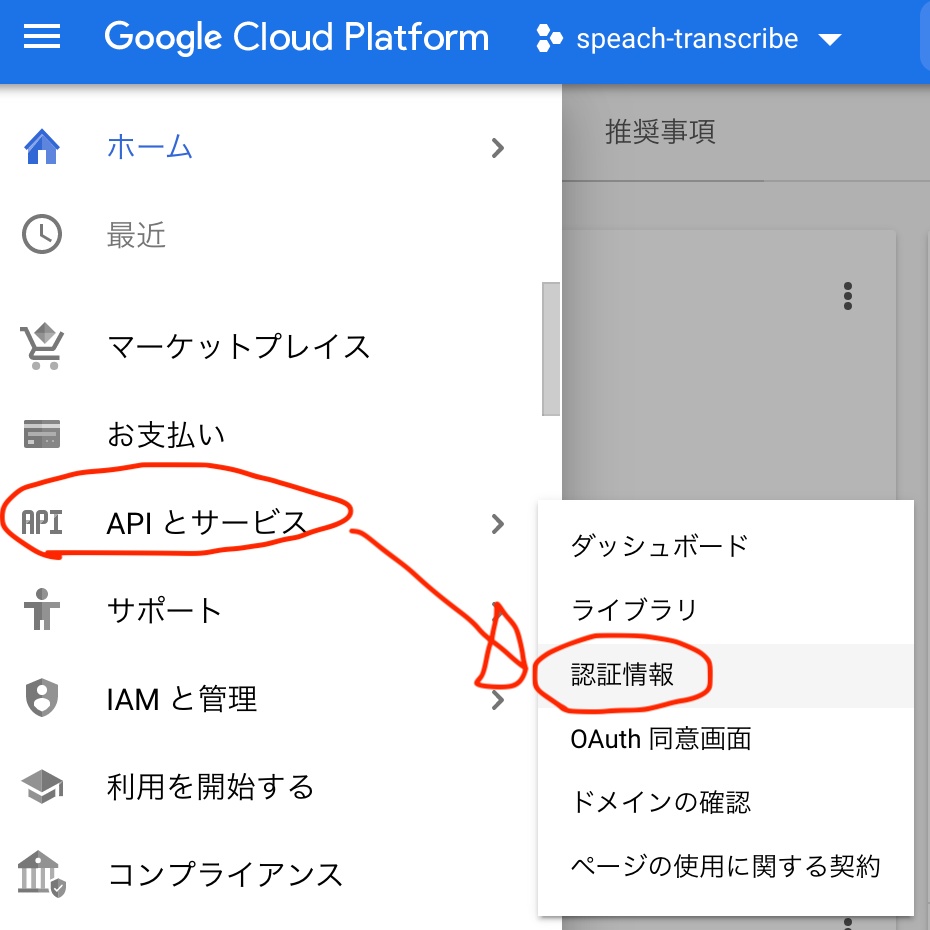

1. 「APIとサービス > 認証情報」 をクリック

2. 「認証情報を作成 > サービスアカウント」 をクリック

~ GCP様の問いに沿って入力し作成を遂行します ~

3. サービスアカウント一覧 > 「キー」タブ > 「鍵を作成」をクリック

4. json形式にチェック >> 「作成」をクリック

鍵はローカルPCにダウンロードされます。

試してみる

ダウンロードしたjson形式の鍵を「GOOGLE_APPLICATION_CREDENTIALS」に設定してあげる必要がありますので、以下のようにコードに書くか環境変数にお供えします。

import os

os.environ['GOOGLE_APPLICATION_CREDENTIALS'] = 'hogehoge.json'

リアルタイムストリーミング

公式のサンプルを流用してついに、声をかけます。

from __future__ import division

import os

import re

import sys

from google.cloud import speech

import pyaudio

from six.moves import queue

os.environ['GOOGLE_APPLICATION_CREDENTIALS'] = 'hogehoge.json'

# Audio recording parameters

RATE = 16000

CHUNK = int(RATE / 10) # 100ms

class MicrophoneStream(object):

"""Opens a recording stream as a generator yielding the audio chunks."""

def __init__(self, rate, chunk):

self._rate = rate

self._chunk = chunk

# Create a thread-safe buffer of audio data

self._buff = queue.Queue()

self.closed = True

def __enter__(self):

self._audio_interface = pyaudio.PyAudio()

self._audio_stream = self._audio_interface.open(

format=pyaudio.paInt16,

# The API currently only supports 1-channel (mono) audio

# https://goo.gl/z757pE

channels=1,

rate=self._rate,

input=True,

frames_per_buffer=self._chunk,

# Run the audio stream asynchronously to fill the buffer object.

# This is necessary so that the input device's buffer doesn't

# overflow while the calling thread makes network requests, etc.

stream_callback=self._fill_buffer,

)

self.closed = False

return self

def __exit__(self, type, value, traceback):

self._audio_stream.stop_stream()

self._audio_stream.close()

self.closed = True

# Signal the generator to terminate so that the client's

# streaming_recognize method will not block the process termination.

self._buff.put(None)

self._audio_interface.terminate()

def _fill_buffer(self, in_data, frame_count, time_info, status_flags):

"""Continuously collect data from the audio stream, into the buffer."""

self._buff.put(in_data)

return None, pyaudio.paContinue

def generator(self):

while not self.closed:

# Use a blocking get() to ensure there's at least one chunk of

# data, and stop iteration if the chunk is None, indicating the

# end of the audio stream.

chunk = self._buff.get()

if chunk is None:

return

data = [chunk]

# Now consume whatever other data's still buffered.

while True:

try:

chunk = self._buff.get(block=False)

if chunk is None:

return

data.append(chunk)

except queue.Empty:

break

yield b"".join(data)

def listen_print_loop(responses):

"""Iterates through server responses and prints them.

The responses passed is a generator that will block until a response

is provided by the server.

Each response may contain multiple results, and each result may contain

multiple alternatives; for details, see https://goo.gl/tjCPAU. Here we

print only the transcription for the top alternative of the top result.

In this case, responses are provided for interim results as well. If the

response is an interim one, print a line feed at the end of it, to allow

the next result to overwrite it, until the response is a final one. For the

final one, print a newline to preserve the finalized transcription.

"""

num_chars_printed = 0

for response in responses:

if not response.results:

continue

# The `results` list is consecutive. For streaming, we only care about

# the first result being considered, since once it's `is_final`, it

# moves on to considering the next utterance.

result = response.results[0]

if not result.alternatives:

continue

# Display the transcription of the top alternative.

transcript = result.alternatives[0].transcript

# Display interim results, but with a carriage return at the end of the

# line, so subsequent lines will overwrite them.

#

# If the previous result was longer than this one, we need to print

# some extra spaces to overwrite the previous result

overwrite_chars = " " * (num_chars_printed - len(transcript))

if not result.is_final:

sys.stdout.write(transcript + overwrite_chars + "\r")

sys.stdout.flush()

num_chars_printed = len(transcript)

else:

print(transcript + overwrite_chars)

# Exit recognition if any of the transcribed phrases could be

# one of our keywords.

if re.search(r"\b(exit|quit)\b", transcript, re.I):

print("Exiting..")

break

num_chars_printed = 0

def main():

# See http://g.co/cloud/speech/docs/languages

# for a list of supported languages.

language_code = "ja-JP" # a BCP-47 language tag

client = speech.SpeechClient()

config = speech.RecognitionConfig(

encoding=speech.RecognitionConfig.AudioEncoding.LINEAR16,

sample_rate_hertz=RATE,

language_code=language_code,

)

streaming_config = speech.StreamingRecognitionConfig(

config=config, interim_results=True

)

with MicrophoneStream(RATE, CHUNK) as stream:

audio_generator = stream.generator()

requests = (

speech.StreamingRecognizeRequest(audio_content=content)

for content in audio_generator

)

responses = client.streaming_recognize(streaming_config, requests)

# Now, put the transcription responses to use.

listen_print_loop(responses)

if __name__ == "__main__":

main()

MACを使っていたのですが、どうもエディターからマイクへのアクセス許可が無いようで・・・

音声認識されなかったので、ターミナルからsudoでスクリプトを実行しました。

一人でアホなこと言ってたので、頬が赤く染まりました。

$ sudo python ./unko.py

Password:

PCに語りかけると・・・

ゴリラたくさんいますね

可愛いね

いやかっこいいね

おっきいね

すんごく

本当に

おにぎりおいしかった

おにぎり

ちゃんとリアルタイムに私の呟き、ゴリラなうをテキスト化してくれました。

音声データ

今度は適当に用意したwavファイルから音声を読み取りテキスト化してみます。

import os

import io

from google.cloud import speech

os.environ['GOOGLE_APPLICATION_CREDENTIALS'] = 'hogehoge.json'

# Instantiates a client

client = speech.SpeechClient()

### 音声データを指定

speech_file = './datas/gorira-speach.wav'

### rb(read binary)でデータを読み込む

with io.open(speech_file, 'rb') as f:

content = f.read()

### RecognitionAudioにデータを渡す

audio = speech.RecognitionAudio(content=content)

config = speech.RecognitionConfig(

### encodeでエラーが出たのでENCODING_UNSPECIFIEDに変更

encoding=speech.RecognitionConfig.AudioEncoding.ENCODING_UNSPECIFIED,

sample_rate_hertz=16000,

language_code="ja-JP",

)

### 音声を抽出

response = client.recognize(config=config, audio=audio)

### 抽出結果をprintで表示

for result in response.results:

print("Transcript: {}".format(result.alternatives[0].transcript))

実行してみます

$ python ./gorira-speach.py

Transcript: 大変混雑することが予想されますので公共交通機関をご利用くださいますようご協力をお願いいたします

ちゃんとテキスト化してくれました。

Discussion