LLMで人工社会を創る:Generative Agentsが実現した創発的社会行動

はじめに

ルミナイR&Dチームの権藤です。

本記事では、大規模言語モデル(LLM)を利用した社会シミュレーションの礎となった研究「Generative Agents(Park et al., 2023)」を紹介します。

本ページの図は特筆がない限り全て本論文から引用しています。

論文リンク: Generative Agents: Interactive Simulacra of Human Behavior

概要

人間の行動をもっともらしく反映するインタラクティブな人工の社会を構築するにはどうしたらいいだろうか?

この問いに答えるために、人間の行動をシミュレーションで再現し人工の社会をつくる研究が長きにわたり行われてきました。

本論文では、**生成エージェント(Generative Agents)**を導入することで、信頼性の高い人工社会のシミュレーションを実現しています。

生成エージェントとは

生成エージェントは、LLMを利用して人間らしい行動を生成する計算エージェントです。エージェントは以下のような行動を取ります:

- 朝起きて朝食を作る

- 仕事や趣味に取り組む

- 他のエージェントと会話し、関係を築く

- 過去の経験を振り返り、未来の計画を立てる

本研究では、25体のエージェントを「Smallville」というシミュレーション環境(『The Sims』のようなゲーム世界)に配置し、2日間のゲーム時間にわたって相互作用させました。

手法

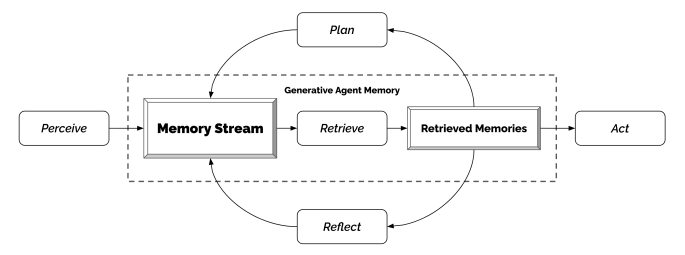

生成エージェントを実現するために、本論文では記憶ストリーム(Memory Stream)、リフレクション(Reflection)、**プランニング(Planning)**という3つの主要コンポーネントからなるアーキテクチャを提案しています。

1. 記憶ストリーム(Memory Stream)

エージェントの全ての経験を自然言語で記録する長期記憶モジュールです。

エージェントが行動を決定する際に、記憶ストリームから関連する記憶を検索する必要があります。記憶は以下の3つの基準で検索されます:

- 新しさ(Recency): 最近アクセスされた記憶ほど高いスコア

- 重要度(Importance): LLMに記憶の重要度を1〜10でスコアリングさせる

- 関連性(Relevance): クエリとの意味的類似度(埋め込みベクトルのコサイン類似度)

これらを組み合わせた検索関数により、現在の状況に最も関連性の高い記憶を取り出します。

2. リフレクション(Reflection)

エージェントは定期的に過去の経験を振り返り、高次の推論を生成します。

リフレクションの必要性

生の観察記憶のみでは、エージェントは一般化や推論を行うことが困難です。例えば、Klausが「知り合いの中で1時間一緒に過ごすとしたら誰を選びますか?」と尋ねられた場合、観察記憶のみだと最も頻繁に交流しているWolfgang(大学寮の隣人)を選びますが、実際にはすれ違うだけで深い交流はありません。

より適切な応答には、以下のような高次の推論が必要になります:

- Klausが研究プロジェクトに何時間も費やしている → 「Klausは研究に情熱を持っている」

- Mariaも自分の研究に努力を注いでいる → 「共通の興味を持っている」

このようなリフレクションにより、Klausは実際にはMariaを選ぶようになります。

リフレクションの生成プロセス

リフレクションは、重要度スコアの合計が一定の閾値を超えるたびに生成されます(実際には1日に2〜3回程度)。

ステップ1: 何についてリフレクションするかを決定

最新の100件の記憶を使って、LLMに「最も顕著な3つの高次の質問」を生成させます。

例:

- Klaus Muellerは何に情熱を持っていますか?

- Klaus MuellerとMaria Lopezの関係は?

ステップ2: 洞察の抽出

生成された質問をクエリとして関連記憶を検索し、LLMに洞察を抽出させます。

プロンプト例:

Klaus Muellerについての記述

1. Klaus Muellerは研究論文を書いている

2. Klaus Muellerはジェントリフィケーションに関する本を読むのを楽しんでいる

3. Klaus MuellerはAyesha Khanと運動について会話している

[...]

上記の記述から推論できる5つの高次の洞察は何ですか?

(例の形式:洞察(1、5、3に基づく))

出力例:

- 「Klaus Muellerはジェントリフィケーションの研究に専念している(1、2、8、15に基づく)」

リフレクションは記憶ストリームに保存され、将来の行動決定に利用されます。

3. プランニング(Planning)

エージェントは長期的な一貫性を保つために計画を立てる必要があります。計画はトップダウンで生成され、再帰的に詳細化されます。

初期計画を作るために、エージェントの要約説明(名前、特性、最近の経験の要約など)と前日の要約をプロンプトに含めます。

計画の流れは以下の通りです:

- 1日の大まかな計画を生成(5〜8個のチャンク)

- それを1時間単位に分解

- さらに5〜15分単位に分解

例:

- 1日の大まかな計画

- 8:00に起床して朝のルーティンをこなし、

- 10:00から授業を受けるために大学に行き、

- [...]

- 13:00~17:00まで新しい音楽の作曲に取り組み、

- 17:30に夕食を取り、

- 学校の課題を追えて23:00までに就寝する

- 1時間単位の行動に分解

- 13:00〜17:00: 音楽の作曲に取り組む

- 13:00: アイデアのブレインストーミング

- [...]

- 16:00: 休憩を取る

- 5~15分単位に分解

- 16:00: 果物などの軽食を取る

- 16:05: 作業場の周りを散歩する

- [...]

エージェントは環境の変化や他のエージェントとのインタラクションに応じて、計画を動的に更新します。

実験

1. 実験環境

25体のエージェントが「Smallville」という小さな町で2日間生活します。町にはカフェ、バー、公園、学校、寮、住宅、店舗などが配置されています。

2. 制御実験による評価

5つの条件で比較:

- フルアーキテクチャ(記憶・リフレクション・プランニングあり)

- リフレクションなし

- リフレクション・プランニングなし

- 記憶・リフレクション・プランニングすべてなし

- 人間が書いた回答

各エージェントに対して5つのカテゴリに関する質問を行うことで評価を行いました。

100人の評価者による評価の結果、フルアーキテクチャが最も信頼性が高いと評価されました。各コンポーネントを削除するごとに性能が低下し、すべてなしの条件は最も低いスコアでした。

3. 創発的社会行動

2日間のシミュレーションで以下の創発的行動が観察されました:

情報拡散

- Samの市長選出馬: 1人(4%)→ 8人(32%)が知る

- Isabellaのバレンタインパーティー: 1人(4%)→ 13人(52%)が知る

関係形成

- エージェント同士が新しい友人関係を構築

協調行動

- Isabellaがパーティーを計画

- 12人が招待を受け、5人が実際に参加

まとめ

本論文では、LLMを活用した生成エージェントアーキテクチャを提案し、25体のエージェントによる人工社会のシミュレーションを実現しました。

主な貢献

- 記憶・リフレクション・プランニングを統合したアーキテクチャ

- もっともらしい行動の生成

- 情報拡散、関係形成、協調行動などの創発的社会行動の獲得

論文を読んで

本論文は、LLMを利用することで人工社会のシミュレーションを実現したものでした。

LLM単体の限界とアーキテクチャの重要性

実験結果から、LLM単体では人間のような振る舞いを行うことは難しいことが明確に示されました。

一方で、適切なアーキテクチャの構築によって人間らしさを獲得できることも実証されています。特に、3つのコンポーネント(記憶・リフレクション・プランニング)を統合したフルアーキテクチャは、人間が書いた回答よりも高い評価を得ており、アーキテクチャ設計の重要性が浮き彫りになっています。

創発的社会行動の興味深さ

筆者が最も興味深いと感じた点は、初期状態を付与するだけで創発的社会行動が観測できたことです。情報の拡散、関係の形成、協調行動といった複雑な社会的ふるまいが、明示的にプログラムされることなく自然に発生しました。

では、この創発性はどこから来るのでしょうか? 本論文のアーキテクチャを見ると、以下の要素が創発性を支えていると考えられます:

- 記憶の蓄積と検索: 過去の経験を参照することで、文脈に応じた行動が可能になる

- リフレクションによる抽象化: 個別の経験から高次の概念を抽出し、汎化された知識を形成する

- 動的なプランニング: 環境や他者の行動に応じて計画を更新し、適応的に対応する

- エージェント間の相互作用: 各エージェントの自律的な行動が組み合わさることで、予測困難な集団行動が生まれる

今後の課題:暗黙知の獲得

一方で、実際の人間社会には暗黙知が多く存在します。例えば:

- 場所や時間帯に応じた適切な行動(バーは昼食の場所ではない)

- 文化的・社会的な規範(形式的すぎる会話は不自然)

- 物理的な制約の理解(一人用トイレに複数人は入れない)

本論文でも、記憶が増えすぎると不適切な場所選択が見られるなど、このような暗黙知の欠如による問題が報告されています。

筆者は、このような暗黙知こそ社会での生活の中で獲得されていくものであると考えています。

エージェントが社会シミュレーションの中でどの程度、暗黙知を形成・獲得することができるのかという点は今後の重要な研究課題となるでしょう。

期待:LLM研究による人間理解の深化

LLMを用いたエージェントアーキテクチャの研究は、単に人工知能を発展させるだけでなく、人間の認知メカニズムを解明する手がかりにもなり得るでしょう。

記憶の検索方法、抽象化のプロセス、計画の立案と修正——これらをモデル化し実装することで、人間がどのように思考し、行動しているのかについて新たな洞察が得られる可能性があります。

LLMの研究を通じて、人間についてより深く理解されることを期待します。

【現在採用強化中です!】

- AIエンジニア

- PM/PdM

- 戦略投資コンサルタント

▼代表とのカジュアル面談URL

Discussion