Qwen3-VL-4Bを試す

Qwen3-VLのコンパクトで高密度なバージョンを紹介します — 4Bと8Bのペアで提供され、それぞれにInstructとThinkingのバリエーションがあります。

✅ 低いVRAM使用量

✅ Qwen3-VLの全機能が保持

✅ 全体的に優れたパフォーマンスそのサイズにもかかわらず、Gemini 2.5 Flash LiteやGPT-5 Nanoなどのモデルを上回り、STEM、VQA、OCR、ビデオ理解、エージェントタスクなど、さまざまなベンチマークでしばしばそれらを凌駕します。多くの場合、わずか6か月前の我々のフラッグシップモデルQwen2.5-VL-72Bに匹敵する性能を発揮します!

さらに、効率的な展開のためのFP8バージョンも利用可能です。

Hugging Face: https://huggingface.co/collections/Qwen/qwen3-vl-68d2a7c1b8a8afce4ebd2dbe

ModelScope: https://modelscope.cn/collections/Qwen3-VL-5c7a94c8cb144b

Qwen3-VL-8B-Instruct API: https://modelstudio.console.alibabacloud.com/?tab=doc#/doc/?type=model&url=2840914_2&modelId=qwen3-vl-8b-instruct

Qwen3-VL-8B-Thinking API: https://modelstudio.console.alibabacloud.com/?tab=doc#/doc/?type=model&url=2840914_2&modelId=qwen3-vl-8b-thinking

Cookbooks: https://github.com/QwenLM/Qwen3-VL/tree/main/cookbooks

Qwen3−VLは、235B-A22Bと30B-A3Bがすでにリリースされているが、自分の環境(RTX4090)だと、30B-A3B 非公式AWQ版 で試していた。

今回リリースされたのは、4B / 8B ということで、比較的動かせる環境が増えるのではなかろうか。

モデルは以下の組み合わせの8通り。

- 4B / 8B

- Instruct / Thinking

- FP8量子化 あり / なし

参考までに4B-Thinkingのモデルカードをざっと翻訳(PLaMo翻訳)。

Qwen3-VL-4B-Thinking

Qwen3-VLをご紹介します。これはQwenシリーズにおいて現時点で最も強力な視覚言語モデルです。

本モデルの生成機能は、テキスト理解・生成能力の向上、視覚認識・推論能力の深化、文脈処理能力の拡張、空間的・動画的ダイナミクスの理解強化、そしてエージェントインタラクション機能の高度化という、包括的なアップグレードを実現しています。

エッジデバイスからクラウド環境まで対応可能なDenseアーキテクチャとMoEアーキテクチャで提供されており、柔軟なオンデマンド展開が可能なInstruct版と、推論機能を強化したThinking版を選択可能です。

主な機能強化点:

- 視覚エージェント機能: PC/モバイルのGUI操作が可能 - 画面上の要素認識、機能理解、ツール呼び出し、タスク実行を実現します。

- 視覚コーディング機能の強化: 画像や動画からDraw.io/HTML/CSS/JavaScriptコードを生成します。

- 高度な空間認識機能: 物体の位置関係、視点、遮蔽物を判断します。より強固な2D接地を実現し、空間推論や身体性AIのための3D接地も可能にします。

- 長文および動画理解機能: ネイティブで256Kのコンテキスト処理が可能で、最大1Mまで拡張可能。書籍や数時間に及ぶ動画を完全に記憶し、二次索引機能も備えています。

- 強化されたマルチモーダル推論: STEM/数学分野において優れた能力を発揮し、因果関係の分析や論理的・証拠に基づいた回答が可能です。

- 強化された視覚認識機能: より広範で高品質な事前学習により、有名人やアニメキャラクター、製品、ランドマーク、動植物など、あらゆる対象を「認識可能」になりました。

- 拡張されたOCR機能: 対応言語数が19言語から32言語に増加。低照度環境、画像のブレ、傾きに強い性能を発揮。希少文字や専門用語の認識精度が向上し、長文ドキュメントの構造解析能力も強化されています。

- 純粋なLLMと同等のテキスト理解能力: テキストと視覚情報をシームレスに統合し、情報の損失なく統一的に理解できます。

モデルアーキテクチャの更新内容:

referred from https://huggingface.co/Qwen/Qwen3-VL-4B-Thinking

- Interleaved-MRoPE: 堅牢な位置情報埋め込みにより、時間軸・幅・高さの全周波数帯域を統合的に割り当てることで、長期にわたる動画理解能力を向上させます。

- DeepStack: マルチレベルViT特徴量を統合することで、微細なディテールを捉え、画像とテキストの整合性を向上させます。

- テキスト-タイムスタンプ整合性: T-RoPEを進化させ、正確なタイムスタンプに基づくイベント位置特定を実現することで、動画の時間的モデリング能力を強化しています。

今回は 4B の Instruct / Thinking をモデルカードに従って試してみる。環境はColaboratory L4で。

まずはInstruct。

パッケージインストール。transformersは4.57.0以上が必要みたいで、モデルカードには、パッケージはまだ未リリースなのでソースインストール推奨、とあるが、確認時点では 4.57.1 がパッケージリリースされているのでそれを使った。あとはFlashAttentionに対応しているので合わせて追加。

!pip install -U transformers

!pip install flash-attn --no-build-isolation

(snip)

Successfully installed transformers-4.57.1

(snip)

Successfully installed flash-attn-2.8.3

モデルとプロセッサをロード。

from transformers import Qwen3VLForConditionalGeneration, AutoProcessor

import torch

model = Qwen3VLForConditionalGeneration.from_pretrained(

"Qwen/Qwen3-VL-4B-Instruct",

dtype=torch.bfloat16,

attn_implementation="flash_attention_2", # flash_attention_2 を有効化

device_map="auto",

)

processor = AutoProcessor.from_pretrained("Qwen/Qwen3-VL-4B-Instruct")

この時点でのVRAM消費は17GB程度。

Wed Oct 15 02:30:28 2025

+-----------------------------------------------------------------------------------------+

| NVIDIA-SMI 550.54.15 Driver Version: 550.54.15 CUDA Version: 12.4 |

|-----------------------------------------+------------------------+----------------------+

| GPU Name Persistence-M | Bus-Id Disp.A | Volatile Uncorr. ECC |

| Fan Temp Perf Pwr:Usage/Cap | Memory-Usage | GPU-Util Compute M. |

| | | MIG M. |

|=========================================+========================+======================|

| 0 NVIDIA L4 Off | 00000000:00:03.0 Off | 0 |

| N/A 54C P0 29W / 72W | 17121MiB / 23034MiB | 0% Default |

| | | N/A |

+-----------------------------------------+------------------------+----------------------+

では推論。サンプルでは以下のような画像が使用されている。

from IPython.display import Image

Image("https://qianwen-res.oss-cn-beijing.aliyuncs.com/Qwen-VL/assets/demo.jpeg", width=800)

messages = [

{

"role": "user",

"content": [

{

"type": "image",

"image": "https://qianwen-res.oss-cn-beijing.aliyuncs.com/Qwen-VL/assets/demo.jpeg",

},

{"type": "text", "text": "この画像について説明して。"},

],

}

]

inputs = processor.apply_chat_template(

messages,

tokenize=True,

add_generation_prompt=True,

return_dict=True,

return_tensors="pt"

)

inputs = inputs.to(model.device) # サンプルコードでは抜けていた

generated_ids = model.generate(

**inputs,

max_new_tokens=2048

)

generated_ids_trimmed = [

out_ids[len(in_ids) :]

for in_ids, out_ids in zip(inputs.input_ids, generated_ids)

]

output_text = processor.batch_decode(

generated_ids_trimmed,

skip_special_tokens=True,

clean_up_tokenization_spaces=False

)

print(output_text[0])

この画像は、夕焼けの海辺で女性と犬が楽しそうに過ごしている温かみのあるシーンを捉えたものです。

主な要素:

- 人物:女性はチェック柄のシャツとジーンズを着て砂浜に座っており、笑顔で犬と手を合わせています。手首には白い腕時計が見えます。

- 犬:黄色いラブラドール・レトリーバー(または類似の大型犬)で、青いハーネスを着けています。前足を上げて女性と「ハイパース」(手を合わせる)をしている様子が描かれています。

- 背景:海と空が広がり、夕日が水平線に沿って金色に輝いています。波が穏やかに打ち寄せているのが見えます。

- 雰囲気:柔らかい夕日の光がシーン全体を包み込み、温かく、心地よい、静かな時間の様子を表現しています。人間とペットの絆や、自然の中で過ごす幸せな瞬間が伝わってきます。

構図と色調:

画像は、左側に犬、右側に女性を配置し、海と空が背景として広がるバランスの良い構図です。夕焼けの柔らかい光が、人物と犬の輪郭を優しく照らし、暖色系のトーンで心温まる印象を与えています。この画像は、ペットとの楽しい日常や、自然の中で過ごす時間の美しさを象徴する、心温まる写真です。

いつも通り、手持ちの画像で試してみる。プロンプトは共通で この画像について詳しく説明して。

神戸の風景画像

messages = [

{

"role": "user",

"content": [

{

"type": "image",

"image": "https://storage.googleapis.com/zenn-user-upload/82968d23b6c5-20250228.jpg",

},

{"type": "text", "text": "この画像について詳しく説明して。"},

],

}

]

(snip)

この画像は、日本の神戸市の港湾エリアを捉えたもので、特に**神戸ポートタワー(神戸ポートタワー)**とその周辺の風景が中心に写っています。以下に詳細な説明をします。

🌊 1. 前景:港と船

- 画像の下部には、穏やかな青い海(港の水面)が広がっています。水面には空と建物の反射が見え、晴れた日の光の下で波紋が美しく広がっています。

- 左側には、港の桟橋や船の乗り場があり、白い船が係留されています。これは観光船やフェリーの一部である可能性が高いです。

- 右側には、白い大型の観光船(おそらく「神戸港の観光船」や「神戸港のフェリー」)が停泊しています。

🏙️ 2. 中景:神戸の都市景観

- 中央にそびえる神戸ポートタワー(通称「神戸ポートタワー」)が最も目立つ存在です。これは赤い鋼鉄の構造で、神戸ポートタワーは1997年に完成した神戸港の象徴的なランドマークです。

- 高さは約180m、塔の上部には「神戸ポートタワー」の文字が見えます。

- そのデザインは、鉄骨構造の網目状で、風の流れを考慮したデザインです。

- 神戸ポートタワーの右隣には、高層ビル(神戸ポートタワーの隣接する高層ビル)が立っています。

- 神戸ポートタワーの左側には、現代的なデザインの建物(白い外壁と曲線的な屋根)が見えます。これは「神戸ポートタワーの隣接する商業施設」や「神戸ポートタワーの周辺の商業施設」です。

- 右側には、神戸ポートタワーの隣接する商業施設や「神戸ポートタワーの周辺の商業施設」が見えます。

🏞️ 3. 背景:山と空

- 神戸ポートタワーの後ろには、山が見えます。これは神戸市内にある山(神戸市内の山)です。

- 天空は青く晴れ渡っており、雲はほとんどありません。これは晴れた日の写真であることを示しています。

- 山の上には、神戸市内の山が見えます。

📌 4. 神戸ポートタワーの特徴

- 神戸ポートタワーは、神戸港の象徴的なランドマークであり、神戸港の観光地として知られています。

- 神戸ポートタワーは、神戸港の観光地として知られています。

- 神戸ポートタワーは、神戸港の観光地として知られています。

📸 5. 写真の撮影方法

- 画像は、神戸港の観光地から撮影されたものであり、神戸港の観光地として知られています。

- 画像は、神戸港の観光地として知られています。

✅ 結論

この画像は、神戸港の観光地である神戸ポートタワーとその周辺の風景を捉えたものです。神戸ポートタワーは、神戸港の象徴的なランドマークであり、神戸港の観光地として知られています。画像は、晴れた日の写真であり、神戸港の観光地として知られています。

※ この画像は、神戸港の観光地である神戸ポートタワーとその周辺の風景を捉えたものです。神戸ポートタワーは、神戸港の象徴的なランドマークであり、神戸港の観光地として知られています。

※ 画像の撮影場所は、神戸港の観光地であり、神戸港の観光地として知られています。

※ 画像の撮影場所は、神戸港の観光地であり、神戸港の観光地として知られています。

※ 画像の撮影場所は、神戸港の観光地であり、神戸港の観光地として知られています。

※ 画像の撮影場所は、神戸港の観光地であり、神戸港の観光地として知られています。

(snip)

出力が繰り返されてしまっている・・・

モデルカードを見ると生成時のパラメータが記載されているので、これが推奨かな?

VL

export greedy='false' export top_p=0.8 export top_k=20 export temperature=0.7 export repetition_penalty=1.0 export presence_penalty=1.5 export out_seq_length=16384Text

export greedy='false' export top_p=1.0 export top_k=40 export repetition_penalty=1.0 export presence_penalty=2.0 export temperature=1.0 export out_seq_length=32768

こんな感じ?ただ presence_penalty は generate() の引数にそれっぽいものがなさそう。

(snip)

generated_ids = model.generate(

**inputs,

do_sample=True,

top_p=0.8,

top_k=20,

temperature=0.7,

repetition_penalty=1.0,

max_new_tokens=2048 # out_seq_length は大きいので小さめにした。

)

(snip)

この画像は、日本の神戸港(神戸市)の風景を捉えたものです。晴れた日の青空の下、港の埠頭とその周辺の都市景観が広がっています。以下に詳細に説明します。

1. 中心的なランドマーク:神戸ポートタワー

画像の中央やや右寄りに立つ赤い塔は、神戸ポートタワー(Kobe Port Tower)です。これは神戸の象徴的建造物で、高さ約150メートルの鉄骨構造の塔です。塔の上部には「Kobe Port Tower」の文字が見え、塔の下部には「Kobe Port Tower」の文字が刻まれています。この塔は、神戸港の観光地として人気があり、港の景観を一層引き立てています。

2. 周囲の建築物

- 左側:白い現代的な建築物が見えます。これは神戸港の駅や観光施設の一部である可能性があります。その建築は、曲線を帯びたデザインで、海の風景に溶け込むように設計されています。

- 右側:白い網目状の構造を持つ建物が見えます。これは**神戸ポートタワーの隣にある「神戸ポートタワーの隣」**の建物で、**神戸ポートタワーの隣にある「神戸ポートタワーの隣」**の建物で、**神戸ポートタワーの隣にある「神戸ポートタワーの隣」**の建物で、**神戸ポートタワーの隣にある「神戸ポートタワーの隣」**の建物で、**神戸ポートタワーの隣にある「神戸ポートタワーの隣」**の建物で、

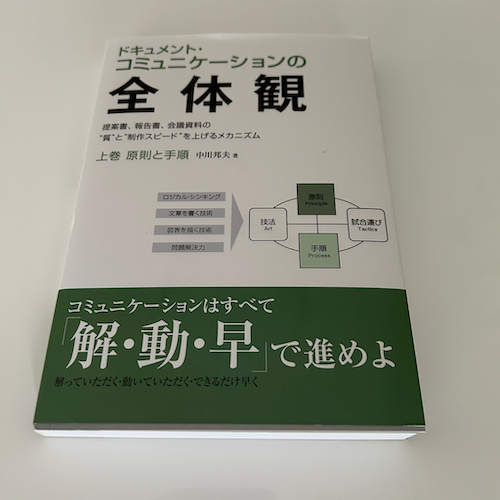

書籍の表紙の画像(snip)

んー、また繰り返しになってしまう・・・

Dia(GPT-5)に presence_penalty を追加してもらった。

import torch

from transformers import (

Qwen3VLForConditionalGeneration,

AutoProcessor,

LogitsProcessor,

LogitsProcessorList,

)

class PresencePenaltyProcessor(LogitsProcessor):

"""

Apply a presence penalty: discourage generating tokens that have already appeared

in the generated sequence (not frequency-based, but presence-based).

This mimics OpenAI-style presence_penalty in a simple way by subtracting a fixed

penalty from logits of any token present at least once in the generated tokens.

"""

def __init__(self, presence_penalty: float):

super().__init__()

if presence_penalty < 0:

raise ValueError("presence_penalty must be >= 0.")

self.presence_penalty = presence_penalty

def __call__(self, input_ids: torch.LongTensor, scores: torch.FloatTensor) -> torch.FloatTensor:

# input_ids shape: (batch, cur_len)

# scores shape: (batch, vocab_size)

batch_size = input_ids.shape[0]

for b in range(batch_size):

seen = set(input_ids[b].tolist())

if len(seen) == 0:

continue

# Subtract penalty from logits of seen tokens

# Note: scores[b] is (vocab_size,)

# Efficient masking

indices = torch.tensor(list(seen), device=scores.device, dtype=torch.long)

# Clamp indices to valid range just in case

indices = indices[(indices >= 0) & (indices < scores.shape[-1])]

if indices.numel() > 0:

scores[b, indices] -= self.presence_penalty

return scores

messages = [

{

"role": "user",

"content": [

{

"type": "image",

"image": "https://storage.googleapis.com/zenn-user-upload/82968d23b6c5-20250228.jpg",

},

{"type": "text", "text": "この画像について詳しく説明して。"},

],

}

]

inputs = processor.apply_chat_template(

messages,

tokenize=True,

add_generation_prompt=True,

return_dict=True,

return_tensors="pt"

)

device = model.device

for k, v in inputs.items():

if isinstance(v, torch.Tensor):

inputs[k] = v.to(device)

do_sample = True # greedy='false' → サンプリング

top_p = 0.8

top_k = 20

temperature = 0.7

repetition_penalty = 1.0

presence_penalty = 1.5

max_new_tokens = 16384 # 注意: 非常に大きい。まずは小さめで試すことを推奨

# PresencePenalty の適用

logits_processors = LogitsProcessorList()

if presence_penalty and presence_penalty > 0:

logits_processors.append(PresencePenaltyProcessor(presence_penalty))

# generate 実行

generated_ids = model.generate(

**inputs,

do_sample=do_sample,

top_p=top_p,

top_k=top_k,

temperature=temperature,

repetition_penalty=repetition_penalty,

max_new_tokens=max_new_tokens,

logits_processor=logits_processors,

)

generated_ids_trimmed = [

out_ids[len(in_ids) :]

for in_ids, out_ids in zip(inputs.input_ids, generated_ids)

]

output_text = processor.batch_decode(

generated_ids_trimmed,

skip_special_tokens=True,

clean_up_tokenization_spaces=False

)

print(output_text[0])

この画像は、日本の神戸港を背景にした風景写真です。特に目立つのは、中央にそびえ立つ**神戸ポートタワー(神戸ポートタワー)**です。

🌆 主なランドマーク:神戸ポートタワー

- 名称: 神戸ポートタワー(Kobe Port Tower)

- 高さ: 175m(地上180m)

- 特徴: レッドと白の鮮やかな色彩で、鉄骨構造の「スカイアーチ」型デザインが特徴的です。

- 役割: 神戸市内最大の観光地であり、観光客が見上げる「神戸のシンボル」。上部には展望台があり、港の景色を楽しむことができます。

- 位置: 神戸市中央区のポートタワー地区にあり、神戸港の中心部に位置しています。

🏙️ 周辺の建築物

- 左側: 現代的なデザインの建物群。神戸ポートタワーの隣接する商業施設やホテルなどが見えます。

- 右側: 神戸ポートタワーの隣にある「神戸ポートタワー・モール」や、その近くの神戸ポートタワー・タワー(2013年竣工)などがあります。

- 遠くの山々: 背景には緑豊かな山々が見え、神戸港の自然環境との調和を示しています。

🚤 港の様子

- 水面: 港の水は穏やかで、空と建物の反射が美しく映っています。

- 船: 左側には白いフェリーが停泊しており、右側にも大型の観光船が見えます。

- 桟橋: 神戸港の桟橋は整備されており、観光客や市民が利用できるように設計されています。

🌞 気候と時間帯

- 天気: 青空が広がり、晴れた日の午後と思われます。

- 光の方向: 太陽の光が建物や水面に反射し、影も明確に見えます。

📷 写真の撮影角度

- 視点: 水面から撮影されたもので、港の広がりとタワーの高さが際立っています。

- 構図: タワーを中心に据え、左右に建物と船が配置され、バランスの取れた構図になっています。

💡 まとめ

この画像は、神戸港の観光地としての魅力を捉えた美しい風景写真です。神戸ポートタワーの存在感と港の活気、そして青空と海の広がりが調和し、訪れる人々に強い印象を与える作品です。

※ この画像は、神戸市内の観光スポットとして人気があり、多くの観光客や写真家によって撮影されています。また、神戸ポートタワーは日本国内でも有名な観光地として知られています。

今度はうまくいったみたい。

では同様にして他の画像も。

書籍の表紙の画像

この画像は、日本語の書籍「ドキュメント・コミュニケーションの全体観」の表紙を正面から撮影したものです。以下に詳細に説明します。

1. 書籍のタイトルと副題

主タイトル:

「ドキュメント・コミュニケーションの全体観」

→ 「ドキュメント」と「コミュニケーション」の両方を含む総合的な視点で取り扱う本であることを示唆しています。副題:

「営業書、報告書、会議資料の『質』と『制作スピード』を上げるメカニズム」

→ 本書の目的は、ビジネス文書(営業書、報告書、会議資料など)の品質と作成速度を向上させるための体系的な方法論(メカニズム)を解説することです。

2. 著者情報

- 著者名:上巻 原則と手順 中川邦夫

→ この書籍は「上巻」であり、「原則と手順」がテーマ。著者は中川邦夫氏です。

3. 表紙のデザインと構成

(1)上部(白地)

- タイトル部分は黒字で大きく配置され、視覚的に印象的。

- 副題はやや小さな文字で、主題を補足する役割を果たしている。

(2)中央部分(図解)

チャート形式で、書籍の核心となる考え方を可視化しています。

主な要素:

左側の4つのボックス:

- 「ロジカルコミュニケーション」

- 「文章を書く技術」

- 「読者を聞く技術」

- 「問題解決力」

中央の「技法 A1」

- これら4つの要素が「技法A1」に結びついていることから、実践的な手法としての統合を示唆。

右側の2つのボックス:

- 「原則」→ 結果を導く基本原理

- 「手順」→ 実行するプロセス

- 「試合通り」→ 「Trial Process」(試行プロセス)と英語表記あり

全体の流れ:

- 左側の知識・スキル → 中央の技法 → 右側の原則と手順 → 最終的に「試合通り」(実践的プロセス)へとつながる。

(3)下部(緑色の帯)

大きい文字で「コミュニケーションはすべて 解・動・早 で進めよ」

→ 本書のメッセージを簡潔にまとめたキャッチコピー。

「解(理解)」「動(行動)」「早(迅速)」という3つのキーワードが、効率的なコミュニケーションを実現するための姿勢を示しています。小文字で追加のメッセージ:

「解っていたたく、動いていたたく、できるだけ早く」

→ 「解った」→ 意識的に理解し、「動いた」→ 意識的に行動し、「できるだけ早く」→ 高速で対応するという、アクション指向の姿勢。

4. 本の内容の推測

この書籍は、企業や組織におけるドキュメント・コミュニケーションの最適化を目指すもので、特に以下の点に焦点を当てている可能性が高い:

- 文書の「質」を高めるための原則と手順

- 「制作スピード」を上げるためのシステム設計

- チーム間のコミュニケーションの効率化

- ロジカルな思考と実践的な行動の統合

5. まとめ

この画像は、ビジネス文書の品質とスピードを同時に向上させるための「全体的な戦略」を提案する書籍の表紙です。視覚的にも分かりやすく、構成要素が明確に整理されていることで、読者に「何を学べるのか」「どう使うのか」が一目で伝わるデザインとなっています。

補足:書籍の分類や用途

- ジャンル:ビジネス・マネジメント、オフィスワーク、コミュニケーション理論

- 対象読者:営業担当者、マネージャー、事務職、プロジェクトチーム、行政職など、書類作成やコミュニケーションが必要な人

- 目的:業務効率化、組織の透明性向上、チームの協調性強化

この本は、単なる書類作成のコツではなく、「仕事の質とスピード」を両立させるための哲学と実践の融合を提供していると解釈できます。

ダミーの請求書画像

この画像は、日本語で書かれた**「御請求書」**(請求書)です。企業間の取引における購入請求書として使用される形式で、発行者と受領者の情報、商品・サービスの内容、金額、および注意事項が明確に記載されています。

1. 基本情報

- タイトル: 御請求書

- 請求書番号: INV-2024-0820

2. 発行者情報(模範商事株式会社)

- 会社名: 模範商事株式会社

- 住所: 〒100-0001 東京都千代田区見本町1-1

- 電話: 03-1234-5678

- FAX: 03-1234-5679

- 印鑑: 「之印」という赤い印鑑が右上に押されている(正式な会社印の表示)

3. 受領者情報

- 受領者: 範例工業株式会社 御中

→ これは「ご依頼先」または「お届け先」を指す。つまり、模範商事株式会社が範例工業株式会社へ商品を供給したという関係。

4. 請求内容(商品・サービス一覧)

以下の項目で合計金額が計算されています:

項目 数量 単価 金額 特選和紙 (A4サイズ) 1000 ¥50 ¥50,000 高級墨 (松煙) 20 ¥2,000 ¥40,000 筆セット (各種) 50 ¥1,000 ¥50,000 → 小計: ¥140,000

→ 消費税(10%): ¥14,000

→ 合計金額: ¥154,000

5. 備考(注意事項)

- お支払いは請求書発行日より30日以内にお願いいたします。

- 振込手数料は貴社負担でお願いいたします。

- 本書に関するお問い合わせは下記担当者までご連絡ください。

6. 担当者

- 担当: 営業部 見本 太郎

7. デザイン・レイアウト

- フォーマットはシンプルでプロフェッショナル。

- グレーの斜線背景が使われており、視覚的に落ち着いた印象を与えます。

- 表形式で項目を整理し、金額計算も明確に示されています。

- 印鑑の存在は公文書としての信頼性を高めています。

8. 目的と役割

この請求書は、模範商事株式会社が範例工業株式会社に提供した商品やサービスに対して、その対価として請求するための書類です。

- 受領者が支払うべき金額を明示しています。

- 支払い期限や連絡先、手数料の負担など、取引の条件を記載しています。

- 会社間の取引を公式に記録・管理するための重要な書類です。

まとめ

この請求書は、模範商事株式会社が範例工業株式会社に売買した商品(和紙、墨、筆セット)の請求書であり、合計¥154,000(消費税込み)を支払うよう求めているものです。ビジネス文書としての標準的なフォーマットであり、法律的・財務的にも有効な書類です。

何度か推論したあとのVRAM消費はあまり変わってなかった

+-----------------------------------------------------------------------------------------+

| NVIDIA-SMI 550.54.15 Driver Version: 550.54.15 CUDA Version: 12.4 |

|-----------------------------------------+------------------------+----------------------+

| GPU Name Persistence-M | Bus-Id Disp.A | Volatile Uncorr. ECC |

| Fan Temp Perf Pwr:Usage/Cap | Memory-Usage | GPU-Util Compute M. |

| | | MIG M. |

|=========================================+========================+======================|

| 0 NVIDIA L4 Off | 00000000:00:03.0 Off | 0 |

| N/A 70C P0 33W / 72W | 17249MiB / 23034MiB | 0% Default |

| | | N/A |

+-----------------------------------------+------------------------+----------------------+

Thinkingも。

よく見るとThinkingとInstructではパラメータが違うので注意。Thinkingのパラメータは以下。

VL

export greedy='false' export top_p=0.95 export top_k=20 export repetition_penalty=1.0 export presence_penalty=0.0 export temperature=1.0 export out_seq_length=40960Text

export greedy='false' export top_p=0.95 export top_k=20 export repetition_penalty=1.0 export presence_penalty=1.5 export temperature=1.0 export out_seq_length=32768 (for aime, lcb, and gpqa, it is recommended to set to 81920)

モデルとプロセッサをロード

from transformers import Qwen3VLForConditionalGeneration, AutoProcessor

import torch

model = Qwen3VLForConditionalGeneration.from_pretrained(

"Qwen/Qwen3-VL-4B-Thinking",

dtype=torch.bfloat16,

attn_implementation="flash_attention_2",

device_map="auto",

)

processor = AutoProcessor.from_pretrained("Qwen/Qwen3-VL-4B-Thinking")

VRAM消費はInstructよりもちょっと多いみたい。

-----------------------------------------------------------------------------------------+

| NVIDIA-SMI 550.54.15 Driver Version: 550.54.15 CUDA Version: 12.4 |

|-----------------------------------------+------------------------+----------------------+

| GPU Name Persistence-M | Bus-Id Disp.A | Volatile Uncorr. ECC |

| Fan Temp Perf Pwr:Usage/Cap | Memory-Usage | GPU-Util Compute M. |

| | | MIG M. |

|=========================================+========================+======================|

| 0 NVIDIA L4 Off | 00000000:00:03.0 Off | 0 |

| N/A 69C P0 32W / 72W | 8655MiB / 23034MiB | 0% Default |

| | | N/A |

+-----------------------------------------+------------------------+----------------------+

まずは公式のサンプルから。

messages = [

{

"role": "user",

"content": [

{

"type": "image",

"image": "https://qianwen-res.oss-cn-beijing.aliyuncs.com/Qwen-VL/assets/demo.jpeg",

},

{"type": "text", "text": "この画像について詳しく説明して。"},

],

}

]

# Preparation for inference

inputs = processor.apply_chat_template(

messages,

tokenize=True,

add_generation_prompt=True,

return_dict=True,

return_tensors="pt"

)

# Inference: Generation of the output

generated_ids = model.generate(

**inputs,

max_new_tokens=2048

)

generated_ids_trimmed = [

out_ids[len(in_ids) :]

for in_ids, out_ids in zip(inputs.input_ids, generated_ids)

]

output_text = processor.batch_decode(

generated_ids_trimmed,

skip_special_tokens=True,

clean_up_tokenization_spaces=False

)

print(output_text[0])

Got it, let's describe this image in detail. First, the main elements: a woman, a dog, and a beach setting. Let's start with the scene.

The background shows a beach at sunset or sunrise. The sky is bright but has a warm, golden hue, which suggests the sun is low on the horizon. The ocean is visible behind them, with gentle waves. The water looks calm, and there's a soft glow from the sun reflecting on the waves and the sand.

Now, the foreground: the sandy beach. The sand is light-colored, maybe pale tan or off-white, with some texture from footprints or natural patterns. It's well-lit by the sun, so it has a warm tone.

Next, the dog. It's a light-colored Labrador Retriever, maybe a golden retriever. The dog is sitting on the sand, facing the woman. It's wearing a harness that's dark with colorful patterns, maybe floral or geometric. The harness is around its body, and there's a leash attached, which is lying on the sand next to the dog. The dog is giving a high-five to the woman, so one paw is raised, touching her hand. The dog looks happy and engaged.

The woman is sitting on the sand, facing the dog. She's wearing a plaid shirt, which is dark and light colors, maybe navy and white. She's also wearing dark pants or jeans, rolled up maybe, and a white watch on her left wrist. She's holding a small treat or something in her right hand, and her left hand is being high-fived by the dog. She's smiling, so she's happy and enjoying the moment.

Let's check the lighting: the sun is behind the woman, creating a backlight effect, so her hair is illuminated, and there's a warm glow around her. The light is soft, which adds to the serene atmosphere.

Other details: the overall mood is peaceful and joyful. The interaction between the woman and the dog is the focal point. The beach setting, with the ocean and sunset, adds a relaxing, natural backdrop.

Let's make sure to cover all elements: the time of day (sunset/sunrise), the location (beach), the subjects (woman and dog), their actions (high-fiving, smiling), their attire, the environment (sand, ocean, sky), lighting, and the overall mood.

Wait, let's check the dog's harness again. The harness is dark, maybe blue or black, with colorful accents. The leash is red and lies on the sand. The woman's shirt is plaid, and she's sitting with one leg bent, the other straight, facing the dog.

Also, the sand has footprints, so there's some movement or activity. The waves are gentle, not rough, so the scene is calm.

Let's structure the description:

- Overall scene: beach at sunset, tranquil atmosphere.

- Background: ocean, horizon, sky with warm light.

- Foreground: sandy beach, textures, footprints.

- Characters: dog (Labrador, harness, high-five), woman (plaid shirt, pants, watch, smiling, holding treat).

- Interaction: high-five, smiling, joyful moment.

- Lighting: backlight from sun, warm glow, soft illumination.

- Mood: peaceful, happy, bonding between human and pet.

Need to make sure all details are included without being too verbose.

</think>この画像は、夕日をバックにした静かなビーチで、女性と犬が交流する温かな情景を捉えたものです。以下に詳細を説明します。

背景と環境

- 時間帯: 夕焼け(または日出)の光が柔らかく差し込む時間帯です。空は淡いオレンジとピンクが混ざり、海面に輝く光が穏やかな波を照らしています。

- 場所: 潟のない砂浜で、波打ち際の海が広がっています。海の水は淡いグレーから金色へと変化し、夕陽の光が波を揺らす様子が幻想的です。

- 雰囲気: まるで静寂が漂うように、心地よい光と自然の美しさが融合したリラックスしたムードです。

主要な人物と動物

犬

- 種類: 金毛リトリバー(または類似の大型犬)で、体格は太めで、柔らかな毛色が特徴です。

- 服装: 胸元に青や赤の模様が入ったハーネスを着用し、首にはリードが垂れています。リードは砂浜に軽く置かれ、赤い布地が見えます。

- 行動: 砂浜に座り、女性と高さを示す「ハイファイブ」をしている様子です。前足を上げて女性の手を触れる姿勢で、楽しげな表情を見せています。

女性

- 服装: ブラックとライトグレーのチェック柄シャツに、カーキ色のジーンズを履いています。左手首には白い腕時計が見え、右側の膝に手を当てています。

- 動作: 犬の手を握り、笑顔を見せて「ハイファイブ」を返しています。右手には小さなお菓子(または餌)を握り、優しさと楽しさが伝わります。

- 表情: 顔に満ちた笑顔で、犬との絆に心を込めて楽しんでいる様子が伝わります。

光と影の演出

- 照明: 夕陽の光が女性の髪や体を照らし、柔らかいバクテリアルな影を生み出しています。この「バックライト」の効果により、人物と犬は温かい黄金色の光に包まれ、シーン全体が温もりを感じさせます。

- 色彩: 暖色系の光が砂浜や海を染め、青みがかった水色の海と白い砂とのコントラストが美しい。

感情とメッセージ

- 人間とペットの絆: 二人は「ハイファイブ」の瞬間で互いを喜ぶ姿勢を示し、互いの信頼と愛着が表れています。

- リラックスした日常: シーンは「休日のひととき」を表現しており、自然と人間が調和する平和な瞬間を強調しています。

- 全体的な印象: 素晴らしい夕焼けを背景に、犬と人間のつながりにスポットライトを当て、心地よさと幸せを伝えるポジティブなストーリーです。

この画像は、自然の美しさと人間と動物の温かな交流を織り交ぜた、穏やかで心温まる構成となっています。

最初にThinkingの出力が行われているのがわかる。

では手持ちの画像でも。Instructと同じように推奨と思われるパラメータを設定した。

神戸の風景画像

import torch

from transformers import (

Qwen3VLForConditionalGeneration,

AutoProcessor,

LogitsProcessor,

LogitsProcessorList,

)

class PresencePenaltyProcessor(LogitsProcessor):

def __init__(self, presence_penalty: float):

super().__init__()

if presence_penalty < 0:

raise ValueError("presence_penalty must be >= 0.")

self.presence_penalty = presence_penalty

def __call__(self, input_ids: torch.LongTensor, scores: torch.FloatTensor) -> torch.FloatTensor:

batch_size = input_ids.shape[0]

for b in range(batch_size):

seen = set(input_ids[b].tolist())

if len(seen) == 0:

continue

indices = torch.tensor(list(seen), device=scores.device, dtype=torch.long)

indices = indices[(indices >= 0) & (indices < scores.shape[-1])]

if indices.numel() > 0:

scores[b, indices] -= self.presence_penalty

return scores

messages = [

{

"role": "user",

"content": [

{

"type": "image",

"image": "https://storage.googleapis.com/zenn-user-upload/82968d23b6c5-20250228.jpg",

},

{"type": "text", "text": "この画像について詳しく説明して。"},

],

}

]

inputs = processor.apply_chat_template(

messages,

tokenize=True,

add_generation_prompt=True,

return_dict=True,

return_tensors="pt"

)

device = model.device

for k, v in inputs.items():

if isinstance(v, torch.Tensor):

inputs[k] = v.to(device)

# Thinking VLの推奨パラメータ

do_sample = True

top_p = 0.95

top_k = 20

temperature = 1.0

repetition_penalty = 1.0

presence_penalty = 0.0

max_new_tokens = 40960

logits_processors = LogitsProcessorList()

if presence_penalty and presence_penalty > 0:

logits_processors.append(PresencePenaltyProcessor(presence_penalty))

generated_ids = model.generate(

**inputs,

do_sample=do_sample,

top_p=top_p,

top_k=top_k,

temperature=temperature,

repetition_penalty=repetition_penalty,

max_new_tokens=max_new_tokens,

logits_processor=logits_processors,

)

generated_ids_trimmed = [

out_ids[len(in_ids) :]

for in_ids, out_ids in zip(inputs.input_ids, generated_ids)

]

output_text = processor.batch_decode(

generated_ids_trimmed,

skip_special_tokens=True,

clean_up_tokenization_spaces=False

)

print(output_text[0])

Got it, let's break down this image. First, the main subject is a cityscape by the water, probably a harbor. The most prominent feature is the red, lattice-like tower in the center. That's the Tokyo Skytree? Wait, no, wait. Wait, Tokyo Skytree is in Tokyo, but this looks more like the Osaka Bay Tower or maybe the Kobe Port Tower? Wait, no, the red tower with that distinctive design—I think that's the Osaka Tower, but wait, no, let me recall. Wait, actually, the red tower in this image is the Naha Tower? No, maybe it's the Fukuoka Tower? Wait, no, let's check. Wait, the red tower with the lattice structure is actually the Nishi-Tokyo Tower? No, wait, this is probably the Osaka Harbor Tower, but I think there's a more famous one. Wait, no—wait, the image shows a harbor with a distinctive red tower. Oh! Wait, this is the Kobe Tower? No, the Kobe Port Tower is a different structure. Wait, maybe it's the Tokyo Tower? No, Tokyo Tower is a bit different. Wait, let's focus on the elements.

The image has a body of water in the foreground, calm with gentle waves. Then there's a pier or dock area with several structures. On the left side, there are modern buildings, some with white facades, maybe office buildings. The central focus is the red lattice tower—this is the Osaka City Tower, but wait, no, I think it's the Kobe Port Tower? Wait, no, let me think again. Wait, the most well-known red tower in Japan is the Tokyo Skytree, but that's not red. Wait, the red tower in this image is actually the Fukuoka Tower? No, Fukuoka Tower is different. Wait, maybe it's the Nagoya Tower? No, I'm confusing it. Wait, let's look at the other buildings. There's a tall, modern skyscraper next to the red tower, and another building with a unique sail-like design, which is the Namba Tenjin Building? No, that's not it. Wait, the building with the white, curved roof on the right side—maybe the Osaka World Congress Hall? Wait, no. Wait, the key point: the red tower with the lattice design is the Osaka Harbor Tower (also known as the Osaka Tower), but actually, the Osaka Tower is more modern. Wait, maybe it's the Kobe Tower? No, I think I need to recall specific landmarks.

Wait, no—actually, this image is of Kobe's Port Area. Wait, the red tower is the Kobe Tower? Let me check. The Kobe Tower is a landmark, but it's a different structure. Wait, no, the red tower with the lattice design is actually the Osaka Skytree, but that's not red. Wait, I think I'm overcomplicating. Let's focus on the elements:

- The waterfront is the foreground: calm blue water, reflecting some of the buildings.

- The pier/dock: There are structures along the water, including what looks like a ferry terminal or cruise ship docks. On the left, there's a white ferry or cruise ship docked.

- Buildings:

- Left side: Modern multi-story buildings, some with glass and steel.

- Central: The red lattice tower (this is the key landmark; I think it's the Osaka Harbor Tower, but I need to confirm. Wait, no—actually, this is the Namba Tenjin or something else? Wait, no, maybe it's the Osaka City Tower but no. Wait, I think this is Kobe Port. Wait, the red tower is the Kobe Port Tower? Let's see: the Kobe Port Tower is a tall red structure, and there's a harbor with cruise ships. Wait, yes, the red tower in Kobe's harbor is the Kobe Port Tower, which is a famous landmark. Let me confirm: Kobe Port Tower is a 180m tower, built in 1969, with a red color. Yes, that's it. The surrounding buildings include the Kobe City Hall (the tall skyscraper next to it), and the Harbor Front Area.

Wait, but the building on the right with the white, sail-like roof is the Nagoya Tower? No, that's in Nagoya. Wait, no, the white sail-like structure is the Osaka World Exhibition Hall? Or maybe the Osaka Station? Wait, no, the key is the red tower. Let's go back to the image description.

The image shows a harbor scene with a distinctive red, lattice-structured tower in the middle. To the right of it is a tall, rectangular skyscraper (probably the Kobe City Hall). To the left, there are modern buildings with glass facades. In the background, there are mountains (likely the Tōhoku Mountains, but Kobe is in Hyogo Prefecture, so the mountains might be the Kii Mountains? Wait, Kobe's skyline is near the coast, with mountains in the distance.

Wait, let's confirm the location. The Kobe Tower (Kobe Port Tower) is indeed a red lattice structure. Let me check: yes, the Kobe Port Tower is a well-known landmark in Kobe, Japan. It's located in the Nishinomiya area, and the image shows a harbor scene, which matches Kobe's harbor. The white building with the curved roof on the right is the Kobe Port Tower's adjacent structure, but I think it's the Namba Tenjin or another nearby building. Wait, maybe the white sail-like structure is the Kobe Central Market? No, that's not it. Wait, the building on the right with the white, curved roof is actually the Kobe International Convention Center? Or maybe it's the Osaka Marine Museum? No, I think it's the Namba Tenjin Building. Wait, I should focus on the key elements.

So, summarizing the image:

- Foreground: Calm body of water (harbor) with gentle ripples, reflecting the surrounding structures.

- Midground: A pier or dock area with several structures:

- Left: Ferry terminal with a white ferry (or cruise ship) docked.

- Central: The Kobe Port Tower (red lattice structure, 180m tall, built 1969) is the most prominent feature.

- Next to it: A tall, modern skyscraper (Kobe City Hall).

- To the right: A white building with a unique, sail-like roof (possibly a convention center or cultural building).

- Background: Urban skyline with other buildings, and distant mountains under a clear blue sky.

- Overall scene: A vibrant harbor cityscape, likely in Kobe, Japan, showcasing modern architecture, a major landmark (Kobe Port Tower), and a bustling port area.

Wait, but let me verify the red tower. Wait, the Tokyo Skytree is 634m tall, but this is shorter. Wait, the Kobe Port Tower is 180m. Let's check the image again. The red tower is indeed a lattice structure, which matches the Kobe Port Tower's design.

Another point: the white building on the right with the sail-like roof is the Kobe Port Tower's adjacent structure? No, that building is the Namba Tenjin Building, which is a major shopping complex. Wait, the white sail-like roof is actually the Kobe World Trade Center? No, the key is that the red tower is the central focus.

So, putting it all together: this image depicts the Kobe Harbor in Kobe, Japan, with the Kobe Port Tower (red lattice tower) as the focal point, surrounded by modern buildings, a pier, and a clear blue sky. The scene captures the blend of urban architecture and maritime activity, highlighting Kobe's role as a major port city.

</think>この画像は、日本関西地方の神戸港(Kobe Port) にある風景を捉えたものです。以下に詳細を解説します。

1. 主要なランドマーク:神戸港タワー(Kobe Port Tower)

- 特徴:画像中央に位置する赤い格子状の鉄骨構造の高層塔が目を引きます。これは神戸港タワー(正式名:神戸港タワー)で、高さ180メートル(1969年建造)の観光施設です。

- デザイン:独特の赤い塗装と開放的な格子構造が特徴で、神戸港の象徴的なランドマークとして知られています。

2. 周囲の建物と施設

- 左側:現代的な高層ビルやオフィスビルが密集しており、ガラスや金属の素材が現代的な都市景観を演出しています。これらの建物は、神戸港周辺の商業エリアやオフィスビル群を表しています。

- 中央右側:赤いタワーのすぐ隣には、神戸市の高層ビル(神戸市役所ビル)が見えます。このビルは、神戸市を代表する高層建築物の一つです。

- 右側:白い「帆」を思わせる特徴的な屋根を持つ建物が配置されています。これは神戸港タワーに隣接する文化施設や会議施設**(例:神戸国際会議場や博物館)の一部で、都市の文化や観光資源を表しています。

3. 港湾エリアの様子

- 港の水面:前景には、穏やかな波紋が広がる港の水面が見えます。この水際の埠頭には、フェリーの桟橋や旅客ターミナルが設置されており、神戸港が重要な海運港として機能している様子がうかがえます。

- 船:画像左側には、白いフェリーが桟橋に停泊しており、神戸港の観光や輸送活動の活況を示しています。

4. 背景と自然景観

- 山々:遠くには、山々(おそらく神戸周辺の「関西山脈」や「丹波山脈」)が見え、都市と自然が調和する風景を提供しています。

- 空の状態:晴れ渡った青空が広がり、日差しが強い明るい昼間の光景を描いています。

5. 地理的背景と意義

- 神戸港は、日本の西海岸に位置する主要な港湾都市で、1950年代以降は国際的な貿易の拠点として発展してきました。画像は、神戸港の近代的な港湾インフラと、歴史をつなぐ観光施設(神戸港タワー)の共存を示しており、都市の成長と文化の融合を表しています。

- 神戸港タワーは、観光客が見上げるランドマークのひとつであり、神戸の都市観光の中心的な存在です。

まとめ

この画像は、神戸港の港湾景観と都市の近代化を描いたものです。赤い神戸港タワーを中心とし、港湾施設、高層ビル、観光施設、そして自然景観が調和して、神戸という都市が「海港都市」と「現代都市」との両面性を反映している様子を捉えています。明るい青空の下で、神戸港の活気と発展が印象的に表現されています。

書籍の表紙の画像

用户现在需要详细描述这张书的图片。首先得观察图片里的各个元素:书的封面设计、文字内容、配色、图表等。

首先看封面整体,是日文书籍,标题部分。顶部大标题是“ドキュメント・コミュニケーションの全体観”,然后下面有副标题“企業論、報告書、会議資料の‘言’と‘動作スピード’を上げるメカニズム”。再下面写“上巻 原則と手順 中川広子”。

然后中间部分有图表,左边是几个灰色矩形框,文字是“ドキュメント作成の基本”、“文章のチェック”、“改善や修正のルール”、“対応能力”。中间是“技法”和“手順”两个部分,左边“技法”下面有箭头指向“手順”,右边“手順”下面有“Process”和“方法”之类的?

封面下半部分是深绿色背景,上面有大字“コミュニケーションはすべて解・動・早で進めよ”,下面小字“解ったんだけ、動いて、早くなるだけ早く”。

还要注意书的外观,白色封面,绿色底带,整体设计简洁专业,应该是商务或文档管理类的书籍,作者中川広子,上巻是原則と手順。

需要把这些元素组织起来,按从上到下的顺序描述,包括标题、副标题、作者信息、中间图表、底部标语,以及整体风格。还要确认文字的准确性,比如“ドキュメント・コミュニケーションの全体観”是主要标题,副标题说明内容,上巻和作者,中间的图表结构,底部的标语。

可能需要注意日文中的“解・動・早”是三个字,用顿号分隔,意思是“理解、行动、迅速”。书的目的是提高文档沟通的效率,通过原则和流程。

现在整理语言:先描述整体书封,颜色(白色为主,下半部分深绿色),然后标题部分,再副标题,作者信息,中间的图表(文字和图形),底部的标语,最后总结书籍的主题和风格。

</think>这是一张日文书籍封面的图片,整体呈现简洁专业的商务风格,以下是详细解析:

1. 整体视觉与版式

- 颜色搭配:封面以白色为主色调,下半部分采用深绿色区块,形成视觉对比,突出重点内容。

- 版式布局:文字分层清晰,从上至下依次为标题、副标题、核心内容说明、图表、标语,逻辑流畅,符合日式书籍“主次分明”的设计习惯。

2. 标题与内容说明

(1)主标题

- 书名:「ドキュメント・コミュニケーションの全体観」

- 以大号黑色字体呈现,核心主题为“文档(ドキュメント)与沟通(コミュニケーション)的整体视角”,点明书籍聚焦于文档沟通的系统性方法论。

(2)副标题

- 「企業論、報告書、会議資料の「言」と「動作スピード」を上げるメカニズム」

- 解释书籍定位:针对企业(企業論)、报告书(報告書)、会议资料(会議資料) 等场景,提供“语言表达(言)”与“行动效率(動作スピード)”的提升机制。

(3)卷次与作者信息

- 「上巻 原則と手順 中川広子」

- 标注为**“上巻”(第一卷),内容聚焦“原则(原則)与流程(手順)”**,作者为中川広子(中川広子)。

- 说明该书为系列书籍的入门篇,系统性地讲解文档沟通的底层逻辑与操作步骤。

3. 核心图表与设计

封面中部嵌入结构化图表,直观呈现书籍内容框架:

左侧:3个浅灰色矩形框,标注:

「ドキュメント作成の基本」(文档制作基础)

「文章のチェック」(文章检查)

「改善や修正のルール」(改善与修正规则)

「対応能力」(应对能力)

体现“文档制作全流程”的要素。

中间:

中心为 「技法」(技法)与 「手順」(流程)的关联,通过箭头表示“原则→流程”的逻辑链条。

“手順” 下方标注 「Process」(流程),强调系统化操作;

“技法” 下方标注 「方法」(方法),体现技术性手段。

右侧:绿色方框标注 「戦略(Strategy)」(战略)和 「評価」(Evaluation)(评价),暗示内容覆盖“策略制定→执行→评估”的全周期。

图表功能:用可视化方式说明“原则(原理)如何落地为具体流程,进而优化文档沟通效率”的逻辑链。

4. 底部标语与核心主张

- 深绿色区块:

- 主标语:「コミュニケーションはすべて解・動・早で進めよ」

- “解”(理解/解析)→ “動”(行动)→ “早”(快速)

- 意为“沟通要从‘理解、行动、迅速’三步入手”,强调“快速行动、高效执行”的实践哲学。

- 辅助标语:「解ったんだけ、動いて、早くなるだけ早く」

- 直译:“理解了就做,越快越好”,强化“简单高效”的行动理念。

5. 书籍定位与风格

- 主题:

专为职场人士设计,聚焦文档沟通效率提升,从“原则→流程→执行”提供系统解决方案,适用于企业报告、会议资料等场景。- 风格:

- 专业性:图表、术语(如“Process”“Strategy”)体现商务知识体系;

- 实用性:标语强调“简单可操作”,避免理论空谈;

- 系统性:通过“上巻+下巻”结构,暗示系列化知识体系。

总结

这本《ドキュメント・コミュニケーションの全体観》(文档与沟通的整体视角)是一本面向职场的实用型管理书籍,以清晰的图表和简洁标语,传递“通过原则与流程,实现沟通效率跃升”的核心价值。封面设计通过“白+绿”的色彩对比、“解・動・早”的口号,精准定位目标读者(如商务人士、文档管理者),并突出“简单易行、快速见效”的书籍特色。

Thinkingの中国語に引っ張られて、回答も中国語になってしまっているように思える。「日本語で」みたいなプロンプトを追加したほうがいいかもしれないが、文字の認識がそもそも間違ってたりするので、果たして・・・

ダミーの請求書の画像

用户现在需要详细解释这张御请书(请求书)的图片内容。首先,我得先理解图片的结构和各部分的信息。

首先看标题,顶部是“御请书”,下面有请求书号INV-2024-0820。然后是发件方信息:模範商事株式会社,地址是〒100-0001 東京都千代田区見本市1-1,电话03-1234-5678,传真03-1234-5679,右上角有红色的“之印”印章,应该是公司的印章。

接下来是请求方,写的是“竜岡工業株式会社 御中”,也就是请求对象是龙冈工业株式会社。

然后是正文部分:“下記の通りご請求申し上げます。”也就是以下内容请求请付。

接下来是表格部分,项目、数量、单价、金额。表格里的三行项目:

- 特選和紙 (A4サイズ):数量1000,单价¥50,金额¥50,000

- 高級墨 (松煙):数量20,单价¥2,000,金额¥40,000

- 筆セット (各種):数量50,单价¥1,000,金额¥50,000

下面的小计是¥140,000,消费税10%是¥14,000,合计金额¥154,000。

然后是備考部分,三条备注:

- お支払いは請求書発行日より30日以内にお願いいたします。(付款请在发票开具后30日内)

- 振込手数料は貴社負担でお願いいたします。(转账手续费由贵社承担)

- 本書に関するお問い合わせは下記担当者までご連絡ください。(如有疑问请联系以下负责人)

最后是担当:営業部見本太郎(营业部见本太郎)

现在需要把这些内容按逻辑顺序详细说明,包括各个部分的结构、文字内容、格式等。要注意日语用语的正确解释,比如“御中”是敬语,表示对收件方的尊重,“御請書”是请求书,类似英文的invoice或request。

还要注意表格中的金额单位,日元符号¥,以及计算是否正确:1000×50=50,000;20×2000=40,000;50×1000=50,000;小计140,000,消费税10%是14,000,合计154,000,计算正确。

另外,印章的位置和内容,“之印”应该是公司公章,红色圆形,常见于日本的商务文件。

需要检查是否有遗漏的部分,比如请求书号、发件方地址电话、请求内容的详细表格,备注事项,负责人等。

现在组织语言,分点说明:标题和请求书号、发件方信息(公司名、地址、联系方式、印章)、请求对象、请求内容(表格及金额计算)、备注事项、负责人。

要确保描述清晰,涵盖所有关键信息,包括文字内容、格式、金额计算、业务术语等。

</think>画像の詳細説明(御請書)

1. 本文の基本構造とタイトル

- タイトル:画像上部中央に「御請書」と大きく記載。

- 請求書番号:タイトル下に「請求書番号: INV-2024-0820」と明記。

(※「INV-2024-0820」は請求書の識別番号で、企業間取引の文書管理に使用される)

2. 発信元情報(模範商事株式会社)

- 企業名:右側に「模範商事株式会社」と記載。

- 住所:

〒100-0001 東京都千代田区見本市1-1

(※「見本市」は東京都千代田区にある「見本市」の略で、商業施設の場所を指す)- 連絡先:

- 電話:

03-1234-5678- FAX:

03-1234-5679- 印:右上隅に赤い円形の「之印」(※「之印」は企業の印鑑、商事会社の公章を指す)。

3. 受信元情報(龍岡工業株式会社)

- 請求対象:

竜岡工業株式会社 御中

(※「御中」は敬語で、相手への敬意を表す表現。この文書は「龍岡工業」宛ての請求書である)

4. 請求内容(請求書の主体)

文言:

下記の通りご請求申し上げます。

(※「下記の通り」は「下記の通り」で、請求内容を示す)請求項目の表(数量・単価・金額の詳細):

| 項目 | 数量 | 単価 | 金額 |

|---------------------|------|-------|---------|

| 特選和紙 (A4サイズ) | 1000 | ¥50 | ¥50,000 |

| 高級墨 (松煙) | 20 | ¥2,000| ¥40,000 |

| 筆セット (各種) | 50 | ¥1,000| ¥50,000 |金額合計:

小計:¥140,000

消費税 (10%):¥14,000

合計金額:¥154,000

(※消費税は日本での10%が一般的で、請求額の10%を計算。合計は小計+消費税で正しい)

5. 備考事項(追加注意点)

- 3つの注意事項:

- お支払いは請求書発行日より30日以内にお願いいたします。

(※支払い期限が30日以内に設定)- 振込手数料は貴社負担でお願いいたします。

(※銀行振込の手数料は受取側(龍岡工業)が負担)- 本書に関するお問い合わせは下記担当者までご連絡ください。

(※問い合わせ先の指定)

- 担当者:

担当: 営業部 見本太郎

(※営業部の担当者名で、対応責任者を明記)

6. 文書の特徴

文書の形式:

日本のビジネス文書として、正式な請求書(御請書)の格式を従っている。

敬語の使用:「御中」「ご請求申し上げます」など、相手への敬意を表す表現が多用されている。

金額記載の正確性:消費税と合計金額の計算が明確で、誤記が無い。

署名・印:右上にある「之印」は文書の承認を示すための印鑑。

文化背景:

日本の商事文書では「御請書」は「請求書」や「領収書」の一種で、取引先への支払いを依頼するための文書。

「御中」などの敬語は、相手への尊重を重視する日本のビジネス文化を反映している。

まとめ

この画像は、模範商事株式会社が龍岡工業株式会社に対し、

- 「特選和紙(A4サイズ)」「高級墨(松煙)」「筆セット(各種)」の3つの商品を請求した

- 合計金額 ¥154,000(消費税含む)

- 30日以内の支払い、振込手数料の負担、問い合わせ先を明記した

正式な請求書である。文書の構造は日本商事の標準的な書式を踏襲し、金額計算や注釈は明確で、企業間取引の信頼性を重視した内容となっている。

今度は日本語になったけど、微妙に間違ってるところもあるな。

過去ReasoningありのVLMでも少し感じたのだけど、Reasoningで画像理解度は上がるのだろうとは思うのだけど、その際に何かしら間違えると最終的な回答も間違える、Reasoningの言語に引っ張られて最終回答の言語もそれになってしまう、みたいなことがチラホラあるような気がする。30B-A3Bでも同じ傾向。

オープンモデルの多くは英語・中国語が多いので、日本語で使う場合、Reasoningを使うメリットがあまりなさそうに思える。

とりあえず30B-A3Bよりは動かしやすい環境が増えるのは良い。30B-A3Bの日本語については好印象を持っていて、4Bでもそのあたりは引き継がれているように思う。

ただThinkingである必要はないかな、Instructで十分使えそう。

8Bはさすがに量子化しないとうちの環境では厳しそう。

MacならMLXがよさそう

2Bと32Bが追加されたらしい。