Closed1

ComfyUIでSDXLを試してみる

- StableDiffusion用のUI

- ノードベースでパイプラインを作って処理を行う

というものらしい。

stable-diffusion-web-uiでのSDXLサポートがまだ足りないようで、こちらが使われている記事などをちらほら見かけたので、試してみた。(ComfyUI自体はSD1.X/2.Xにも対応している)

インストール

pyenv-virtualenvのpython-3.10.11でやってみる。

$ pyenv virtualenv 3.10.11 ComfyUI

$ git clone https://github.com/comfyanonymous/ComfyUI && cd ComfyUI

$ pyenv local ComfyUI

$ pip install torch torchvision torchaudio --extra-index-url https://download.pytorch.org/whl/cu118 xformers

$ pip install -r requirements.txt

モデルをそれぞれダウンロードして所定のパスに置く。

-

sd_xl_base_1.0.safetensorsをmodels/checkpointsディレクトリに

-

sd_xl_refiner_1.0.safetensorsをmodels/checkpointsディレクトリに

-

sdxl_vae.safetensorsをmodels/vaeディレクトリに

起動。うちの場合はLAN内のサーバで動かしているので--listenオプションをつけないとアクセスできない。(デフォルトは127.0.0.1のみ)

$ python main.py --listen

こんな感じで立ち上がる。

ざっと見てみると、

-

モデル

sd_xl_base_1.0.safetensors

-

ポジティブプロンプト

beautiful scenery nature glass bottle landscape, , purple galaxy bottle,

-

ネガティブプロンプト

text, watermark

-

シードなどの設定は以下キャプチャ参照

-

VAEは選択されていない模様

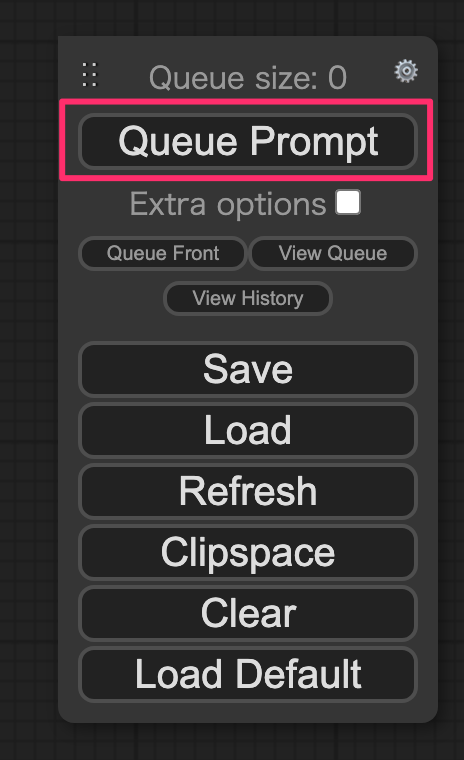

という感じ。では生成してみる。"Queue prompt"をクリック。

最後のところに画像が生成されていればOK。

SDXLの特徴の一つっぽいrefinerを使うには、それを使うようなフローを作る必要がある。

以下のサイトで公開されているrefiner_v1.0.jsonを使わせていただく。それ以外にもSDXLの概要、Colaboratoryでの動かし方、ComfyUIの操作についてとてもわかりやすい説明がされていたので、参考になる。

でこんな感じになった。

Twitter(Xだっけか、今は)を見てると、フローのキャプチャを紹介してる人がいるけど、昔のシンセ感があって面白い。

このスクラップは2023/07/31にクローズされました