Open13

[Google I/O 2022 メモ]What's new in Google AR

- ARCoreとは何か

- 過去1年間に行った改善点

- 新機能

について説明する

Introduction to ARCore

- ARCoreは、AndroidとiOS両方で、AR体験を構築するためのGoogleのプラットフォーム

- 拡張現実(AR)は、完全に仮想的なオブジェクトを、現実世界に配置できるようにするテクノロジー

- 仮想オブジェクトはカメラ画像上に描画され、実際にそこにあるかのように溶け込む

- ARによって、情報をより自然で人間的な方法で表示できる

- ARを有効にする様々な機能がある

- これらをすべてARCore Skill Treeにグループ化する

- 2017の発表以来、着実にレベルアップし、新機能を追加してきた

- ARCoreは12億を超えるアクティブなAndroidデバイスで利用でき、一部の機能はiOSでも利用できる

- iPhone6s以降をサポートしている

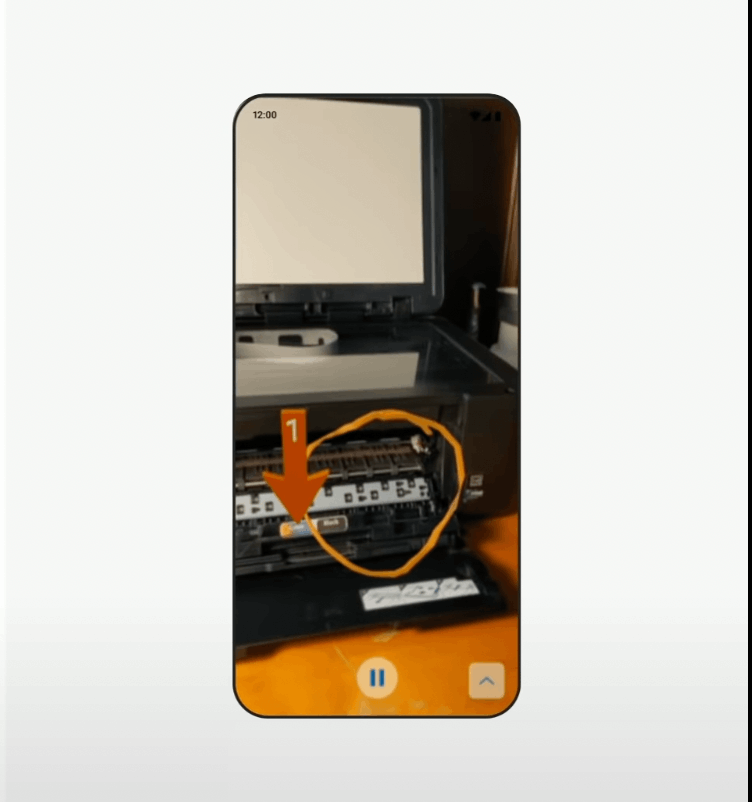

- ARは、徒歩ナビ用のGoogleMap等のGoogleコアアプリや、リモートARアシスタンスのTeamViewerのようなサードパーティで使用されている

Foundational Improvements

- 開発者からの重要なリクエストは、オブジェクトをより速く、より信頼できるものに感じさせる、コア機能を望んでいるということ

- 現実世界では、頭を向けたときに、モノがグリッチしたり存在しなくなったりすることはない

- ユーザーは、ARの仮想オブジェクトにも同じことを期待する

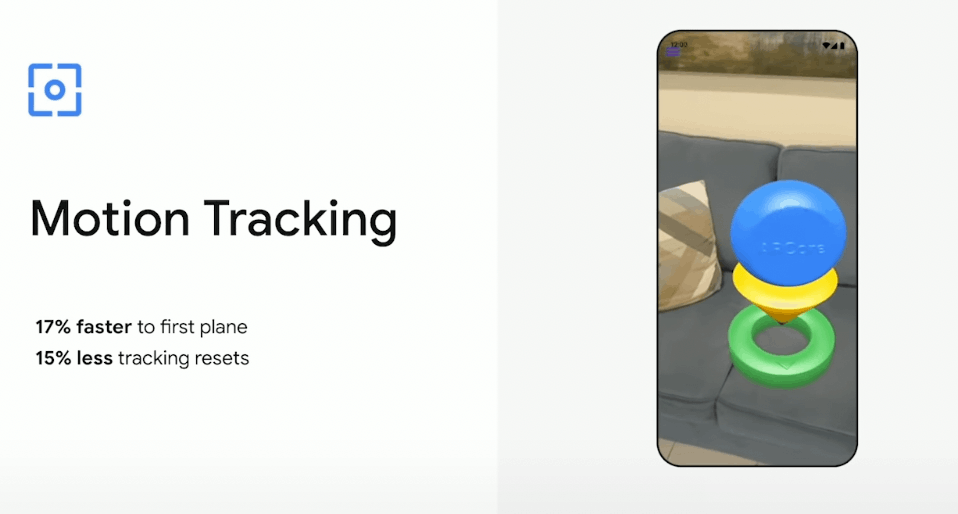

Motion Tracking

- Motion Trackingは、AR体験に没頭できるようにするための、コア機能

- デバイスが世界をどのように移動するか、床/テーブル/壁がどこにあるかをトラッキングすることで、アプリはそれらの表面にオブジェクトを配置し、固定することができる

- 過去1年間で、Motion Trackingに大幅な改善を加えた

- Motion Trackingの起動と検出にかかる時間を17%短縮した

- Motion Trackingが失われる時間を15%短縮した

- ARCoreアプリでコードの修正なく、速さ、信頼性を高めることができる

Motion Tracking + Machine Learning

- 昨年末、カメラの画像が十分でない場合に、MLを使用してMotion Trackingを駆動する実験を開始した

- これによって、初期化が高速化され、Motion Trackingが失われる回数をさらに減少させた

- 画面がまっくらになっても、Motion Trackingを適切に継続することができる

Depth

- 深さ、はAR体験が現実成果とより多くの相互作用を持つことを可能にする

- スマホの既存カメラを利用して、深度マップを作成する

- 深度マップは、大きな部屋と同じくらいの8mまでの世界の形状をキャプチャする

- これにより可能になることの1つは、仮想オブジェクトが実際のオブジェクトの背後に表示される、オクルージョン

- これにより、インタラクションも可能になり、仮想オブジェクトが現実世界の表面の非平面形状に追従できるようになる

Depth + Machine Learning

- ここでもMLを利用して、深度の速度とカバレッジを改善した

- 白い壁と、黒のテレビ部分では、劇的に改善している

- これらは、視覚的な特徴がないために、古典的な方法では苦労する箇所である

- Depthカバレッジは、専用のDepthハードウェアのカバレッジ量に匹敵するようになった

Depth + Machine Learning + Dual Camera

- 一部のPixelスマートフォンでは、2台目のカメラを使用して、深度測定をさらに速くすることができる

- バッテリーの影響は最小限に抑えられている

- 現在Pixel4とPixel6で展開されている

Long Range Depth

- 長距離深度がリリースされた

- 長距離深度では20mの範囲まで深度を検出できる

- この範囲の拡大により、屋内だけでなく、屋外でも使用できるようになった

- 直射日光下でも、屋外でのオクルージョンが可能になった

- GoogleMapでは、屋外でのオクルージョン体験が展開されている

New Cloud Services

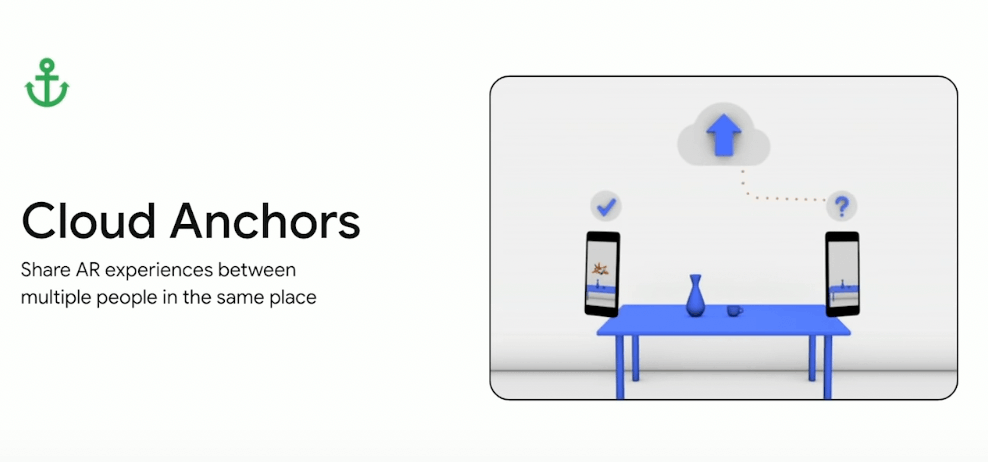

Cloud Anchors

- 2018年には、複数のユーザーが、1つのAR体験を同時に共有できるようにする、Cloud Anchorsをリリースした

- 2020年には、最大1年間持続する、永続的なCloud Anchorsをフォローアップした

- Cloud Anchorsを使用すると、複数のユーザーが表示/共有できる、リッチで永続的なARコンテンツを構築できる

- Cloud Anchorsは、直接その場所に立ち会うことのできる、部屋規模のAR体験に最適

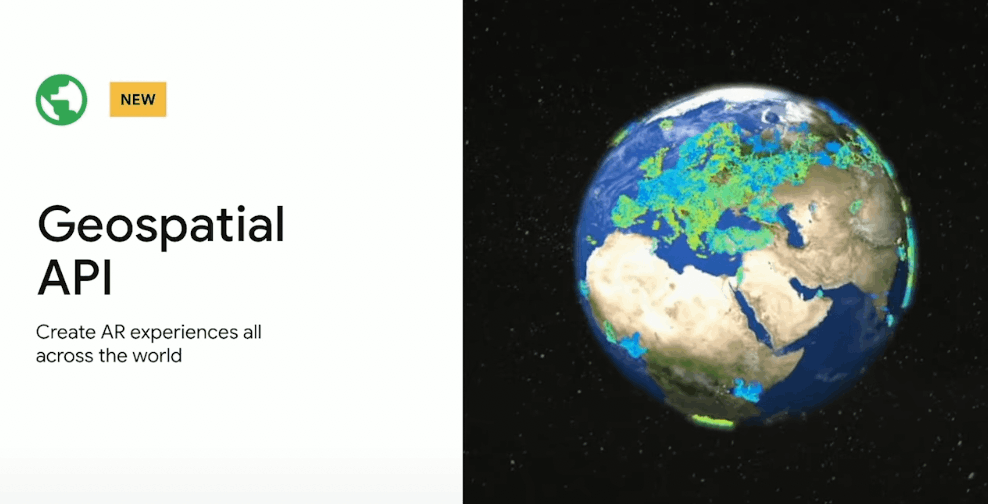

Geospatial API

- 世界規模のAR体験が求められていた

- ARCore Geospatial APIの最初のセットをリリースする

- これにより、AndroidとiOSの両方で、世界規模の共有AR体験を可能にすることができる

- Geospatial APIを使用すると、ARアプリは、GPSセンサーが提供できるよりも高い精度で、デバイスの緯度経度、高度、方位を計算できるようになる

- これにより、仮想オブジェクトの地理空間(Geospatial)アンカーを配置することができる

- 地理空間アンカーは、特定のGPS座標に関連付けられている

- そのため、そこに行かなくても、世界中のどこにでも配置できる

- これは、VPS、ストリートビュー、MachineLearningを組み合わせた、Googleのグローバルローカリゼーション技術を利用している

- したがって、世界中で機能する

- GoogleMapの徒歩ナビのライブビューと同じテクノロジーを使用している

Geospatial APIの使い方

- この日時計のすぐ隣にある自宅近くの公園で、仮想オブジェクトを使った体験を作りたい

- アンカーの正確な緯度経度、高度を把握する必要がある

- GoogleMapを利用して、デスクから行うことができる

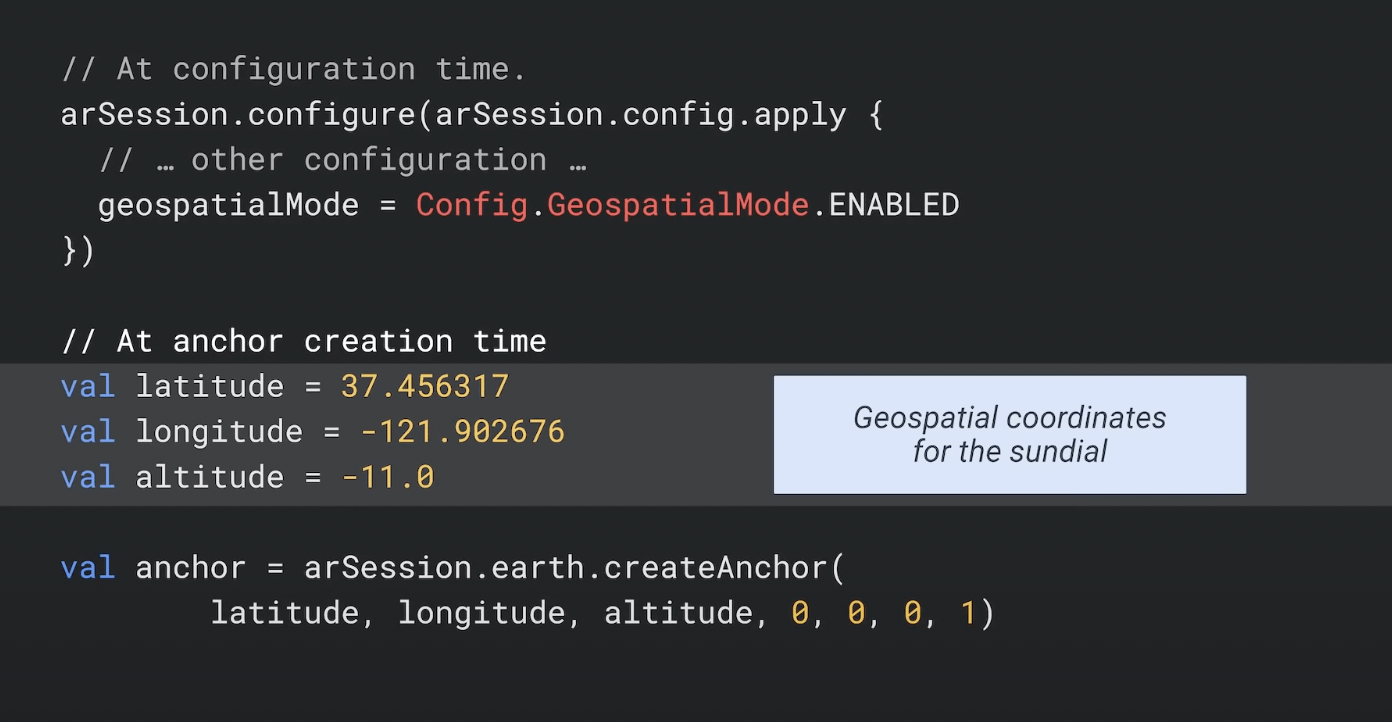

- これが日時計の地理空間座標

- ARCoreセッションを構成する時は、必ずGeospatial APIを有効にするようにする。ARを開始する前に一回だけ実行するようにする。

- ユーザーがARに入ると、日時計の座標をearth.createAnchorに渡して、地理空間アンカーを作成する

- 完了!

- Geospatial APIを利用するとAndroidとiOSのどこにいてもロケーションベースの仮想オブジェクトを使用できる

- これらはすべて、各場所をマップすることなくできるため、絶えず進化する動的仮想オブジェクトを、現実世界に追加することができる

- 詳しく知りたい場合は、トーク「VPS and ARCore Geospatial API」を見てください