Open6

GPU on Dev Container

こんな簡単に導入できるって本当か?

NVIDIA Container Toolkit とか導入しなくていいんだろうか?

本当に認識した!:

{

"name": "PyTorch",

"image": "nvidia/cuda:12.5.0-devel-ubuntu22.04",

"runArgs": [

"--gpus",

"all"

]

}

この問題が起きていた!

Docker Desktop をアップデートすることで解決

どうやら本当にこれだけの操作で GPU が利用できそう

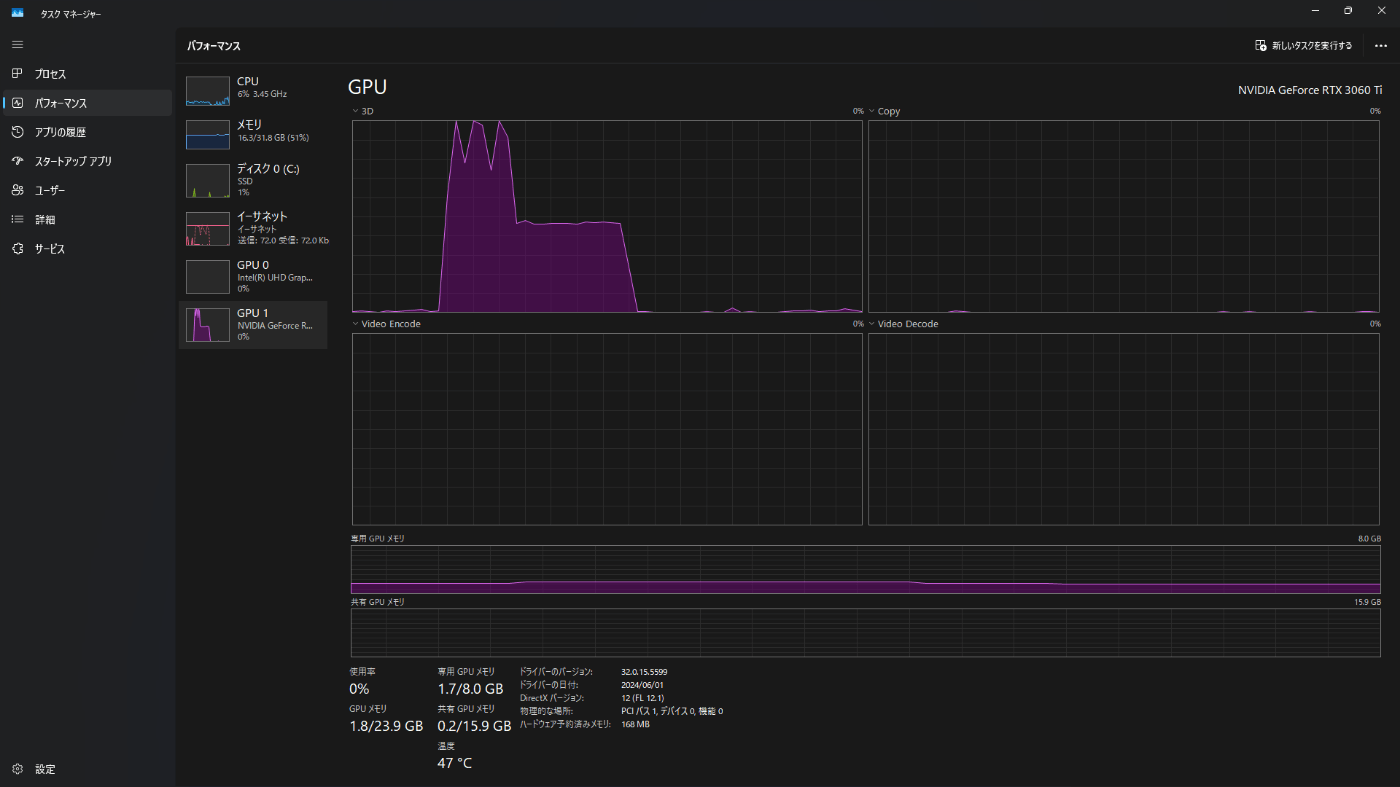

ちゃんと GPU リソースを消費していることを確認

ためしに CPU と GPU の処理時間を比較してみる

ChatGPU に作ってもらった適当な機械学習タスクを用いる

GPU (NVIDIA RTX 3060 Ti)

real 0m23.269s

user 0m22.872s

sys 0m2.281s

CPU (Intel Core i7 12700K)

real 1m27.872s

user 13m16.561s

sys 1m3.700s

user, sys はそもそも CPU の代わりに GPU を使っているので GPU のほうが小さくなるのは当然だ.比較する意味がない.

注目すべきは real のみで,これが 4 倍程度差が出ている.大きなタスクになれば重要性が増すとは思うが,まぁ CPU しかないからと言って全く機械学習ができないというわけではないことがわかる.