【速報レポート】NVIDIA GTC 2025 Jensen Huang CEOの Keynote まとめ

~AIファクトリー時代の幕開けと次世代GPU「Blackwell」~

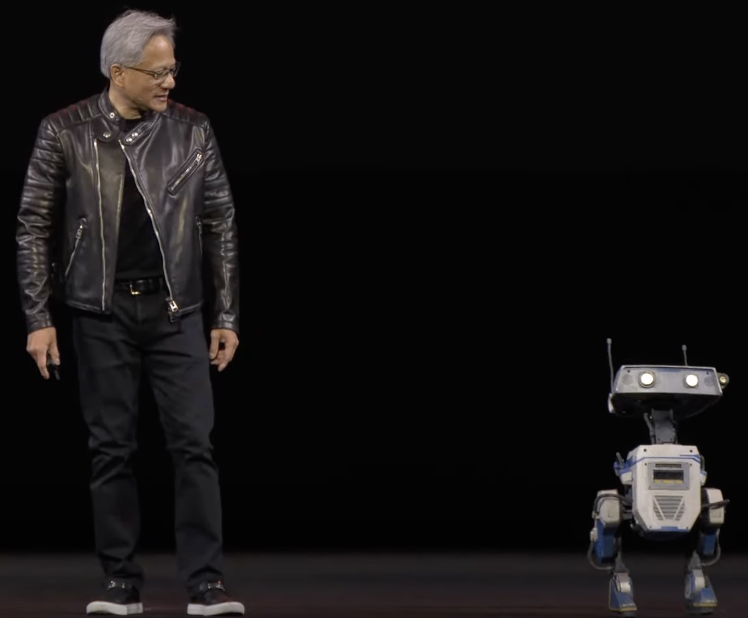

こんにちは。今回はNVIDIAの「GTC 2025」カンファレンスの基調講演(Keynote)で発表された主なトピックを、速報レポートとしてまとめてみました。NVIDIA CEO ジェンスン・フアン氏のキーノートはいつも革新的な話題が満載で、AIやGPUに関わるエンジニアにとっては見逃せないイベントですよね。

今年のGTCも例外ではなく、次世代GPUアーキテクチャ「Blackwell」や、新しいAIインフラストラクチャの進化、ロボティクスやメタバース(Omniverse)関連の発表が盛りだくさんでした。この記事では、重要ポイントをざっくり全体像から掘り下げてご紹介します。

KeynoteのYoutube動画はこちらからご覧いただけます。

1. はじめに:GTCとは?

「GTC (GPU Technology Conference)」は、NVIDIAが主催する年次のテクノロジーカンファレンスです。GPUやAI分野の最新動向が発表される場として非常に注目されており、最近ではAIを使ったソリューションの事例や、データセンター向けの新技術、ロボティクスやメタバース(仮想空間)関連など、幅広い分野をカバーしています。

2025年のGTCではジェンスン・フアンCEOが基調講演に登壇し、最新アーキテクチャのGPUやソフトウェアスタック、企業向けの新サービスなどを大量に発表しました。参加企業やパートナーもますます拡大しており、AIの爆発的な需要を背景に、NVIDIAが業界をどのようにリードしようとしているのかが示されています。

2. 基調講演の全体ハイライト

2025年のGTCでジェンスン・フアン氏が特に強調していたのは、「AIファクトリー」と呼ばれる概念です。生成AIや推論AIの大規模化が進む今、世界中のデータセンターは従来のCPU中心設計から「GPUアクセラレーテッドコンピューティング」へシフトしつつあり、NVIDIAはそこを“第2の産業革命”と捉えています。

-

AI需要の急拡大

大規模言語モデルや生成AIが引き起こす推論需要は、これまでのサーバー投資を根底から変えるほど急激に拡大。フアン氏いわく「1兆ドル規模の転換点」とのこと。 -

次世代GPUアーキテクチャ「Blackwell」

Hopper世代に続く新アーキテクチャ。消費電力あたりの性能を大幅に向上させ、Hopperに比べ最大40倍の効率向上を狙っているそうです(詳細は後述)。 -

AIインフラ毎年アップデート宣言

NVIDIAは今後1年ごとにGPUやCPUをアップデートしていく年間ロードマップを打ち出しています。さらに「Blackwell」の次として「Vera Rubin」というネーミングまで示されるなど、先を見据えた開発計画が発表されました。 -

ロボティクス・Physical AIの拡大

人手不足や産業高度化に伴い、物理空間で動くAI(ロボット)の潜在需要が巨大化。NVIDIAはIsaacプラットフォームやOmniverseを通じて、この分野を大きく取りにいく姿勢を強調しました。

「次の10年はクラウド、エッジ、物理空間を含め、すべての場所でAIが中心になる」というメッセージが全体を通して語られた印象です。

忙しい人用にKeynoteまとめスライド(made by 生成AI)

免責事項

本資料は生成AIを使用して作成されたものであり、内容の正確性、完全性、最新性、および有用性を保証するものではありません。本資料に記載されている情報、製品仕様、価格、発表内容などは実際のものとは異なる場合があります。公式情報については、必ずNVIDIA社の公式ウェブサイトまたは公式ドキュメントをご確認ください。本資料の使用によって生じたいかなる損害(直接的、間接的、偶発的、結果的損害を含む)に対しても、作成者は一切の責任を負いません。本資料を業務判断や意思決定の唯一の根拠として使用することはお控えください。実際のビジネス判断を行う際は、必ず公式の情報源からの確認と専門家の助言を得ることをお勧めします。

3. 次世代GPUアーキテクチャ「Blackwell」

3.1 Blackwellとは?

今回のGTCで最も注目度が高かったのが、新しいGPUアーキテクチャ「Blackwell」です。前世代の「Hopper」から大きく性能と効率が伸びているのが特徴。中でも注目は、以下のポイントです。

-

FP4精度演算への最適化

Blackwellは非常に低精度な浮動小数点演算(FP4など)を強化し、電力当たりの演算性能を高めています。 -

40倍以上の性能向上(条件による)

大規模言語モデルなどの推論にはとくに威力を発揮し、消費電力を同等に抑えつつ、Hopper世代比で圧倒的な処理能力をアピールしています。

3.2 Blackwell Ultraとロードマップ

さらに、2025年後半には「Blackwell Ultra」が出てくるとのこと。これは1.1エクサフロップス(FP4精度)を超える性能を持ち、メモリ帯域やネットワーク性能も大幅に強化されるといいます。NVIDIAはこれを皮切りに、以下のような年間ロードマップを打ち出しています。

- 2025年:Blackwell Ultra

- 2026年:「Vera Rubin」(CPU「Vera」とGPU「Rubin」の組み合わせ)

- 2027年:Rubin Ultra

- 2028年:Feynman など

このように次々と新アーキテクチャを投入していく計画を明言しており、「1年ごとに確実に進化したGPUを手に入れられる」という姿勢が明確になっています。

3.3 AI推論向け新ライブラリ:NVIDIA Dynamo

Blackwellの性能をフルに引き出すため、NVIDIAは新たに「Dynamo」というオープンソース推論最適化ライブラリを発表しました。大規模言語モデルなどで必要となる高度な推論アルゴリズムを効率化し、数倍~数十倍の速度向上が期待できるとのこと。

DynamoはTransformerベースのモデルを中心にチューニングされており、Blackwell+Dynamoの組み合わせで「同じ電力枠で25倍以上の処理が可能になる」と報告されています。

4. AI向けハードウェア&ソフトウェアの進化

4.1 Grace CPUとスーパーチップ構成

GPUだけでなく、NVIDIA独自のArmベースCPU「Grace」も、Hopper/Blackwell世代との組み合わせでますます存在感を増しています。Grace Hopper(GH200)やGrace Blackwell(GB200)といったスーパーチップ構成により、CPUとGPUを同一基板上で緊密に接続。メモリやキャッシュを高速でやり取りできるのが強みです。

今後は以下のように毎年Grace CPUをアップデートし、次世代CPU「Vera」との連携も視野に入れています。こうした高速CPU×GPU構成は、大規模AIトレーニングのみならず推論やデータベース処理など様々な分野で効果を発揮しそうです。

4.2 CUDAエコシステム

ソフトウェア面では、やはりCUDAの進化が止まりません。AI以外の科学技術計算向けライブラリ(CUDA-X)も拡充され、ロボティクス、通信、最適化など、多岐にわたる用途でGPUを活用できるようになっています。

新キーワードとしては、前述のDynamoに加え、最適化ライブラリcuOptのオープンソース化など、より幅広い開発者コミュニティが参加できる取り組みが目立ちます。AI業界の“標準インフラ”としてのCUDAプラットフォームがさらに大きくなりそうです。

4.3 大規模言語モデル「NVIDIA Llama Nemotron」

Meta社のLlama 2をベースとしつつNVIDIAが独自拡張した「NVIDIA Llama Nemotron」も話題を集めました。Nemotronは複雑な意思決定やマルチステップ推論に強いとされ、生成AIをビジネス用途に落とし込むための「ベースモデル(ファウンデーションモデル)」としての役割を担います。

NemotronファミリーはエージェントAI向け機能を強化しているとのことで、OpenAIのモデルなどとはまた違う方向性の発展が期待されています。

5. データセンター技術のアップデート

5.1 シリコンフォトニクスによるネットワーク刷新

NVIDIAはMellanox買収以降、ネットワーキング技術にも力を入れており、今回のGTCでもシリコンフォトニクスを活用した「Spectrum-X」「Quantum-X」という新世代スイッチを披露しました。光通信を積極的に採用することで、

- レーザー数の削減(低コスト&省電力化)

- 信号品質の向上(多ノード連携でも高速通信)

- 大規模クラスタでのスケールアウト対応

などを達成し、数百万台のGPUクラスタを前提とした“AIファクトリー”の構築を可能にするとのこと。高速ネットワークがボトルネックになりつつある現状に、大きなインパクトを与えそうです。

5.2 NVLink拡張「NVL72」

GPU同士をつなぐNVLinkも改良され、「NVL72」と呼ばれるスケーラブル構成が登場しています。名前の通り72基のGPUを単一の大きな計算ドメインとして扱える仕組みで、大規模クラスタの構築がさらに容易に。

このNVL72とBlackwellが組み合わさることで「Hopper世代の40倍の推論性能」「推論あたりの電力コスト削減」などが期待されるそうです。

5.3 DGX SuperPOD & 新DGXシリーズ

NVIDIAが展開する完成品GPUサーバー「DGX」シリーズもアップデート。個人向けワークステーションに近いコンパクトモデル「DGX Spark」や「DGX Station」など、デスクサイドでAI研究ができる製品も紹介されました。

企業向けにはラック単位で大規模クラスタを組める「DGX SuperPOD」の新モデルがBlackwell Ultra対応で登場します。いわゆる「箱から出してすぐAI工場」を実現するためのオールインワンソリューションとして、ベンダー各社から提供されるようです。

6. ロボティクス&Omniverse関連の新発表

6.1 ロボティクス時代の到来

GTC 2025では、ロボティクス(Physical AI)に関する話題も多く取り上げられました。ジェンスン・フアン氏は「ロボット産業は次の10兆ドル市場」と力説し、少子高齢化や人手不足などが深刻化する中で、ロボット技術が社会を支える重要な基盤になると語りました。

NVIDIAのIsaacプラットフォームはロボットの開発・学習・推論・運用を一括してサポートするフルスタック構成で、今回のGTCではこのIsaacを活用した人型ロボット用ファウンデーションモデル「NVIDIA Isaac GR00T N1」が公開されました。GR00T N1は汎用的なロボット知能を実現する土台として機能し、異なる形状のロボットにも適応しやすいのが特徴とされています。

6.2 OmniverseとCosmos

OmniverseはNVIDIAが展開する3Dシミュレーション&コラボレーションプラットフォームです。工場や都市などのデジタルツインを構築し、仮想空間上で共同作業・検証ができるのが特徴。そこに、今回「NVIDIA Cosmos」という物理AI向けワールド生成プラットフォームが加わりました。

Cosmosは無数のシミュレーション環境を自由に作り出せるため、ロボットや物理空間用AIを"仮想空間で鍛え上げる"ことが簡単にできます。自動運転や製造業、倉庫管理など、実機でのテストが難しい領域でも仮想でトレーニングを完了させられるのがポイントです。

Omniverseは将来的にはデータセンターのデジタルツインにも適用され、AIファクトリーを仮想環境で設計・最適化する取り組みが進むとのこと。実際に建築する前に物理的な動線や冷却効率を検証し、最適解を導くというビジョンが示されました。

7. 主要パートナーシップ・コラボレーション動向

NVIDIAは幅広い業界との提携も積極的に発表しています。いくつかピックアップしてご紹介します。

-

自動車業界:

GM(General Motors)との包括提携が発表され、次世代自動運転車両やスマート製造ラインの共同開発を推進。 -

通信業界:

5G/6G時代を見据えて、NTTドコモやエリクソンなどとAIネイティブな無線ネットワークの標準化に着手。基地局にGPU/DPUが搭載される未来も遠くないかも。 -

クラウドAI:

Alphabet(Google)との大型協業を開始し、エージェントAIやロボティクス、医療など様々な領域で共同研究を加速。 -

医療・ヘルスケア:

GE HealthCareやEpic、その他医療向けソリューション企業と連携し、医用画像解析や手術支援などにNVIDIAのAIプラットフォームを活用。 -

Oracle Cloudとの連携:

大規模LLM推論や企業向けのAIアプリ提供を念頭に置き、NVIDIAのDGX CloudリソースをOracle Cloudに統合し、手軽にGPUパワーを利用できるソリューションを展開。

これらの動きから見ても、NVIDIAの戦略が「GPUを売る会社」から「AI&ロボティクスのインフラ企業」へと大きく進化しているのが伝わります。

8. まとめと今後の展望

今回のNVIDIA GTC 2025では、「Blackwell」という大きなGPUアーキテクチャの飛躍、そしてそれを取り巻くAIソフトウェアスタック、データセンターソリューション、ロボティクスやメタバース対応などが一斉に発表されました。キーワードとして際立っているのは、やはりAIファクトリーとエージェントAIの台頭です。

-

AIファクトリー

大規模な生成AI・推論AIを支える新時代のデータセンター。NVIDIAは毎年GPUとCPUをアップデートし、クラウド~エッジ~ロボットまで全方位をカバーするインフラを提供すると宣言。 -

エージェントAI

単なる生成AIを超えて、タスクを自律的に遂行できる「エージェントAI」。大規模言語モデルの推論性能が鍵となり、Blackwell+Dynamoなどの最適化技術が必須に。

ロボティクスやOmniverse関連の発表も多く、ハードウェアとソフトウェアの垣根がますます薄れてきていますね。NVIDIAはチップ(GPU)だけでなく、ネットワークスイッチからロボットの基盤ソフト、仮想空間プラットフォームに至るまで包括的に手がける体制を整えている点が非常に強力です。

今年はBlackwellの投入がいよいよ始まるタイミングでもあり、クラウドベンダー各社の導入スピード次第で、世界中のAI研究や開発現場が大きく変わっていく可能性があります。また、ベンチャー企業の支援策(DGX Cloudクレジットなど)も拡充されているため、スタートアップが高速GPU環境を手軽に使い始める流れも加速しそうです。

今後の注目ポイント

-

Blackwell Ultraの実際のスペックとリリース時期

2025年後半に登場予定とのことですが、どの程度量産が進み、どれだけクラウド事業者が取り入れるか? -

Grace CPU後継「Vera」の性能

2026年予定のVera Rubinアーキテクチャ。ArmベースCPUの高速化がどこまで進むか楽しみです。 -

ロボットファウンデーションモデルの浸透度

Isaac GR00T N1などが実際にどれくらいのスピードで産業用ロボットに普及するのか注目。 -

Omniverse+Cosmosの産業応用

デジタルツイン技術が本格的に普及するのか? ここ2~3年で大きく動きが出るかもしれません。 -

競合他社の動向

AMDやIntel、QualcommなどがAI向けGPU/アクセラレータを出している中で、NVIDIAの優位性が維持されるのかどうか。

9. 参考リンク

- NVIDIA GTC 2025 Keynote Live Blog(公式)

- NVIDIA Newsroom: GTC 2025 Press Releases

- ServeTheHome: NVIDIA GTC 2025 Keynote Coverage

おわりに

いかがでしたでしょうか? GTC 2025はとにかく盛り沢山な内容で、NVIDIAの総合的な戦略やビジョンが一気に明確になった気がします。新GPU「Blackwell」のインパクトはもちろん、ロボティクスのフルスタックソリューションやOmniverseの進化、さらには自動車・医療・通信など多彩な業種とのコラボが加速しているのが印象的でした。

今後もNVIDIAや関連企業がどのようなアップデートを行っていくのか、ますます目が離せません。みなさんもぜひGTC関連の公式発表やデモ動画などをチェックしてみてください。この記事が、少しでも情報整理の参考になれば幸いです。

免責事項

この記事は速報レポートのため、内容はGTC 2025時点での公表情報に基づきます。実際の製品仕様や提供時期等は変更の可能性もあるので、最新情報は必ず公式サイトでご確認ください。本記事は情報提供を目的としており、2025年3月20日時点の情報に基づいています。繰り返しとなりますが、内容の正確性・完全性は保証されず、公式ドキュメントで最新情報をご確認ください。本記事内容の利用によって生じたいかなる損害(サービスの中断、データ損失、営業損失等を含む)についても、著者は一切の責任を負いません。

Discussion

いつも素晴らしい記事をありがとうございます

革ジャンほしくなってきました

お読みいただきありがとうございます!

革ジャンいいですよね!

Jensen Huang CEOの革ジャンは100万円越えのものらしいです!笑