生成AIサービスをコンテキストウィンドウ(記憶力)から比較する

はじめに

主要なAIサービスのコンテキストウィンドウの長さを

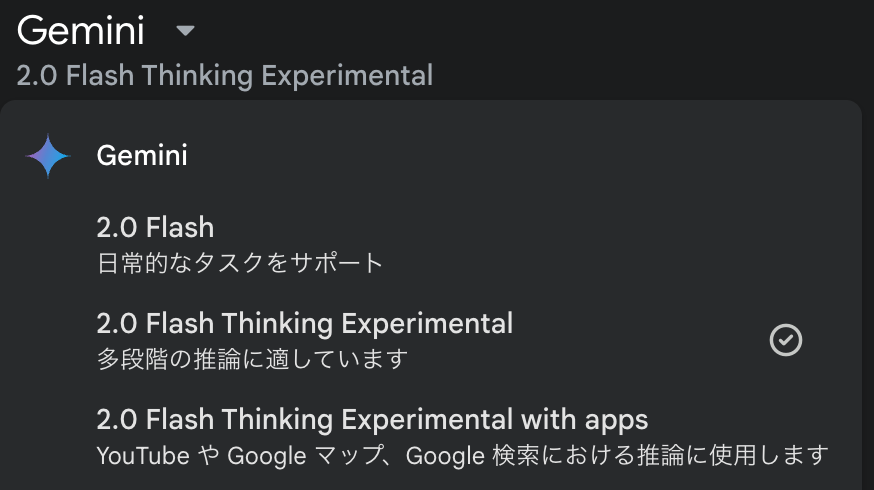

Geminiの2.0 Flash Thinking Experimentalモデルを活用しながら比較してまとめてみます。

コンテキストウィンドウとは?

大規模言語モデル(LLM)におけるコンテキストウィンドウとは、

AIが一度に理解し、記憶できるテキストの長さを指します。

これは、AIが会話の流れを把握し、より複雑なタスクを実行するために非常に重要な要素です。

コンテキストウィンドウが長いほど、AIはより多くの情報を考慮に入れて応答を生成できるため、

より人間らしい、一貫性のある、文脈に沿った対話が可能になります。

また、長い文書の要約、複雑な指示の理解、長時間の会話の継続など、より高度なタスクを実行する能力も向上します。

主要なAIサービスのコンテキストウィンドウ比較

主要なAIサービスとそのモデルにおけるコンテキストウィンドウの長さを比較してみます。

以下に示す数値は、トークン数で表されています。

トークンは、単語や句読点などのテキストの断片であり、一般的に英語の単語は約1トークン、日本語の文字は平均して約1~3トークンとして数えられます。

| サービス/モデル | モデルの種類 | コンテキストウィンドウ長 | 特徴 | 備考 |

|---|---|---|---|---|

| OpenAI | GPT-4o (Omni) | 128,000トークン | 最新のフラッグシップモデル。GPT-4 Turboと同等の長いコンテキストウィンドウ。テキスト、画像、音声入出力に対応したマルチモーダルモデル。処理速度とコスト効率が向上。 | GPT-4 Turboから置き換わる形で提供開始 |

| GPT-4 Turbo (プレビュー版: 0125, 1106) | 128,000トークン / 100Kトークン | 以前のフラッグシップモデル。128Kコンテキストウィンドウ版と100Kコンテキストウィンドウ版が存在。(プレビュー版は順次廃止予定) | GPT-4oの登場により、新規利用は推奨されず | |

| GPT-4 | 8,192トークン | 高性能モデルだが、GPT-4oやTurboに比べるとコンテキストウィンドウは短い。 | ||

| GPT-3.5 Turbo (0125, 1106) | 16,384トークン | 高速でコスト効率が良いモデル。アップデートで拡張。 | ||

| Gemini 1.5 Pro | 100万トークン | 極めて長いコンテキストウィンドウを誇るモデル。長編コンテンツや大量の情報を扱うタスクに強み。 | 2025年2月5日よりGemini 2.0 Pro実験版が公開 | |

| Gemini 2.0 Flash | 100万トークン | Gemini 1.5 Proと比較して2倍の応答速度を実現。同等の超長コンテキストウィンドウを持ちながら、低遅延・低コストに特化したモデル。大量の情報を迅速に処理する用途に最適。 | 新モデルとして登場。Gemini 1.5 Proと並び、最長のコンテキストウィンドウを提供 | |

| Anthropic | Claude 3 Opus | 200,000トークン | 高性能なClaude 3シリーズ最上位モデル。非常に長いコンテキストウィンドウを持ち、複雑な分析や創造的なタスクに最適。 | |

| Claude 3.7 Sonnet | 200,000トークン | Claude 3 Opusと同様の長いコンテキストウィンドウを持ちながら、高速・低コスト。 | ||

| Claude 3.5 Haiku | 200,000トークン | Claude 3シリーズ最速・低コストモデル。Opus、Sonnetと同じコンテキストウィンドウ長。リアルタイムに近い応答速度が特徴。 | ||

| Cohere | Command R+ | 128,000トークン | 企業向け高性能モデル。長いコンテキストウィンドウ、RAGに強み。 | |

| Command R | 64,000トークン | Command R+ の廉価版。十分なコンテキストウィンドウ、多様なタスクに対応可能。 | ||

| Mistral AI | Mistral Large | 32,000トークン | ヨーロッパ発の高性能モデル。効率性と性能のバランスが良い。 | |

| Mistral Medium | 不明 (Largeと同程度か) | Mistral Large の廉価版と見られるが、コンテキストウィンドウ長の公式情報不明。 | ||

| Stability AI | StableLM 2 160K | 160,000トークン | オープンソースモデル。非常に長いコンテキストウィンドウ、研究用途で期待。 |

比較のポイント

-

Gemini

- 現在、公開されているモデルの中で最も長いコンテキストウィンドウ (100万トークン) を持っています。これは、他のモデルと比較して圧倒的な長さであり、非常に長いテキストや大量の情報を扱う必要がある場合に非常に有利です。

-

Claude 3 シリーズ (Opus, Sonnet, Haiku)

- 200,000トークンと非常に長いコンテキストウィンドウを提供しています。Geminiに次ぐ長さであり、多くの高度なタスクに対応できます。

-

GPT-4o

- 128,000トークンと、GPT-4 から大幅に拡張されたコンテキストウィンドウを持っています。GeminiやClaude 3 シリーズには及ばないものの、実用的な範囲では十分な長さであり、多くのユーザーにとって有力な選択肢となります。

コンテキストウィンドウの重要性

コンテキストウィンドウの長さは、AIの能力に直接影響を与える重要な要素です。

-

長文の理解と処理

- コンテキストウィンドウが長いほど、AIは長文のドキュメントや記事、書籍などをより深く理解し、要約したり、質問に答えたりすることができます。

-

複雑な指示の実行

- 複雑な指示や、複数のステップを含むタスクを実行する場合、AIはより多くの情報を記憶しておく必要があります。長いコンテキストウィンドウは、このような複雑なタスクの実行を可能にします。

-

長時間の会話

- 会話が長くなるにつれて、文脈を維持することが重要になります。長いコンテキストウィンドウを持つAIは、過去の会話の内容をより長く記憶できるため、より自然で一貫性のある対話を続けることができます。

-

創造的なタスク

- 小説の執筆、脚本の作成、コード生成など、創造的なタスクでは、AIがより多くの情報を同時に考慮に入れることができるほど、より豊かで複雑なアウトプットを生成できます。

コンテキストウィンドウが長いことの利点

コンテキストウィンドウの長さは、AI、特に大規模言語モデル(LLM)の能力を大きく左右する重要な要素です。

長くすることで、AIはより複雑で高度なタスクをこなせるようになり、ユーザーにとってより価値の高い存在となります。

一般的な活用における利点

1. 長文の理解と処理能力の向上

-

詳細な内容把握

- 長いコンテキストウィンドウを持つAIは、長文のドキュメント、記事、書籍全体を一度に読み込み、内容を深く理解できます。これにより、文章全体のテーマ、文脈、細部まで捉えた上で、質問応答、要約、感情分析などが可能になります。

-

文脈に基づいた高度な要約

- 単にテキストを短縮するだけでなく、長文全体の文脈を理解した上で、重要なポイントを抽出し、ニュアンスを捉えた質の高い要約を生成できます。複数の文書を跨いだ要約や、特定のテーマに関する情報を統合した要約も得意です。

-

複雑な構造の理解

- 論文、報告書、契約書など、複雑な構造を持つ長文も、全体構造を把握した上で処理できます。章立て、段落構成、論理展開などを理解し、必要な情報を的確に抽出したり、構造的な分析を行ったりできます。

-

長文からの情報検索

- 大量のテキストデータ(例:企業のナレッジベース、法律文書、研究論文のデータベース)から、質問内容に関連する情報を高精度に検索し、文脈に沿った形で提示できます。従来のキーワード検索に比べ、より高度な情報検索が可能です。

例

* 長編小説の深い内容理解と、登場人物の感情や伏線に基づいた考察

* 研究論文全体の論旨を捉えた上で、特定の実験結果に関する詳細な質問に回答

* 複雑な契約書の条項全体を理解し、特定の条件に関する法的リスクを評価

* 複数年のニュース記事を分析し、特定の社会現象の変遷を追跡

2. 複雑な指示への対応力向上

-

多段階指示の理解と実行

- 複数のステップからなる複雑な指示や、相互に関連する複数の条件を含む指示を正確に理解し、実行できます。「〇〇社の✕✕製品について、顧客からの過去の問い合わせ内容を分析し、よくある質問とその回答をFAQとしてまとめてください。ただし、技術的な質問と営業的な質問は分けて、それぞれ優先度が高い順に並べてください。」のような複雑な指示も、全体を把握し、ステップごとに適切に処理できます。

-

制約条件の考慮

- 指示の中に含まれる様々な制約条件(例:スタイル、トーン、文字数、対象読者、使用すべき情報源など)を記憶し、すべて満たした上でアウトプットを生成できます。

-

曖昧な指示の解釈

- 多少曖昧な表現や、意図が不明瞭な指示に対しても、文脈から意図を推測し、適切な対応ができます。「〇〇社の新製品について、顧客に響くようなキャッチコピーをいくつか考えて」のような指示に対して、製品の特性やターゲット顧客層を考慮し、複数の魅力的なキャッチコピーを提案できます。

-

過去の指示との整合性

- 過去の会話や指示内容を記憶しているため、以前の指示との矛盾がないように、一貫性のある対応が可能です。以前に「フォーマルなトーンで」という指示を出した場合、その後の指示に対してもフォーマルなトーンを維持します。

例

* 複雑なプログラミングの要件定義書に基づいて、高品質なコードを生成

* 詳細なマーケティング戦略に基づいて、複数の広告クリエイティブを制作

* 複数部門にまたがるプロジェクト計画を、各部門の制約条件を考慮して立案

* 顧客の過去の購入履歴と好みを考慮し、パーソナライズされた商品推薦を実行

3. より自然で文脈に沿った会話の実現

-

会話履歴の長期記憶

- 過去の会話内容を長く記憶できるため、会話の文脈を維持しやすく、人間同士の会話のように自然でスムーズな対話が可能です。

-

一貫性のある応答

- 会話が進むにつれて、AIの発言が一貫性を保ち、矛盾が少なくなります。以前の発言内容を踏まえ、文脈に合った適切な応答を生成し続けることができます。

-

パーソナライズされた対話

- 過去の会話からユーザーの好み、興味、知識レベルなどを学習し、会話内容やスタイルをパーソナライズできます。ユーザーごとに異なる情報提供や、個別のニーズに合わせた対応が可能です。

-

感情豊かな表現

- 会話の文脈や過去のやり取りから、適切な感情表現(例:共感、喜び、驚き)を織り交ぜることで、より人間味あふれる、共感的な対話ができます。

-

冗長性の排除と効率的なコミュニケーション

- 既に会話の中で触れた内容を繰り返すことなく、新しい情報や議論にスムーズに進むことができ、効率的なコミュニケーションが可能です。

例

* 長時間続くカウンセリングやコーチングセッションで、クライアントの状況を継続的に把握し、適切なアドバイスを提供

* ロールプレイングゲームで、過去のプレイヤーの行動や選択を記憶し、それに基づいたストーリー展開やキャラクターの反応を実現

* カスタマーサポートにおいて、顧客との過去のやり取りを把握し、毎回同じ説明を繰り返すことなく、スムーズな問題解決を支援

* 教育現場で、生徒の学習進捗や理解度を長期的に記録し、個々の生徒に最適化された学習指導を提供

4. より創造的で洗練されたアウトプットの生成

-

複雑なアイデアの組み合わせ

- より多くの情報を同時に考慮に入れることができるため、複数の異なるアイデアや концепции を組み合わせ、独創的で斬新なアイデアを生み出すことができます。

-

多角的な視点からの考察

- 様々な情報源や視点を統合し、多角的でバランスの取れた考察や分析が可能です。偏りのない、より客観的なアウトプットを生成できます。

-

微妙なニュアンスの表現

- 文脈や背景情報を深く理解することで、言葉の微妙なニュアンスや、行間を読むような表現も可能になります。比喩、皮肉、ユーモアなどを理解し、適切に用いることも期待できます。

-

高度な推論と演繹

- 与えられた情報から論理的に推論したり、演繹的な思考を働かせたりすることで、より深い洞察や、表面的な情報からは見えない скрытые pattern を発見できます。

-

長編コンテンツの作成

- 小説、脚本、レポート、企画書など、長大なコンテンツを、全体的な構成を維持しながら、一貫性のある高品質な文章で作成できます。

例

* 複数のジャンルを融合した新しい音楽スタイルやアート作品を創作

* 社会問題に対する多角的な分析に基づき、革新的な解決策を提案

* 複雑な設定や人間関係を持つ長編ファンタジー小説を執筆

* 企業の中長期経営戦略を、経済動向、競合状況、技術革新など多岐にわたる要素を考慮して策定

5. 検索拡張生成 (RAG) の高度化

-

より多くの関連文書の参照

- 検索拡張生成において、長いコンテキストウィンドウは、より多くの関連文書をコンテキストとして取り込むことを可能にします。これにより、AIはより広範な情報に基づいた回答を生成でき、情報の網羅性と精度が向上します。

-

文書内の深い情報統合

- 複数の文書から、関連性の高い情報を深く統合し、矛盾なくまとまった回答を生成できます。単に情報を並べるだけでなく、情報を関連付け、意味のある形で提示できます。

-

複雑な質問への対応力向上

- 複数の情報源を参照する必要がある複雑な質問や、複数の文書にまたがる情報を統合する必要がある質問に対して、より正確かつ包括的な回答を提供できます。

-

最新情報の活用

- 大量の最新情報をコンテキストとして取り込むことで、常に最新の情報に基づいた回答を生成できます。特に、変化の速い分野(例:テクノロジー、金融)において、最新情報に基づいた意思決定を支援できます。

例

* 最新の科学論文データベースを検索し、特定の疾患に関する最新の研究動向をまとめる

* 複数のニュース記事やレポートを分析し、特定の企業の評判やリスクを評価

* 大量の特許文書を検索し、特定の技術分野における最新の技術トレンドを把握

* 社内のナレッジベース全体を検索し、顧客からの複雑な問い合わせに対する回答を作成

コーディングにおける利点

1. 大規模なコードベースの理解と操作

-

より大きなファイルやプロジェクトの処理

- 長いコンテキストウィンドウを持つAIは、一度に非常に大きなコードファイル(数千行を超えるファイルや、場合によっては複数のファイル)を読み込むことができます。これにより、巨大なコードベース全体を把握し、コードの構造、依存関係、ロジックを理解することが可能になります。

-

複雑なコード構造の把握

- 大規模なプロジェクトでは、コードはモジュール、クラス、関数などが複雑に絡み合って構成されています。長いコンテキストウィンドウは、このような複雑な構造全体を把握し、コードの全体像を理解するのに役立ちます。

-

既存コードの迅速な理解と再利用

- 既存のコードベースを短時間で理解し、必要な機能を特定したり、再利用可能なコンポーネントを見つけ出す作業が効率化されます。新しいプロジェクトで既存のコードを参考にしたり、既存プロジェクトを改修する際に非常に有利です。

-

レガシーコードの保守・運用

- 長年メンテナンスされてきたレガシーコードは、複雑に入り組んでおり、理解が難しい場合があります。長いコンテキストウィンドウは、このようなレガシーコードの全体像を把握し、保守・運用を容易にするのに貢献します。

例

* 数万行に及ぶモノリシックなシステムのコード全体を解析し、特定の機能がどのように実装されているかを理解する。

* 大規模なオープンソースプロジェクトのコードベースを調査し、コントリビュートする箇所を特定する。

* 複数のマイクロサービスから構成されるシステムのコードを解析し、サービス間の連携を把握する。

* レガシーシステムのCOBOLコードを理解し、Javaなどの新しい言語に移行するための設計図を作成する。

2. コード補完とコード生成の精度向上

-

文脈に基づいた高精度な補完

- 長いコンテキストウィンドウは、より多くの周辺コードを考慮に入れることができるため、変数名、関数名、クラス名などを補完する際に、より文脈に合った適切な候補を提示できます。

-

より長いコードスニペットの生成

- 数行から数十行に及ぶ長いコードスニペットを、文脈に合わせて自動生成できます。関数全体、クラスの一部、特定の処理ロジックなどを、周辺のコードと整合性の取れた形で生成することが可能です。

-

複雑な処理ロジックの生成

- 条件分岐、ループ処理、例外処理など、複雑な処理ロジックを含むコードを、意図を正確に反映した形で生成できます。

-

異なるプログラミングスタイルの適用

- プロジェクト全体のコーディングスタイルや、既存のコードのスタイルを学習し、それに合わせたコードを生成できます。チームで開発する際に、コードの統一性を保つ上で役立ちます。

例

* 関数内で使用する変数の型や名前を、関数の引数や周辺のコードから推測し、適切な候補を提示する。

* 特定のアルゴリズム(例:ソート、検索)を実装するコードを、アルゴリズム名と入出力の型を指定するだけで自動生成する。

* Reactコンポーネントのスケルトンコードを、コンポーネント名とpropsの定義に基づいて自動生成する。

* 特定のデザインパターン(例:Factoryパターン、Singletonパターン)を実装するコードを自動生成する。

3. デバッグとエラー分析の効率化

-

エラー発生箇所の特定と原因分析の迅速化

- エラーメッセージだけでなく、エラーが発生した周辺のコードを広範囲に分析することで、エラーの原因を特定しやすくなります。長いコンテキストウィンドウは、エラー発生箇所の文脈をより深く理解するのに役立ちます。

-

スタックトレースの解析

- 長いスタックトレース全体を理解し、エラーが発生した関数呼び出しのシーケンスを把握し、根本原因を特定するのに役立ちます。

-

潜在的なバグの検出

- コード全体を分析することで、特定の条件下で発生する可能性のある潜在的なバグや、設計上の問題点などを早期に発見できる場合があります。

-

テストコードの生成

- コードの挙動を理解した上で、適切なテストケースを網羅的に生成できます。特に、複雑なロジックを持つコードに対して、効果的なテストコードを自動生成するのに役立ちます。

例

* コンパイルエラーや実行時エラーが発生した場合、エラーメッセージと周辺コードを分析し、修正案を提示する。

* スタックトレースを解析し、どの関数呼び出しがエラーを引き起こしているかを特定し、原因となるコード箇所を特定する。

* コードレビューにおいて、潜在的なセキュリティ脆弱性やパフォーマンス上のボトルネックとなりうる箇所を指摘する。

* 関数やクラスの動作を検証するためのユニットテストコードを自動生成する。

4. コードリファクタリングと最適化の高度化

-

コード全体の構造を考慮したリファクタリング

- 関数やクラスだけでなく、モジュールやパッケージなど、コード全体の構造を理解した上で、より効果的なリファクタリングを提案できます。

-

パフォーマンスボトルネックの特定と最適化

- コード全体の処理フローを分析し、パフォーマンス上のボトルネックとなっている箇所を特定し、効率的なコードに書き換える提案ができます。

-

コードの可読性・保守性向上

- コードの複雑さを軽減し、可読性や保守性を高めるためのリファクタリング(例:関数の分割、クラスの再構成、命名規則の統一など)を提案できます。

-

異なるリファクタリング手法の適用

- 様々なリファクタリング手法(例:デザインパターンの適用、アルゴリズムの改善、データ構造の変更など)を、コードの特性に合わせて適切に適用できます。

例

* 巨大な関数を、処理内容ごとに複数の小さな関数に分割し、可読性を向上させる。

* 複数のクラス間で重複しているコードを共通化し、コードの重複を削減する。

* 特定の処理がボトルネックになっている箇所を特定し、より効率的なアルゴリズムやデータ構造に置き換える。

* コードの命名規則を統一し、コード全体の可読性を向上させる。

5. ファイル間、プロジェクト全体のコンテキストの理解

-

複数ファイルにまたがる変更の追跡と理解

- 複数のファイルにまたがる変更を、関連性を考慮しながら理解できます。大規模な機能追加やリファクタリング作業における変更点を把握するのに役立ちます。

-

プロジェクト全体の一貫性維持

- プロジェクト全体で一貫したコーディングスタイル、アーキテクチャ、設計思想などを維持するための提案ができます。

-

異なるファイル間の依存関係の把握

- ファイル間の依存関係を理解し、変更が他のファイルにどのような影響を与えるかを予測できます。大規模なプロジェクトにおける変更の影響範囲を評価するのに役立ちます。

-

プロジェクトドキュメントの生成

- コード全体の構造、クラス図、APIドキュメントなどを、コードから自動生成できます。プロジェクトの理解を助けるドキュメント作成を効率化できます。

例

* 特定の機能追加が、プロジェクト全体のどのファイルに影響を与えるかを分析し、変更箇所をリストアップする。

* プロジェクト全体のコーディングスタイルをチェックし、違反箇所を指摘し、修正案を提示する。

* プロジェクト内のクラス間の関係を分析し、クラス図を自動生成する。

* プロジェクトのAPI仕様をコードから自動生成し、ドキュメントとして出力する。

注意点

まとめ

AIサービスの能力を比較する上で、コンテキストウィンドウの長さは非常に重要な指標です。Gemini やClaude3シリーズなどの最新モデルは、非常に長いコンテキストウィンドウを持ち、複雑で高度なタスクをAIに実行させることが可能になっています。

コンテキストウィンドウが長いことは、長文理解、複雑な指示対応、自然な会話、創造性、情報検索など、多岐にわたる分野で、より高度で洗練されたAIの活用を可能にします。

特にコーディングにおいては、大規模なコードベースの理解、高精度なコード補完、

効率的なデバッグ、高度なリファクタリング、プロジェクト全体のコンテキスト理解など、

開発効率とコード品質を大きく改善する可能性を秘めています。

利用目的に合わせて適切なコンテキストウィンドウ長を持つAIサービスを選択することが重要であり、今後のコンテキストウィンドウのさらなる拡大によって、AIの可能性はますます広がることが期待されます。

chameleonmeme.com/ ビジネスのすべての工程を自分たちの手で行い、 気の合う仲間と楽しく仕事をすることで熱中するためにチームをスタートしました。 お仕事のご相談・お誘いはお気軽にお問い合わせください。 コーポレートサイトのWEBフォームから随時受け付けております🙆

Discussion