😄

Google AI Ultraプラン発表 まずはUSユーザから

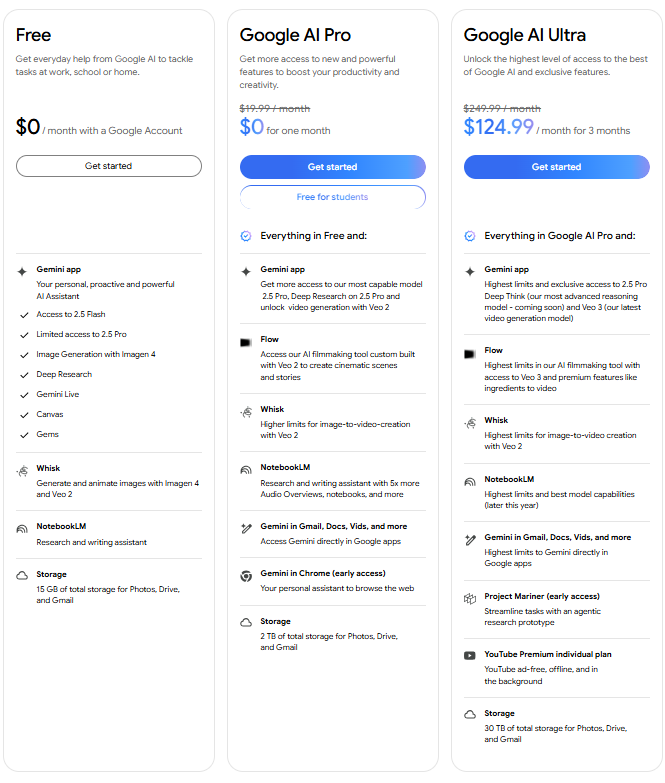

日本時間2025年5月21日、GoogleからこれまでのPro Plan(月額$19.99、日本だと月額¥2,900)に加えて、Google AI Ultraという上位プランが発表されました。Gemini AdvancedがProになったようですね。OpenAIのPro(月額$200)やAnthropicのMAX(月額$100と$200)を意識した上位プランなのかなと。

現状、USのみ利用可能なプランのようです。

また、最初の3か月は半額で試せるようです。

VPNでUSに繋いでプランのサイトを確認しました。

https://gemini.google/subscriptions/

Ultraが表示されたものの、この後が進めませんでした。残念。

Ultraが選択できる

ただし、私のアカウントだとこの画面に遷移して進めない

comming soonということなので、気長に待つしかないですね。

Ultraプランでできることは下記だそうです。

-

Gemini app:

利用枠の拡大と2.5 Pro Deep Think(近日公開予定の最も高度な推論モデル)およびVeo 3(最新のビデオ生成モデル)への限定アクセス -

Flow:

AI映像制作ツールでの利用枠の拡大、Veo 3へのアクセス、および「ingredients to video(キャラクターやシーンを維持しながら、複数のクリップや場面を作成できる機能)」のようなプレミアム機能 -

Whisk:

Veo 2による画像から動画への変換における利用枠の拡大 -

NotebookLM

利用枠の拡大と最高のモデル機能(今年後半) -

Gemini in Gmail, Docs, Vids, and more

GoogleアプリでGeminiに直接アクセスする利用枠の拡大 -

Project Mariner(早期アクセス)

エージェント型研究プロトタイプによるタスクの効率化 (OpenAIのOperatorやAnthropicのComputer useが競合) -

YouTube Premium個人プラン:

YouTube広告なし、オフライン視聴、バックグラウンド再生 -

Storage:

Photos、Drive、Gmailのための合計30 TBのストレージ

3か月半額で試せるようなので、日本でも利用可能になりましたら、早速試してみたいですね!

また、Geminiのモデル周りのアップデートの一時情報は下記にあります。

概要は下記の通り。

-

2.5 Pro:

開発者向けに2.5 Proをアップデート。よりリッチなウェブアプリ構築が可能になった。WebDev Arenaでスコア1415を記録し首位。LMArenaの全リーダーボードでもトップ。100万トークンのコンテキストウィンドウを持ち、長文脈とビデオ理解で最先端性能を発揮。教育専門家と構築したLearnLMを統合し学習分野でもリーディングモデルとなった。学習科学の5原則全てで他のトップモデルを上回る性能を示している。 -

DeepThink:

「Deep Think」と呼ばれる強化推論モードをテスト中。応答前に複数の仮説を検討できる新技術を使用。2.5 Pro Deep Thinkは最難関数学ベンチマーク2025 USAMOで印象的なスコアを達成。競技レベルのコーディングベンチマークLiveCodeBenchでもリード。マルチモーダル推論テストMMUでは84.0%のスコアを記録。安全性重視のため、広く提供する前にGemini API経由で信頼できるテスターにリリースしフィードバックを収集予定。 -

2.5 Flash:

スピードと低コストに最適化された効率的モデル「2.5 Flash」が多方面で改善。推論、マルチモーダル、コード、長文脈の主要ベンチマークで向上。評価では20-30%少ないトークン使用で効率性も向上。現在、開発者向けGoogle AI Studio、企業向けVertex AI、一般ユーザー向けGeminiアプリでプレビュー可能。2024年6月初旬に本番環境での一般提供開始予定。 -

Native audio output and improvements to Live API:

Live APIに視聴覚入力とネイティブ音声出力ダイアログのプレビュー版を導入。より自然で表現力豊かな会話体験の構築が可能に。ユーザーは声のトーン、アクセント、話し方のスタイル調整可能。新機能は「Affective Dialogue」(感情検出)、「Proactive Audio」(背景会話無視・応答タイミング判断)、「Thinking in the Live API」(複雑タスクサポート)。複数話者対応テキスト読み上げ機能も提供され、24以上の言語で利用可能。 -

Computer use:

Project Marinerのコンピュータ使用機能をGemini APIとVertex AIに統合。Automation Anywhere、UiPath、Browserbaseなど複数企業が可能性を探索中。2024年夏にかけて開発者向けに広く提供予定。この機能でAIモデルがコンピュータシステムと直接対話可能になり、業務プロセス自動化、ブラウザ操作、UI対話など複雑タスクの自動化・支援が実現。AIアシスタントの活用範囲拡大と実務効率化に貢献。 -

Better security:

間接的プロンプトインジェクション(AIが取得するデータに悪意ある指示が埋め込まれる攻撃)などのセキュリティ脅威に対する保護を強化。新セキュリティアプローチによりツール使用中の間接的プロンプトインジェクション攻撃に対する保護率が大幅向上。Gemini 2.5シリーズは最もセキュアなモデルとなった。安全性、責任、セキュリティに関する取り組みとセキュリティ対策の進化についての詳細はGoogle DeepMindブログで公開。 -

Thought summaries:

2.5 ProとFlashはGemini APIとVertex AIで思考サマリー機能を提供。モデルの生の思考をヘッダー、重要詳細、ツール使用時などのアクション情報を含む明確な形式に整理。構造化された思考プロセスにより、開発者とユーザーはGeminiモデルとのやり取りをより理解・デバッグしやすくなる。AIの意思決定プロセスの透明性が向上し、ユーザーは応答生成過程をより明確に把握可能。開発者はモデル動作を詳細確認でき、効果的実装が実現。 -

Thinking budgets:

2.5 Flashに思考予算機能を導入。開発者がレイテンシと品質のバランスをとることでコスト制御可能に。この機能は2.5 Proにも拡張され、モデルが応答前に使用するトークン数を制御したり、思考機能自体をオフにすることも可能。予算機能付きGemini 2.5 Proは数週間内に安定本番使用向けに一般提供予定。この機能で開発者はAIモデル動作をより細かく調整でき、アプリ要件やリソース制約に合わせてパフォーマンスと効率性のバランスを最適化可能。コスト効率の高いAI実装を実現する重要な進歩。 -

MCP support:

Gemini APIにModel Context Protocol(MCP)定義のネイティブSDKサポートを追加。オープンソースツールとの統合が容易に。MCPサーバーやホストツールのデプロイ方法も探索中。エージェントアプリケーション構築の簡素化を目指す。モデルとDX改善に継続的に取り組み、効率性とパフォーマンス向上、開発者フィードバックへの対応を実施。Geminiの能力の幅と深さに関する基礎研究にも注力。今後さらなる機能追加が期待される。MCPサポートにより、開発者はより柔軟で強力なAIアプリケーション構築が可能に。

では!

Discussion